لماذا يجب عليك تجنب الاعتماد على روبوتات المحادثة الذكية كمصادر للأخبار؟

Most people like

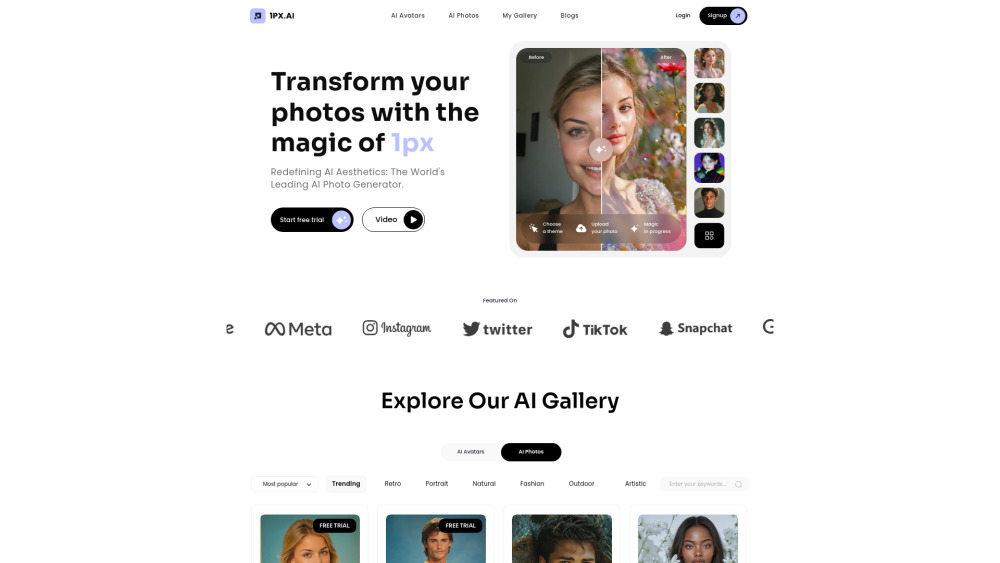

نقدم لكم منصتنا المتطورة لتوليد الصور والأفاتار بالذكاء الاصطناعي، حيث يلتقي الابتكار بالإبداع! بفضل التكنولوجيا المتقدمة المتاحة لدينا، يمكن للمستخدمين بسهولة إنشاء صور وأفاتار مذهلة وشخصية. سواء كنت تسعى لتعزيز وجودك على الإنترنت، أو تصميم رسوم بيانية فريدة لوسائل التواصل الاجتماعي، أو مجرد استكشاف إمكانياتك الإبداعية، فإن منصتنا تحول أفكارك إلى مرئيات عالية الجودة في دقائق. اغمر نفسك في عالم من الاحتمالات واكتشف مدى سهولة إنشاء صور وأفاتار آسرة تتناسب مع أسلوبك!

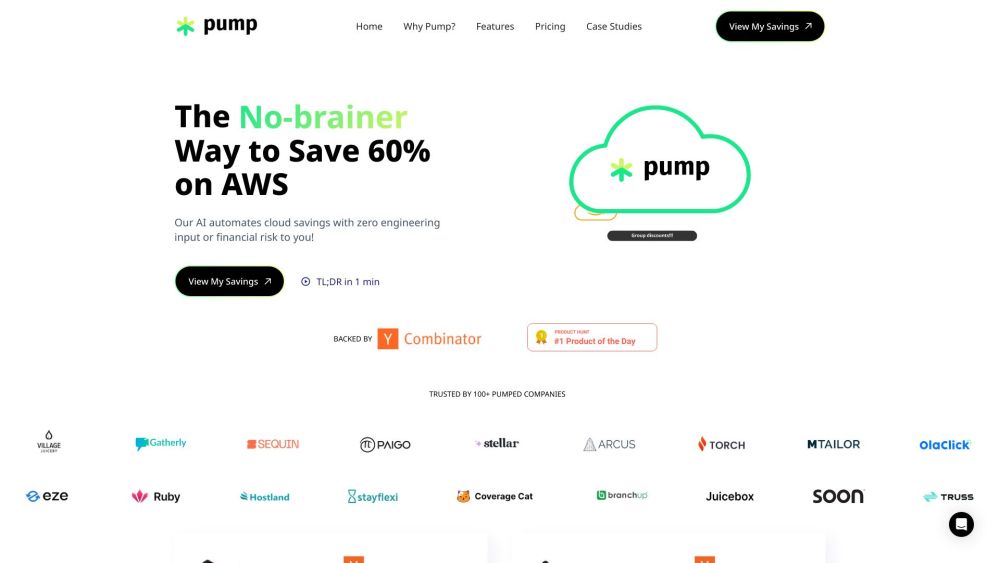

حقق أقصى وفورات في خدمات السحابية تصل إلى 60% مع Pump - منصة مبتكرة مدعومة بالذكاء الاصطناعي تهدف إلى تحسين تكاليف AWS الخاصة بك.

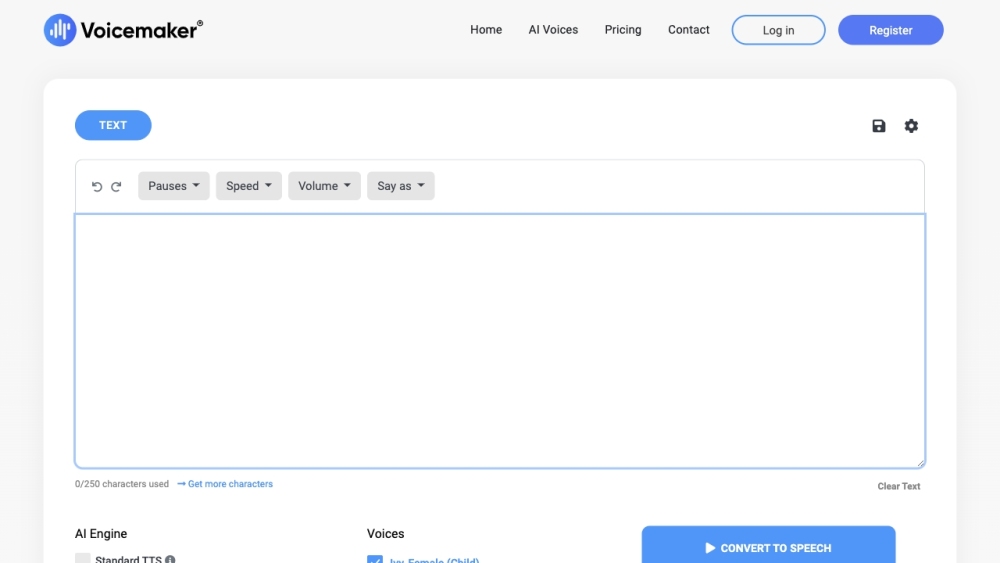

تحول Voicemaker® نصوصك إلى صوت واقعي مع مجموعة متنوعة من ملفات الصوت وميزات التخصيص الشاملة. استمتع بتقنية تحويل النص إلى كلام المبتكرة التي تجعل محتواك ينبض بالحياة.

Find AI tools in YBX

Related Articles

Refresh Articles