أطلقت OpenAI أداة الكشف عن الذكاء الاصطناعي: تكشف عن الصور المولدة بواسطة DALL·E 3 بدقة 98%

Most people like

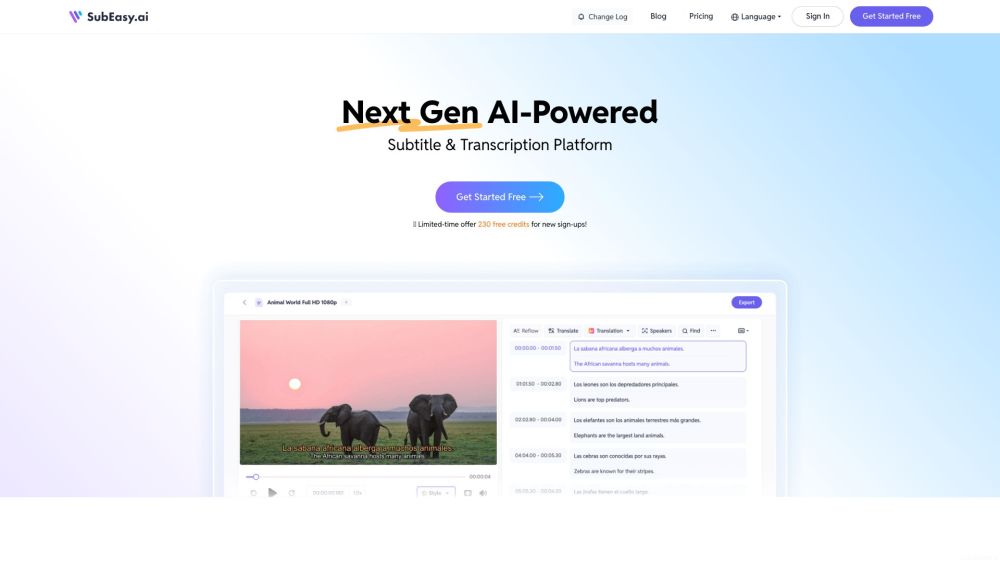

النسخ والترجمة المدعومة بالذكاء الاصطناعي: عزز محتواك بتكنولوجيا متقدمة

في عالم الرقمية اليوم، تُعتبر الاتصالات الواضحة والميسرة أمرًا حيويًا. تعمل النسخ والترجمة المدعومتان بالذكاء الاصطناعي على تبسيط محتوى الفيديو الخاص بك، مما يجعله أكثر جذبًا وشمولية للجمهور العالمي. من خلال استغلال قوة الذكاء الاصطناعي، يمكنك ضمان توفير ترجمات دقيقة وفي الوقت المناسب، مع الوصول إلى مشاهدين متنوعين بسلاسة. اكتشف كيف يمكن لتكنولوجيا الذكاء الاصطناعي أن ترتقي بإنتاج الفيديو الخاص بك وتوسع نطاق جمهورك.

دليل الذكاء الاصطناعي: المركز الشامل لكافة أدوات الذكاء الاصطناعي، يجمع بسلاسة بين أحدث التقنيات لتلبية جميع احتياجاتك.

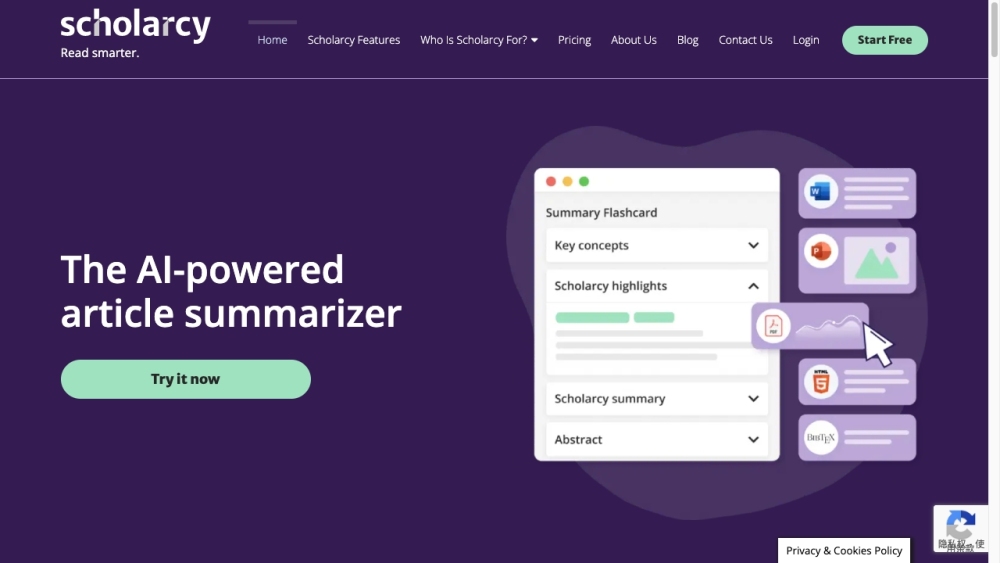

سكولارسي هي أداة مبتكرة تعتمد على الذكاء الاصطناعي، مُصممة لتحويل المقالات إلى بطاقات ملخصة، مما يتيح تقييمات سريعة وفعّالة. استمتع بقوة التعلم المُبسط مع سكولارسي، مما يجعل فهم المعلومات الأساسية أسهل من أي وقت مضى.

Find AI tools in YBX