أطلقت Google أحدث نموذجها لتحويل النص إلى صورة، "Imagen 3"، لجميع المستخدمين في الولايات المتحدة عبر منصة ImageFX. وترافق هذا الإصدار مع ورقة بحثية تفصيلية حول التقنية.

تأتي هذه التوسعة المهمة بعد الإعلان الأول عن النموذج في مؤتمر Google I/O في مايو، والوصول المحدود له في يونيو لمستخدمين معينين من Vertex AI. وذكر فريق البحث، "نقدم لكم Imagen 3، وهو نموذج انتشار كامنة يُنتج صوراً عالية الجودة من تعليمات نصية. يتفوق Imagen 3 على النماذج الرائدة الأخرى وقت التقييم."

يتزامن هذا الإطلاق مع تقديم xAI لنموذج Grok-2، وهو نظام ذكاء اصطناعي منافس يأتي مع قيود أقل على توليد الصور. وهذا يبرز الفلسفات المتباينة بشأن أخلاقيات الذكاء الاصطناعي وإدارة المحتوى في عالم التكنولوجيا.

Imagen 3: خطوة استراتيجية في سباق الذكاء الاصطناعي

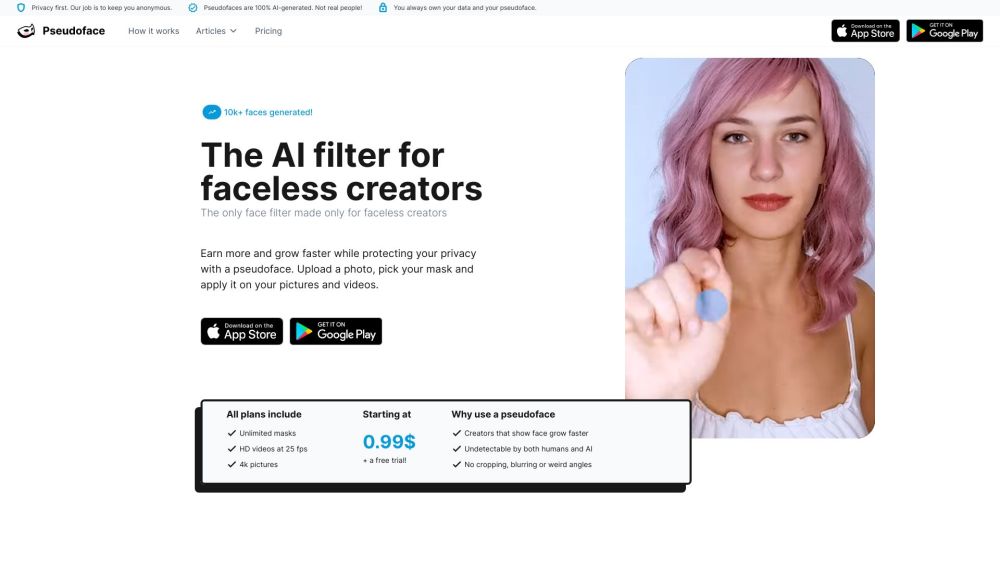

يعد إطلاق Google لنموذج Imagen 3 للجمهور في الولايات المتحدة لحظة محورية في تصاعد سباق الذكاء الاصطناعي. وقد كانت ردود الفعل من المستخدمين مختلطة؛ فبينما يشيد بعضهم بتحسينات النسيج والتعرف على الكلمات، يشعر آخرون بالإحباط بسبب تصفية المحتوى الصارمة.

وذكر أحد مستخدمي Reddit، "الجودة أعلى بكثير مع نسيج مدهش وتعرف على الكلمات، لكن يبدو أسوأ من Imagen 2. أبذل جهداً أكبر مع معدلات أخطاء أعلى." وركز النقاد على الرقابة ضمن Imagen 3، حيث أشار الكثيرون إلى أن التعليمات البسيطة غالباً ما تُحظر. علق أحد مستخدمي Reddit، "تمت تصفيتها بشكل مبالغ فيه؛ لا أستطيع حتى صنع سايبورغ!" في حين ذكر آخر، "[لقد] تم رفض نصف مدخلاتي، وأنا لا أحاول حتى إدخال أي شيء مفرط."

تُظهر هذه التعليقات التوازن الدقيق بين التزام Google باستخدام مسؤول للذكاء الاصطناعي ورغبة المستخدمين في التعبير الإبداعي. وأكدت Google على تركيزها على تطوير ذكاء اصطناعي مسؤول، مشددة على أنه "تم تنفيذ تصفية شاملة ووضع علامات على البيانات لتقليل المحتوى الضار في مجموعات البيانات والحد من احتمالية النتائج الضارة."

Grok-2: نموذج غير مقيد من xAI

على النقيض من ذلك، يتيح نموذج Grok-2 من xAI، المدمج في منصة إيلون ماسك الاجتماعية X، توليد صور شبه غير مقيد. وقد أدى هذا النقص في القيود إلى زيادة محتوى مثير للجدل، بما في ذلك صور مُحورة لشخصيات عامة وتمثيلات رسومية عادة ما تمنعها شركات الذكاء الاصطناعي الأخرى.

تسلط المناهج المتباينة لكل من Google وxAI الضوء على نقاش مستمر حول التوازن بين الابتكار والمسؤولية في تطوير الذكاء الاصطناعي. بينما تهدف منهجية Google الحذرة إلى منع سوء الاستخدام، فإنها تثير إحباط المستخدمين الذين يشعرون بالتقييد. بالمقابل، تثير نموذج xAI المتساهل مخاوف بشأن إمكانياته في نشر معلومات مضللة ومحتوى مسيء.

يُراقب الخبراء عن كثب كيف ستتطور هذه الاستراتيجيات، خاصة مع اقتراب الانتخابات الرئاسية الأمريكية. وقد دفعت غياب وسائل الحماية في توليد الصور لـGrok-2 إلى تكهنات حول ما إذا كانت xAI ستواجه ضغوطًا متزايدة لتطبيق قيود.

مستقبل توليد الصور بالذكاء الاصطناعي: الإبداع مقابل المسؤولية

على الرغم من الجدل، يقدّر بعض المستخدمين منهج Google الأكثر اعتدالاً. شارك محترف تسويق على Reddit، "توليد الصور باستخدام Adobe Firefly أسهل بكثير من التنقل عبر صفحات مواقع الأسهم العديدة."

بينما تصبح تقنية توليد الصور بالذكاء الاصطناعي أكثر وصولاً، تثار أسئلة مهمة حول إدارة المحتوى، وتوازن الإبداع والمسؤولية، وتأثير هذه الأدوات على النقاش العام ونزاهة المعلومات.

ستكون الأشهر القادمة مفصلية لكل من Google وxAI فيما يستجيبون لتغذية راجعة من المستخدمين، ويواجهون تدقيقات تنظيمية محتملة، ويفكرون في الآثار الأوسع لاختياراتهم التكنولوجية. قد تؤثر نتائج استراتيجياتهم بشكل كبير على مستقبل أدوات الذكاء الاصطناعي في صناعة التكنولوجيا.