رانوي تطلق جيلها الثالث ألفا: نموذج فيديو مذهل بتقنية الذكاء الاصطناعي يقدم مقاطع فائقة الواقعية مدتها 10 ثوانٍ.

Most people like

عزز استراتيجية توليد العملاء المحتملين الخاصة بك من خلال الاختبارات التفاعلية. هذه الأدوات الجذابة لا تقتصر على جذب الانتباه فحسب، بل تجمع أيضًا رؤى قيمة حول جمهورك. اكتشف كيف يمكن أن يسهم دمج الاختبارات في جهودك التسويقية في تعزيز تفاعل المستخدمين وتحويل العملاء المحتملين إلى عملاء مخلصين.

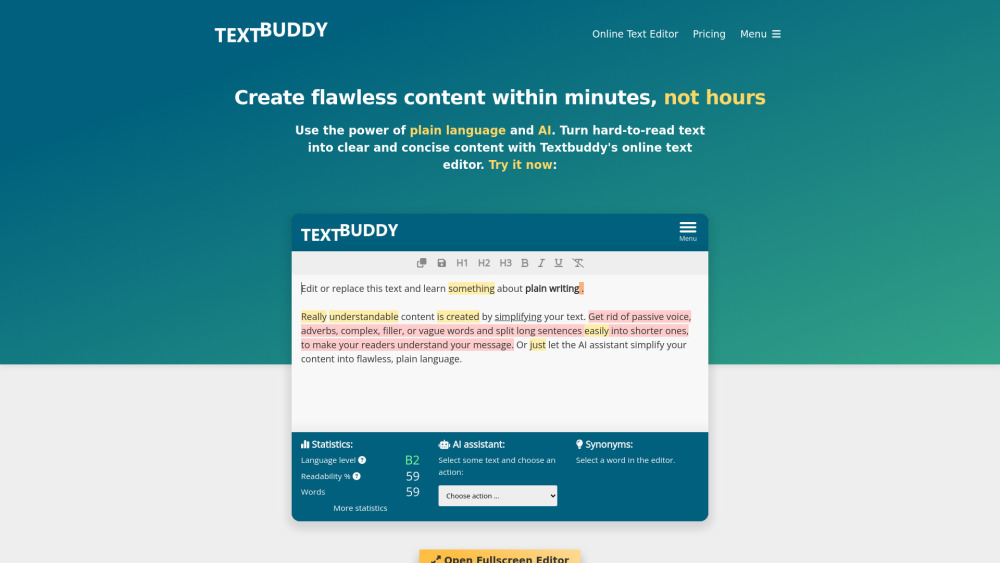

في عالمنا الرقمي السريع اليوم، تُعتبر التواصل الواضح والموجز أمرًا أساسيًا. يُمكنك محرر النصوص الذكي الخاص بنا من تحسين كتابتك بسهولة، مما يضمن أن تُعبر أفكارك بوضوح ودقة. سواء كنت تكتب بريدًا إلكترونيًا أو تقريرًا أو محتوى إبداعيًا، تساعدك تقنيتنا المتقدمة في الذكاء الاصطناعي على تنقيح نصوصك، مما يجعلها أكثر جاذبية وتأثيرًا. اكتشف كيف يمكن لمحرر النصوص الذكي الخاص بنا أن يرفع مستوى كتابتك ويأسر جمهورك.

افتحوا آفاق القوة مع مولد الفيديو الذكي لإنشاء مقاطع فيديو تسويقية جذابة في وقت قصير. هذه الأداة المبتكرة تُسهل عملية إنتاج الفيديو، مما يتيح لكم صياغة محتوى مثير يجذب جمهوركم بسرعة وكفاءة. مثالية للأعمال التي تسعى لتعزيز استراتيجيتها التسويقية، تجعل حلولنا المبنية على الذكاء الاصطناعي إنشاء الفيديو أسرع وأسهل من أي وقت مضى.

افتح آفاق إمكاناتك مع خدمة نمو إنستغرام المدعومة بالذكاء الاصطناعي

رفع مستوى وجودك على إنستغرام بسهولة مع خدمتنا المتقدمة لنمو إنستغرام المدعومة بالذكاء الاصطناعي. صممت لتعزيز استراتيجيتك على وسائل التواصل الاجتماعي، تستخدم خدمتنا الذكاء الاصطناعي المتطور لزيادة التفاعل، وجذب المتابعين، وتعزيز رؤية علامتك التجارية. عِش تجربة النمو العضوي المخصصة لجمهورك الفريد وشاهد مجتمع إنستغرام الخاص بك يزدهر. انضم إلينا اليوم وحوّل رحلتك على وسائل التواصل الاجتماعي بفضل قوة الذكاء الاصطناعي!

Find AI tools in YBX