مايكروسوفت تطلق Phi-3 للاستخدام العام وتكشف عن Phi-3-Vision: عرض أولي لنموذج لغة صغير متعدد الوسائط.

Most people like

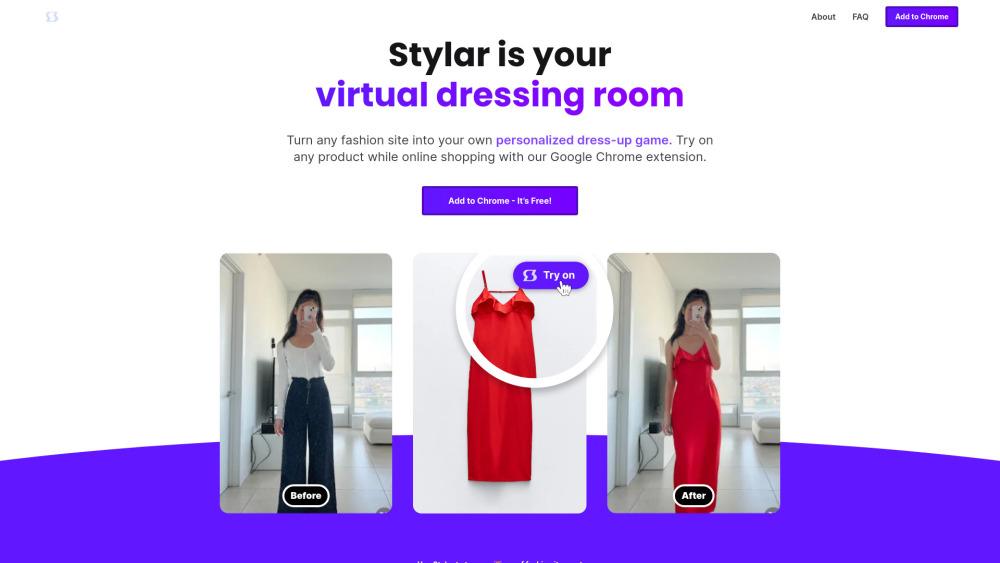

في عالم اليوم الرقمي السريع، أحدثت تكنولوجيا الذكاء الاصطناعي (AI) تحولاً في طريقة تسوقنا عبر الإنترنت، وخاصةً فيما يتعلق بالملابس. تتيح تقنية التجربة الافتراضية للمستهلكين تصور كيف ستبدو الملابس عليهم دون مغادرة منازلهم، مما يعزز تجربة التسوق. هذه الحلول المبتكرة تغير الطريقة التي يتعامل بها الناس مع الموضة، مما يسهل عليهم العثور على الإطلالة المثالية ويجعل الأمر أكثر متعة. مع التقدم في الذكاء الاصطناعي، أصبحت غرف القياس الافتراضية أدوات أساسية للمتاجر والعملاء على حد سواء، مما يردم الفجوة بين التسوق الفعلي والتسوق عبر الإنترنت.

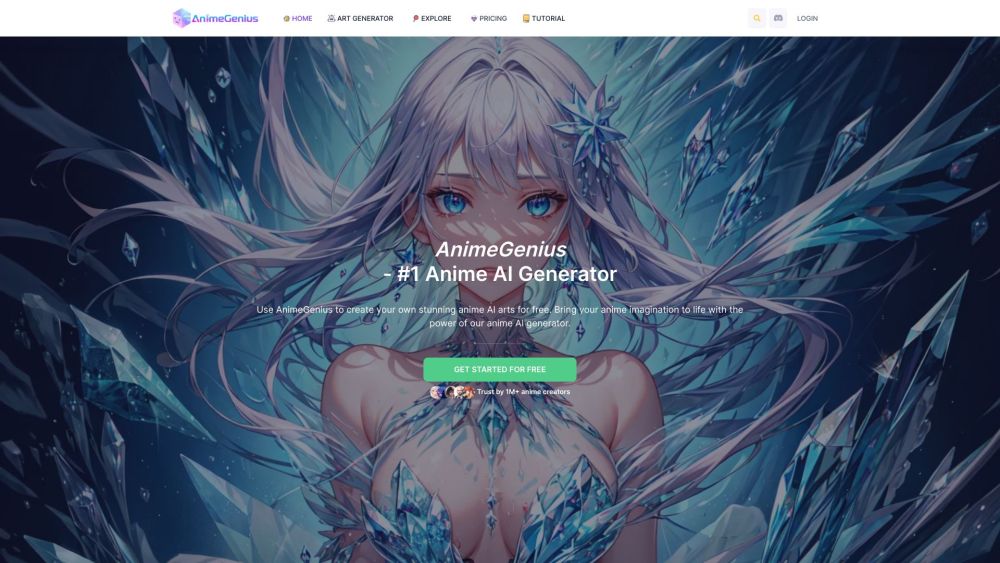

مرحبًا بكم في عالم مولد الأنمي الذكي المجاني، منصتكم المثالية لتحويل الأفكار الخيالية إلى صور أنمي رائعة. سواء كنتم فنانين مبتدئين، أو مبدعين ذوي خبرة، أو مجرد عشاق للأنمي، فإن هذه الأداة توفر لكم طريقة سهلة لإنشاء شخصيات ومشاهد أنمي فريدة. انغمسوا في عالم تكنولوجيا الذكاء الاصطناعي الجذاب ودعوا إبداعكم يزدهر مع ميزاتنا سهلة الاستخدام المصممة لتحقيق رؤاكم الأنمية!

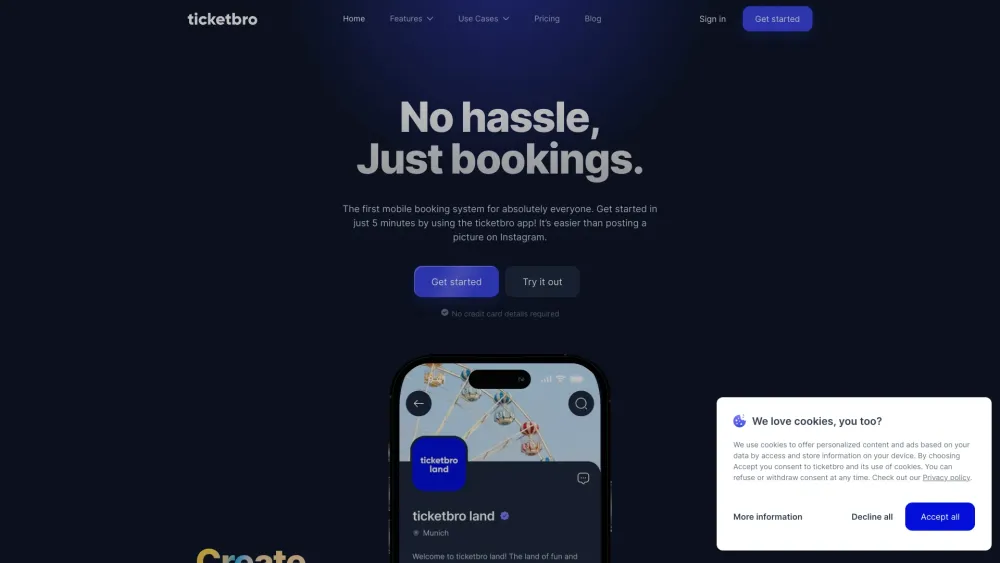

في عالمنا الرقمي السريع اليوم، يُعتبر وجود نظام حجز عبر الإنترنت يعتمد على التطبيقات أمرًا ضروريًا للأعمال التي تهدف إلى تعزيز راحة العملاء وتيسير العمليات. تتيح هذه الحلول المبتكرة للمستخدمين جدولة المواعيد، وحجز الخدمات، وإدارة الحجوزات بسهولة - كل ذلك من راحة أيديهم. من خلال دمج نظام حجز عبر الإنترنت يعتمد على التطبيقات في عملك، يمكنك تحسين رضا العملاء وكفاءة العمليات بشكل كبير، وذلك مع الحفاظ على تنافسيتك في صناعتك. استكشف الفوائد والميزات لهذه التكنولوجيا التحويلية لتطوير عملية الحجز وزيادة قاعدة عملائك.

Find AI tools in YBX

Related Articles

Refresh Articles