MWC 2024: كوالكوم تكشف عن أدوات وميزات مبتكرة للذكاء الاصطناعي لهواتف أندرويد

Most people like

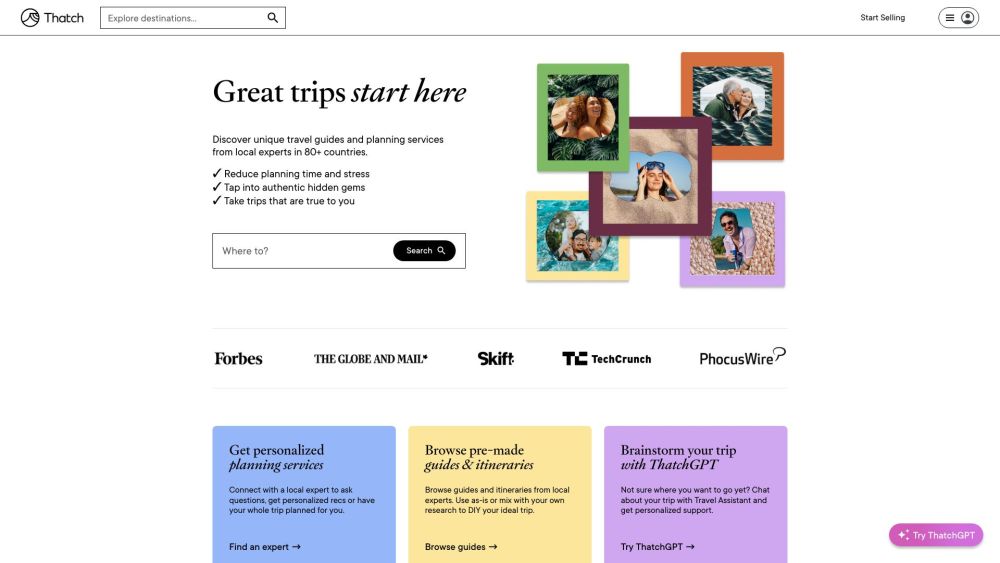

اكتشف أدلة سفر منسقة بعناية وخدمات تخطيط مخصصة من محترفين محليين حول العالم. دع فريقنا الخبير يضيف قيمة لتجربتك السياحية من خلال نصائح داخلية وتوصيات مصممة خصيصًا لك.

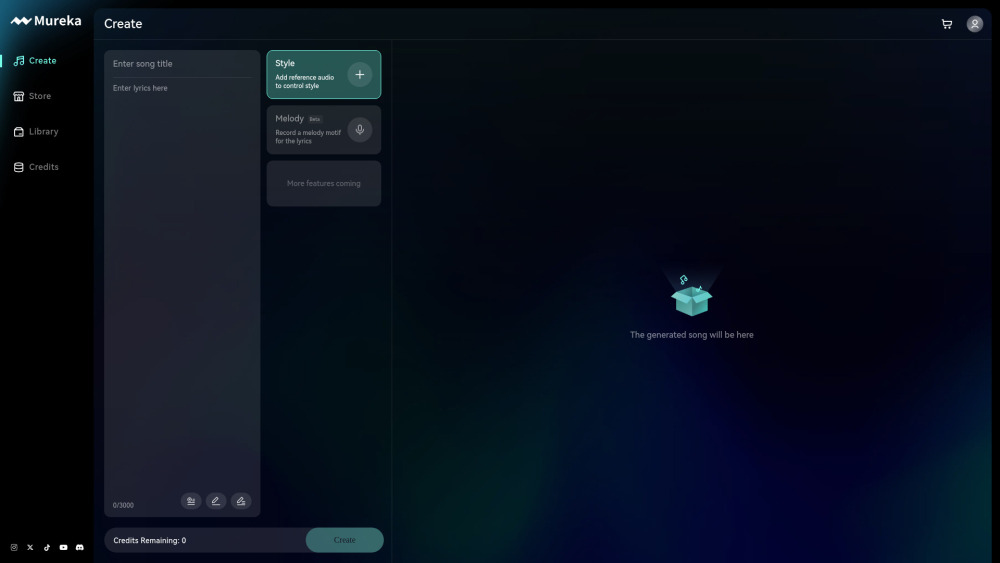

في السنوات الأخيرة، أحدثت منصات إنشاء الموسيقى بالذكاء الاصطناعي ثورة في طريقة تأليفنا وإنتاجنا وتجربتنا للموسيقى. تستخدم هذه الأدوات المبتكرة خوارزميات متقدمة لمساعدة الموسيقيين والمبدعين في إنتاج أصوات Melodies فريدة. سواء كنت موسيقيًا محترفًا أو فنانًا مبتدئًا، فإن منصات إنشاء الموسيقى بالذكاء الاصطناعي تقدم وسيلة مثيرة لاستكشاف الفنون والإبداع. اكتشف كيف تعيد هذه التكنولوجيا المتطورة تشكيل صناعة الموسيقى وتمكين المبدعين في جميع أنحاء العالم.

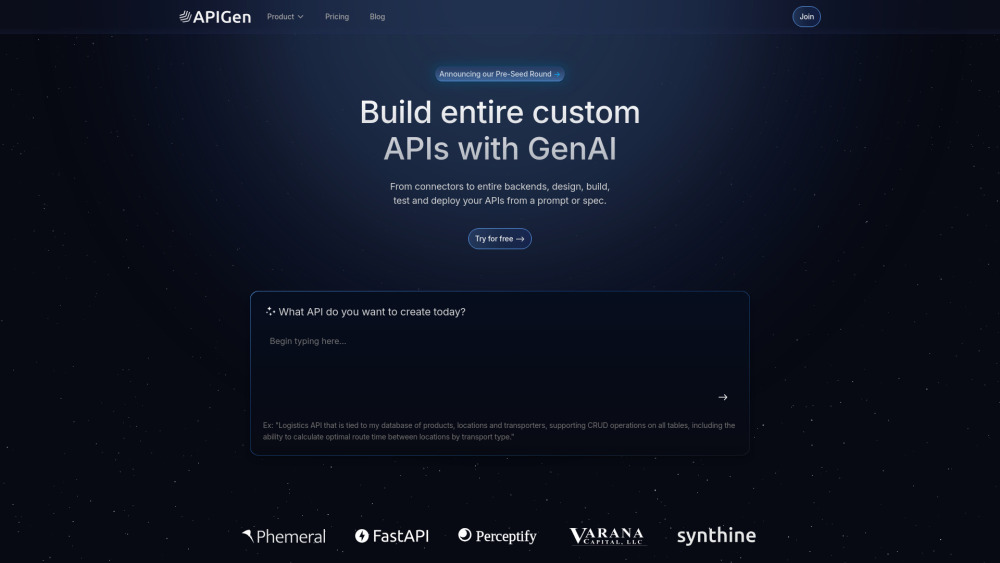

أنشئ وانشر واجهات برمجة التطبيقات المخصصة بسهولة مع منصتنا المبتكرة، المصممة من أجل السرعة والكفاءة. ابدأ اليوم لتبسيط عملية تطويرك!

اكتشف مزايا مقدمي خدمات السحابة الذين يقدمون إيجارات وحدات معالجة الرسوميات (GPU)، المثالية لمجموعة واسعة من المهام الحاسوبية. سواء كنت بحاجة إلى قوة معالجة متطورة للتعلم الآلي، أو تقديم الفيديو، أو المحاكاة المعقدة، فإن إيجارات وحدات معالجة الرسوميات تقدم حلاً مرنًا وفعالاً من حيث التكلفة. استكشف كيف يمكن لهذه الخدمات أن ترتقي بمشاريعك وتدفع الابتكار في المشهد المعتمد على البيانات اليوم.

Find AI tools in YBX

Related Articles

Refresh Articles