Bumble Incentiva a los Usuarios a Reportar Imágenes Generadas por IA para Garantizar la Seguridad y Autenticidad

Most people like

Explora nuestra innovadora plataforma de chat con personajes de IA, diseñada para interacciones seguras y atractivas. A diferencia de otras plataformas, priorizamos un entorno familiar, asegurando que todas las conversaciones se mantengan libres de contenido NSFW. ¡Únete a nosotros para una experiencia única donde puedes conectar con personajes en un espacio protegido, perfecto para usuarios de todas las edades!

Descubre Dictanote, una versátil aplicación de reconocimiento de voz diseñada para tomar notas de manera sencilla en varios idiomas. Esta herramienta innovadora convierte las palabras habladas en texto, lo que la convierte en una opción ideal para usuarios multilingües que buscan optimizar su proceso de toma de notas.

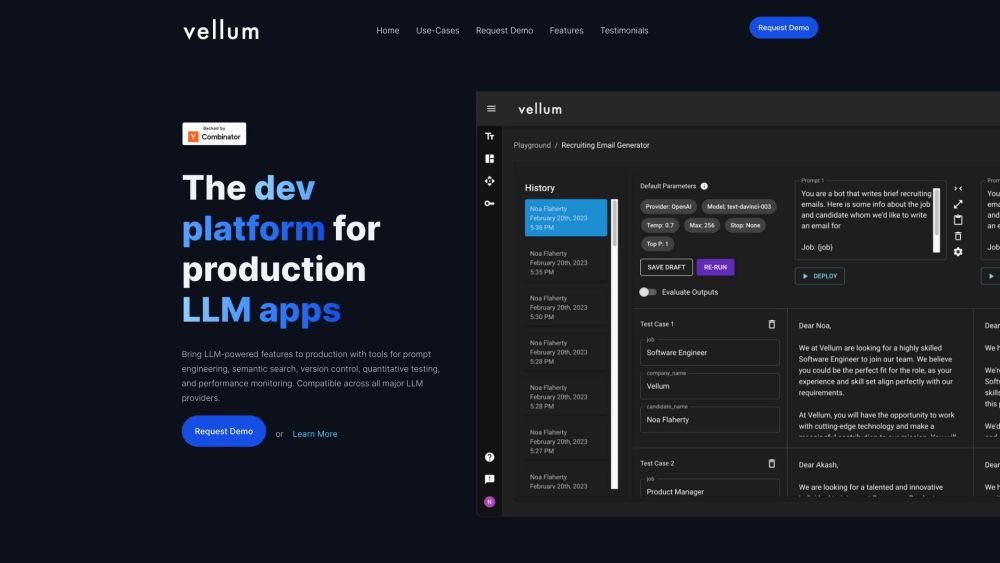

Presentamos una plataforma de desarrollo de vanguardia diseñada específicamente para crear aplicaciones de modelos de lenguaje grande (LLM). Esta plataforma innovadora simplifica el proceso de desarrollo, proporcionando a los desarrolladores las herramientas y recursos necesarios para construir, probar y desplegar soluciones potentes impulsadas por LLM de manera eficiente. Tanto si eres un desarrollador experimentado como si recién comienzas, nuestra plataforma ofrece la flexibilidad y el apoyo para dar vida a tus ideas de IA. ¡Únete a nosotros en la revolución del desarrollo de aplicaciones LLM!

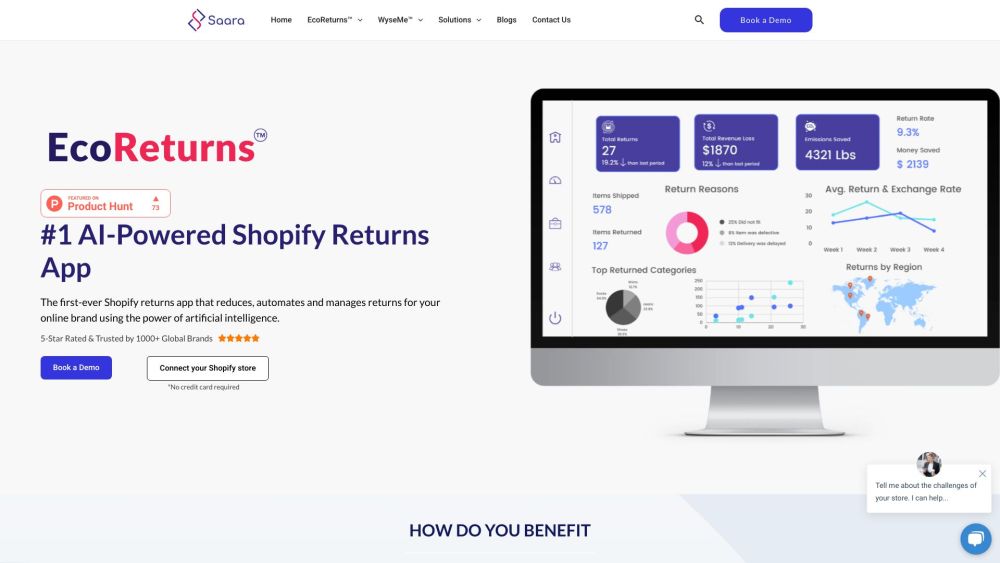

Saara es un software de inteligencia artificial innovador diseñado para mejorar la gestión de devoluciones y aumentar la satisfacción del cliente en el sector del comercio electrónico. Al simplificar procesos y ofrecer información inteligente, Saara permite a los minoristas en línea optimizar su estrategia de devoluciones, garantizando una experiencia de compra sin inconvenientes para sus clientes.

Find AI tools in YBX

Related Articles

Refresh Articles