OpenAI ha atraído la atención de la comunidad tecnológica, así como de profesionales de los medios y las artes, con su nuevo modelo de IA, Sora. Esta innovadora tecnología produce videos realistas y de alta resolución de hasta 60 segundos, aunque aún no está disponible para el público. En febrero de 2024, OpenAI anunció que Sora estaba disponible para pruebas por parte de un grupo selecto de "red teamers" y un pequeño grupo de artistas visuales, diseñadores y cineastas. Sin embargo, los primeros usuarios han comenzado a crear y compartir proyectos utilizando Sora.

Entre ellos se encuentra el escritor y director Paul Trillo, quien fue uno de los primeros en exhibir videos de terceros generados por Sora. Él ha creado lo que se considera el "primer video musical oficial hecho con Sora de OpenAI" para el artista indie chillwave Washed Out (Ernest Weatherly Greene Jr.) y su sencillo "The Hardest Part". El video de 4 minutos presenta una serie de tomas rápidas e interconectadas en diversas escenas, perfectamente unidas para crear la ilusión de un zoom continuo.

En la plataforma de redes sociales X, Trillo reveló que inicialmente concibió la idea del video hace una década, pero la dejó de lado. Compartió que el video final fue elaborado a partir de 55 clips generados por Sora de un total de 700, que luego fueron editados en Adobe Premiere.

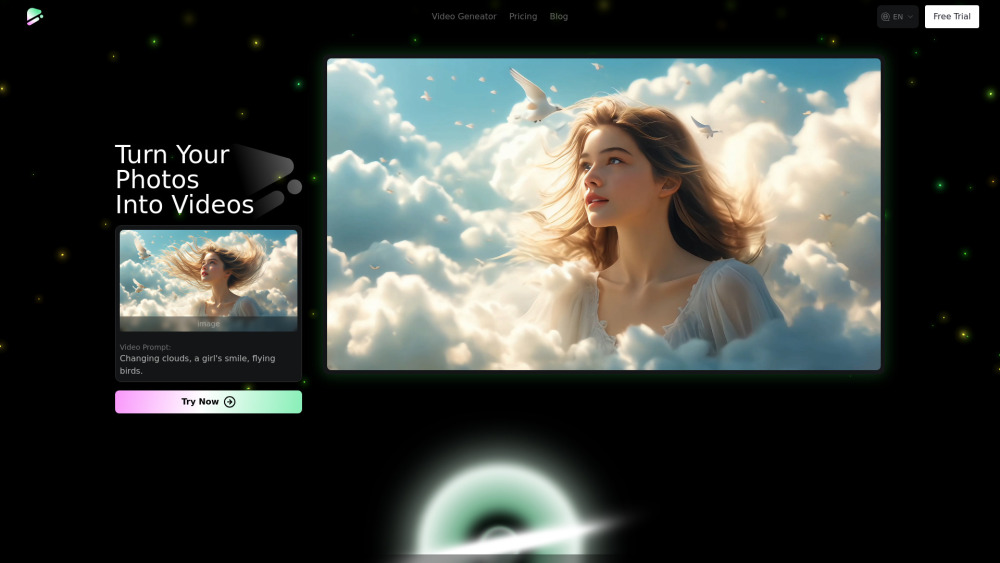

En noticias relacionadas, Adobe ha anunciado planes para integrar Sora y otros modelos de generación de video por IA en su software Premiere Pro. Sin embargo, aún no se ha confirmado un cronograma. Mientras tanto, aquellos que deseen replicar el flujo de trabajo de Trillo necesitarán crear clips de video con IA utilizando otras herramientas como Runway o Pika, ya que Sora aún no está accesible al público.

En una entrevista con el Los Angeles Times, Washed Out expresó su entusiasmo por incorporar nuevas tecnologías en su trabajo, indicando su deseo de explorar técnicas pioneras. La entrevista detalla los prompts específicos utilizados para generar imágenes: Greene enfatizó la importancia de incluir detalles precisos sobre las imágenes, ángulos de toma y movimientos de los personajes. Por ejemplo, Trillo describió una escena así: “Zomeamos a través de la burbuja, estalla, y zoomamos a través del chicle hacia un campo de fútbol abierto”, capturando la naturaleza dinámica e inmersiva del video.

Trillo también destacó que utilizó exclusivamente las capacidades de texto a video de Sora, optando por no incluir imágenes fijas generadas en otros lugares, un enfoque común entre los artistas en el panorama evolutivo del video por IA.

La aparición de Sora ilustra el potencial de la IA en la creación de medios, contrarrestando informes que indican que videos de demostración previos—como “Air Head” del estudio canadiense Shy Kids—se basaban en gran medida en VFX y herramientas de edición tradicionales como el rotoscopio en Adobe After Effects. Además, destaca el interés continuo entre los creativos por aprovechar las herramientas de IA para la narración, a pesar de las críticas de quienes ven estas tecnologías, especialmente las de OpenAI, como explotadoras. Existen preocupaciones sobre el uso de obras previas de los artistas para entrenamiento sin consentimiento ni compensación.