Microsoft lanza ajuste sin servidor para su modelo de lenguaje pequeño Phi-3: mejorando la personalización y la eficiencia.

Most people like

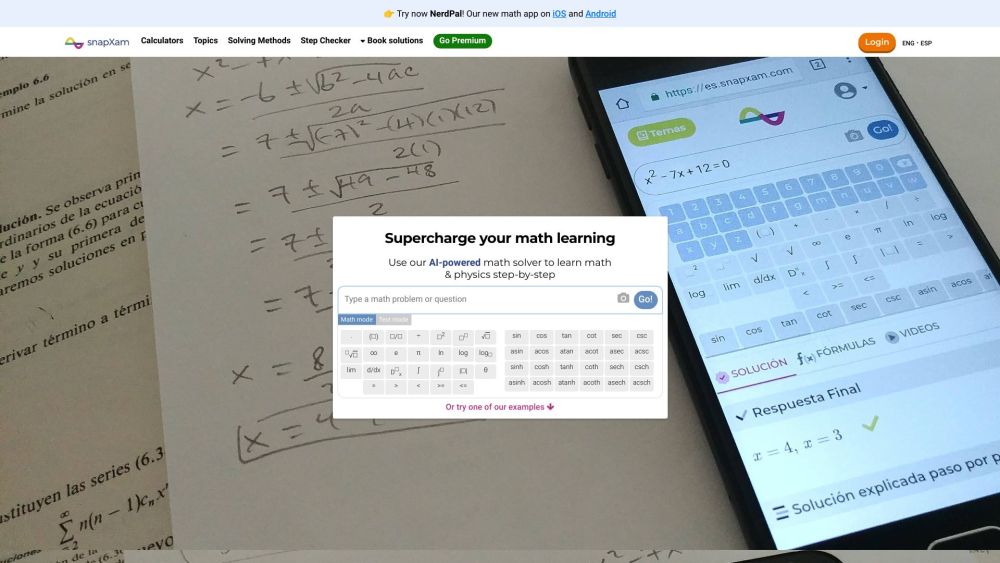

Presentamos el Tutor de Matemáticas y Física Potenciado por IA: Tu Compañero de Aprendizaje Definitivo

Desbloquea tu máximo potencial en matemáticas y física con nuestra avanzada plataforma de tutoría impulsada por IA. Diseñado para ofrecer asistencia personalizada, nuestro tutor de IA se adapta a tu estilo de aprendizaje, ayudándote a comprender conceptos desafiantes y a sobresalir en tus estudios. Vive lecciones personalizadas, comentarios instantáneos y problemas de práctica atractivos que facilitan la comprensión de temas complejos. ¡Descubre el futuro de la educación con el tutor potenciado por IA que transforma tu forma de aprender matemáticas y física!

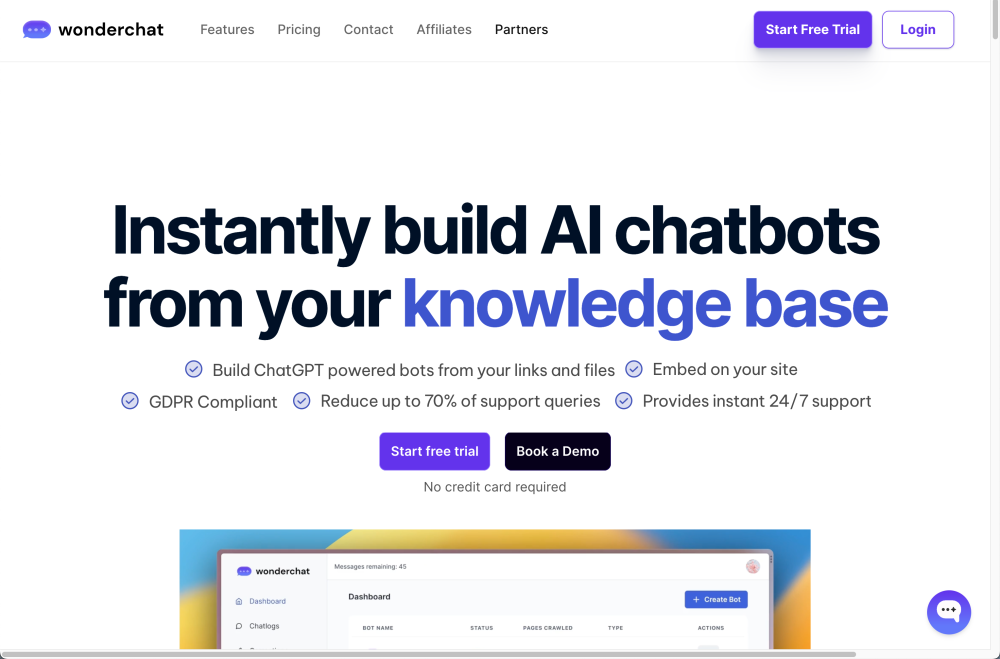

Desata el poder de Wonderchat para crear un chatbot personalizado que eleva la velocidad de respuesta a tus clientes en un 100%, al mismo tiempo que reduce significativamente tu carga de trabajo. ¡Transforma tus interacciones con los clientes y optimiza las operaciones de tu negocio sin esfuerzo!

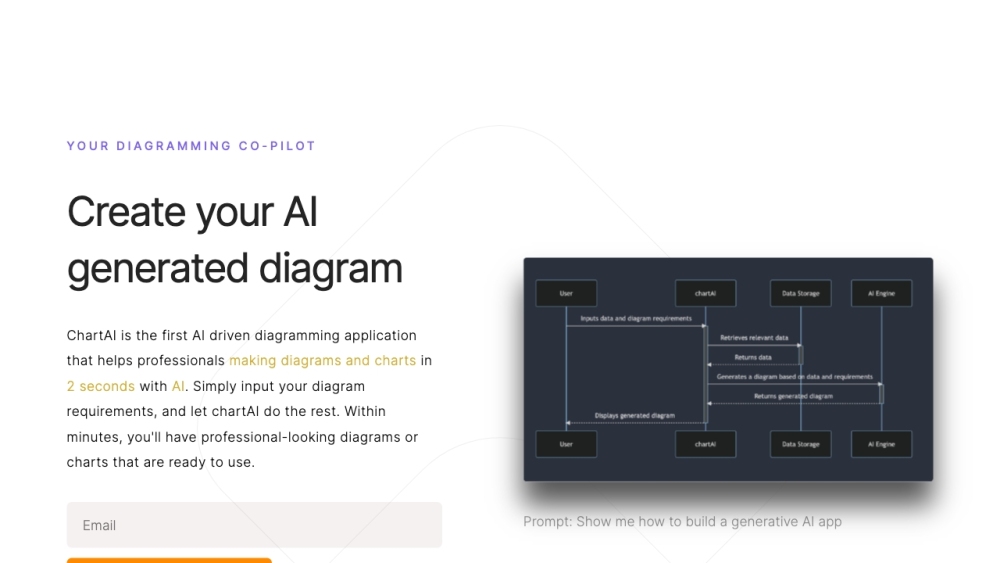

ChartAI aprovecha el poder de ChatGPT para ayudar a los usuarios a crear e interpretar gráficos y diagramas sin esfuerzo. Con su funcionalidad intuitiva, ChartAI convierte datos complejos en representaciones visuales atractivas y comprensibles, mejorando tu experiencia de análisis de datos.

Transforma tu voz: El cambio de voz definitivo para jugar y transmitir

Descubre el cambiador de voz perfecto para mejorar tu experiencia de juego y transmisión. Ya sea que quieras entretener a tu audiencia, añadir un nivel de anonimato o simplemente divertirte, nuestro cambiador de voz mejor calificado potencia tu rendimiento y mantiene tus interacciones cautivadoras. Con una variedad de efectos personalizables y funciones fáciles de usar, puedes crear sonidos únicos que se adapten a tu estilo de juego o personalidad en streaming. ¡Explora las infinitas posibilidades y lleva tu contenido al siguiente nivel!

Find AI tools in YBX

Related Articles

Refresh Articles