Optimiza la gobernanza de proyectos de IA con el Centro de Integraciones de Credo AI para Amazon, Microsoft y otras plataformas.

Most people like

Experimenta un CMS de blogging encantador, diseñado para una gestión de contenido sin esfuerzo y un compartir fluido. Mejora tu experiencia de blogging con herramientas intuitivas que simplifican la creación y distribución. Perfecto para bloggers de todos los niveles, este CMS optimiza tu flujo de trabajo mientras conecta eficazmente con tu audiencia.

Descubre Leo AI, ¡la mejor inteligencia artificial para estudiantes! La herramienta perfecta para ayudarte con tus deberes y repasos.

Desbloquea tu potencial creativo creando impresionantes paletas de colores que den vida a tus diseños. Previsualiza estas paletas en proyectos reales para ver cómo mejoran la estética y el impacto. Ya seas diseñador o un entusiasta del bricolaje, dominar las combinaciones de colores puede llevar tu trabajo al siguiente nivel.

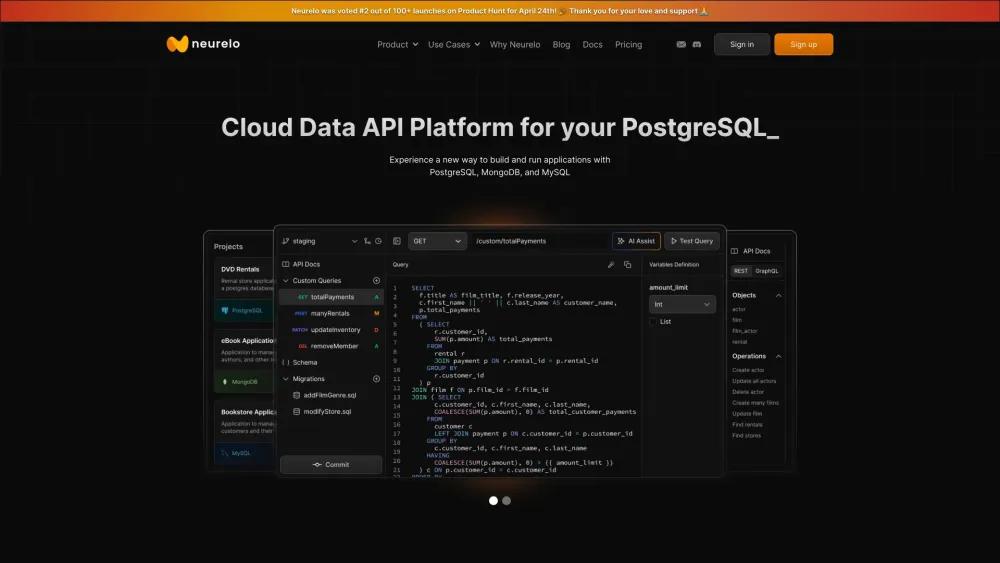

En el mundo actual impulsado por los datos, las API de bases de datos potenciadas por IA están revolucionando la forma en que las empresas interactúan y gestionan su información. Aprovechando la inteligencia artificial, estas API agilizan la recuperación de datos, mejoran la precisión y facilitan procesos de toma de decisiones más inteligentes. Ideales tanto para desarrolladores como para empresas, las API de bases de datos impulsadas por IA no solo optimizan el rendimiento, sino que también fomentan la innovación al permitir que las organizaciones aprovechen todo el potencial de sus datos. Descubre el impacto transformador de las API de bases de datos potenciadas por IA y cómo pueden elevar tus estrategias de gestión de datos.

Find AI tools in YBX

Related Articles

Refresh Articles