GPT-4の秘密を解明:『ゼロ推論』主張の戦略と秘訣を明らかに

Most people like

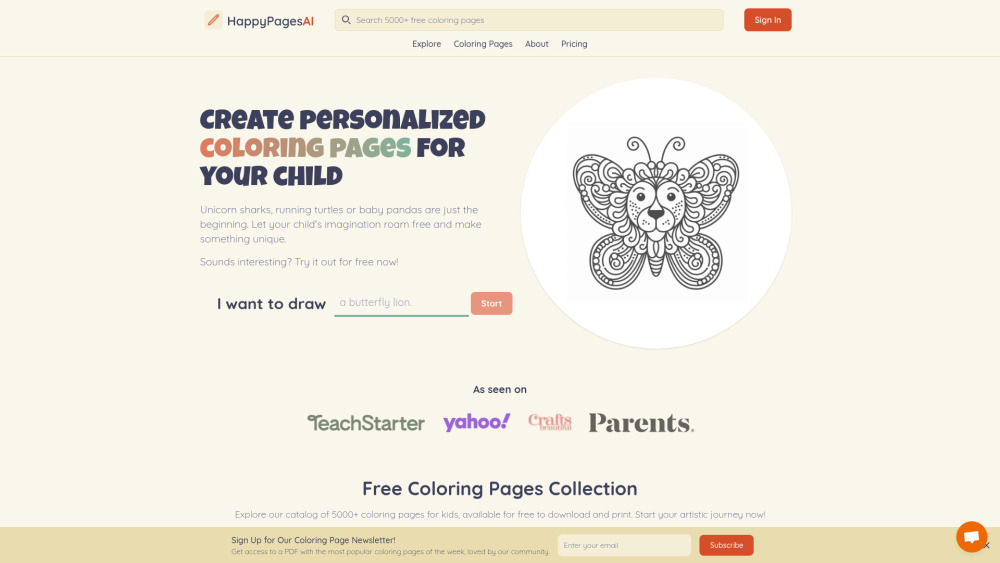

あなたの創造力をAI塗り絵生成ツールで変革しましょう。このツールは、あなた専用のユニークでパーソナライズされた塗り絵ページを作成します。複雑なパターンや遊び心あふれるイラストを求めている場合でも、この革新的なツールはあなたの芸術的才能を引き出し、何時間でも楽しめる塗り絵体験を提供します。子供から大人まで楽しめるこのジェネレーターは、想像力をかき立て、無限のエンターテインメントを提供するカスタムデザインの入り口です。

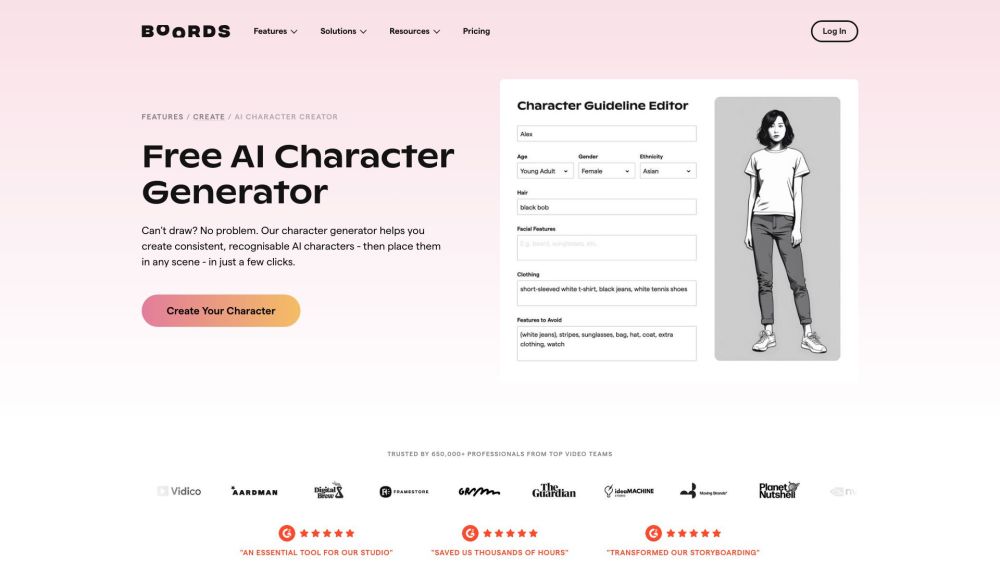

人工知能を使って、あなたの想像上のキャラクターを簡単に生み出したいですか?このガイドでは、注目を集め、創造性を刺激する魅力的なAIキャラクターを生成する方法を紹介します。キャラクター作成を簡単で魅力的、かつプロジェクトに合わせてカスタマイズできるツールやテクニックを発見しましょう。AIを活用して、あなたの創造的な可能性を解き放つ準備をしましょう!

Find AI tools in YBX

Related Articles

Refresh Articles