뉴스 출처로 AI 챗봇에 의존하지 말아야 하는 이유

Most people like

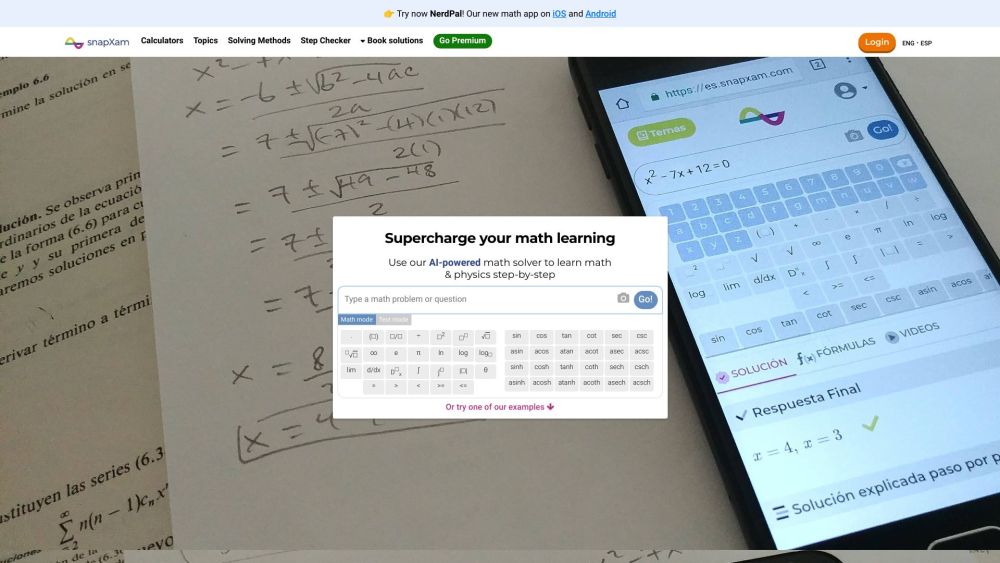

AI 기반 수학 및 물리 튜터 소개: 당신의 궁극적인 학습 동반자

우리의 고급 AI 튜터링 플랫폼과 함께 수학과 물리에서 당신의 잠재력을 최대한 발휘하세요. 개인 맞춤형 지원을 제공하도록 설계된 AI 튜터는 당신의 학습 스타일에 맞춰 조정되어 어려운 개념을 이해하고 학업 성취를 도와줍니다. 복잡한 주제를 쉽게 이해할 수 있도록 맞춤형 수업, 즉각적인 피드백, 흥미로운 연습 문제를 경험하세요. 수학과 물리를 배우는 방식을 혁신하는 AI 기반 튜터와 함께 교육의 미래를 발견하세요!

오늘날의 빠르게 변화하는 디지털 환경에서 지식 공유 플랫폼은 집단 지성을 활용하는 데 중요한 역할을 합니다. 개인과 조직이 아이디어와 자원을 교환할 수 있는 중앙화된 공간을 제공함으로써 이러한 플랫폼은 협업과 혁신을 촉진합니다. 이는 사용자들이 다양한 통찰을 접할 수 있게 할 뿐만 아니라, 정보에 기반한 의사 결정과 효율적인 문제 해결을 이끕니다. 강력한 지식 공유 플랫폼이 집단 지성을 어떻게 강화하고 우리가 함께 배우고 일하는 방식을 변화시킬 수 있는지 함께 살펴보겠습니다.

궁극의 여행 가이드와 제품 리뷰 허브를 만나보세요! 저희 플랫폼은 모험가와 똑똑한 쇼핑객 모두를 위해 설계되었으며, 최고의 목적지와 필수 아이템에 대한 심층 정보를 제공합니다. 다음 여행을 계획 중이거나 최고의 장비를 찾고 있다면, 신뢰할 수 있는 정보와 전문가 리뷰를 통해 경험을 한층 더 높일 수 있습니다. 가이드와 리뷰를 통해 세상을 함께 발견해 보세요!

Find AI tools in YBX

Related Articles

Refresh Articles