백악관, 딥페이크 포르노 예방을 위한 AI 기업들의 자발적 약속 확보

Most people like

오늘날 데이터 처리 능력이 중요한 디지털 환경에서, GPU 임대 서비스는 기업과 개인 모두에게 혁신적인 솔루션으로 자리잡고 있습니다. 고성능 그래픽 처리 장치(GPU)를 활용함으로써, 사용자들은 하드웨어 구매에 따른 높은 초기 비용 없이 쉽게 컴퓨팅 자원을 확장할 수 있습니다. 게임 이용자, 개발자, 데이터 과학자 누구든지 GPU 임대는 특정 요구에 맞춘 유연성과 효율성을 제공합니다. GPU 서비스가 어떻게 프로젝트를 향상시키고, 렌더링 시간을 단축하며, 혁신을 이끄는 데 필요한 계산 능력을 제공하는지 알아보세요.

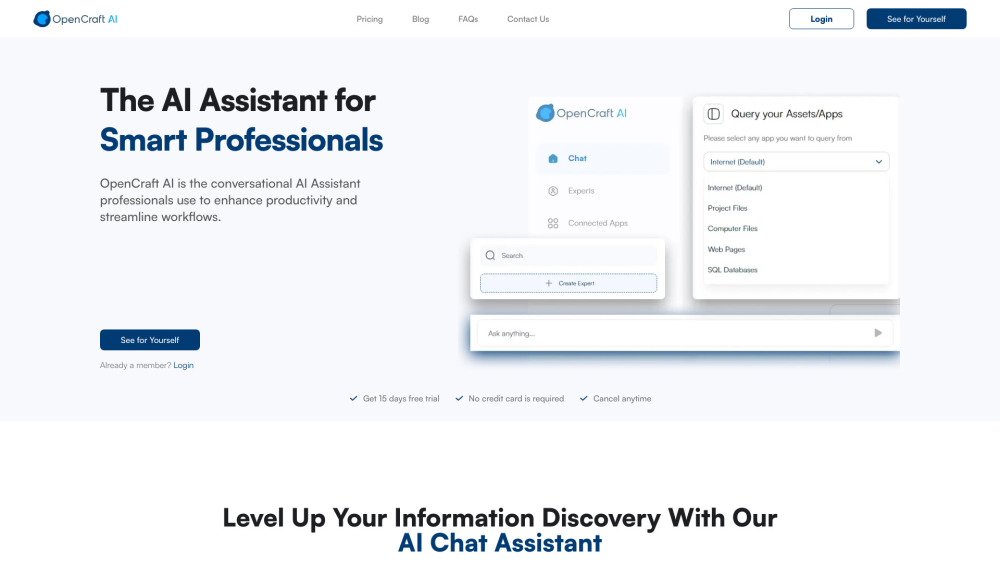

전문가를 위해 설계된 AI 어시스턴트의 힘을 활용하여 생산성을 높이고 워크플로를 최적화하세요. 이 혁신적인 도구는 작업을 간소화하여 여러분이 업무에서 진정으로 중요한 것에 집중할 수 있게 합니다. 전문 어시스턴트와 함께 새로운 차원의 효율성을 경험해 보세요.

AI 기반 SEO 콘텐츠 최적화 플랫폼으로 디지털 존재감을 높이세요. 웹사이트의 가시성과 참여도를 증대시키기 위해 설계되었습니다. 지능형 인사이트와 맞춤 추천으로 콘텐츠의 잠재력을 극대화하고, 경쟁이 치열한 온라인 환경에서 앞서 나가세요. 최첨단 기술을 활용하여 효과적인 SEO 전략을 수립하고 트래픽이 급증하는 것을 경험하세요!

Find AI tools in YBX

Related Articles

Refresh Articles