前OpenAI超对齐负责人批评公司:‘安全文化与流程被忽视’

Most people like

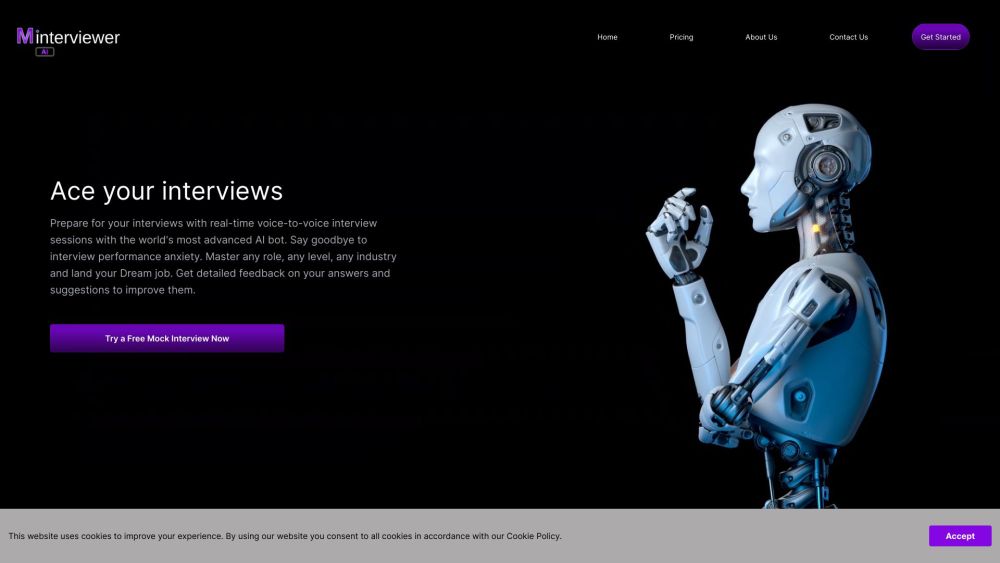

实时模拟面试与AI智能反馈

在快速变化的就业市场中,模拟面试和AI反馈成为求职者必备的工具。通过实时模拟面试,求职者可以在一个安全、无压力的环境中练习与面试官的应对。与此同时,AI反馈提供精准分析,帮助求职者不断改进回答技术和自信心。结合这两种先进方式,求职者将为真正的面试做好更充分的准备,提高成功率,顺利进入理想的职业生涯。

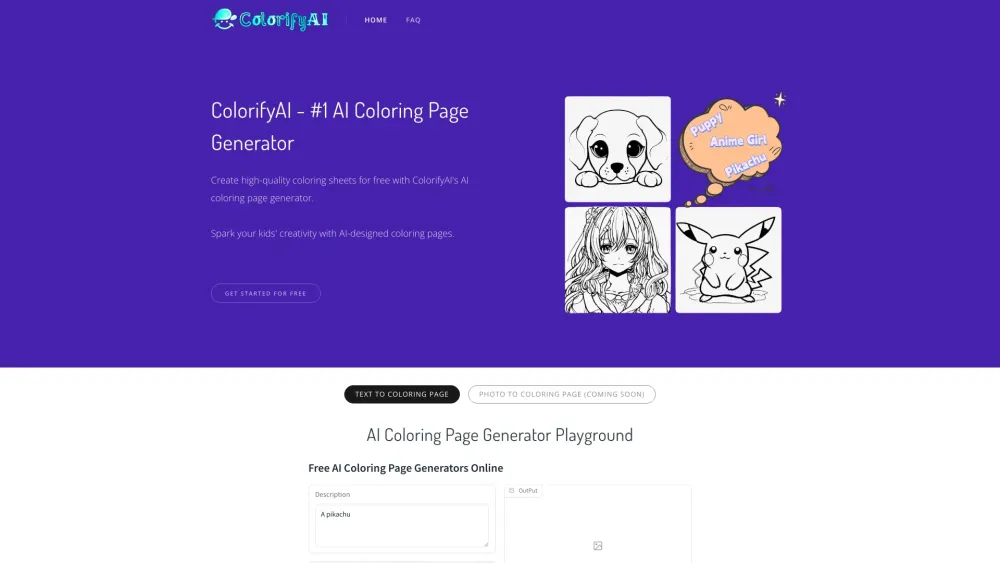

AI彩色页面生成器:提升创意设计的全新工具

在当今设计领域,AI彩色页面生成器正迅速崛起,成为创作和视觉呈现的重要帮手。无论是插图、海报还是网页设计,这一创新工具能够自动生成丰富多彩的设计页面,极大地节省了时间并提升了效果。让我们一起探索这个强大的工具,如何帮助设计师提高工作效率,激发无限创意,为您的项目增添活力。

Find AI tools in YBX

Related Articles

Refresh Articles