Si esperabas que la locura de la IA disminuyera en 2024, prepárate para una sorpresa. Los avances en hardware y software están desbloqueando amplias aplicaciones de la IA generativa (IA gen), indicando que 2023 solo rasguñó la superficie de lo que es posible.

Este año, conocido como el Año del Dragón en el Zodiaco chino, presenciará una integración estratégica de la IA generativa en todos los sectores. Con los riesgos evaluados y las estrategias en marcha, las empresas están listas para incorporar la IA gen como un componente central de sus operaciones. Los CEOs y líderes empresariales ahora reconocen el potencial y la necesidad de la IA generativa, integrando activamente estas tecnologías en sus procesos.

El panorama en evolución posiciona la IA gen no solo como una opción, sino como un motor clave de innovación, eficiencia y competitividad. Este cambio fundamental marca 2024 como el año en que la IA generativa pasa de ser una tendencia emergente a una práctica empresarial esencial.

Volumen y Variedad

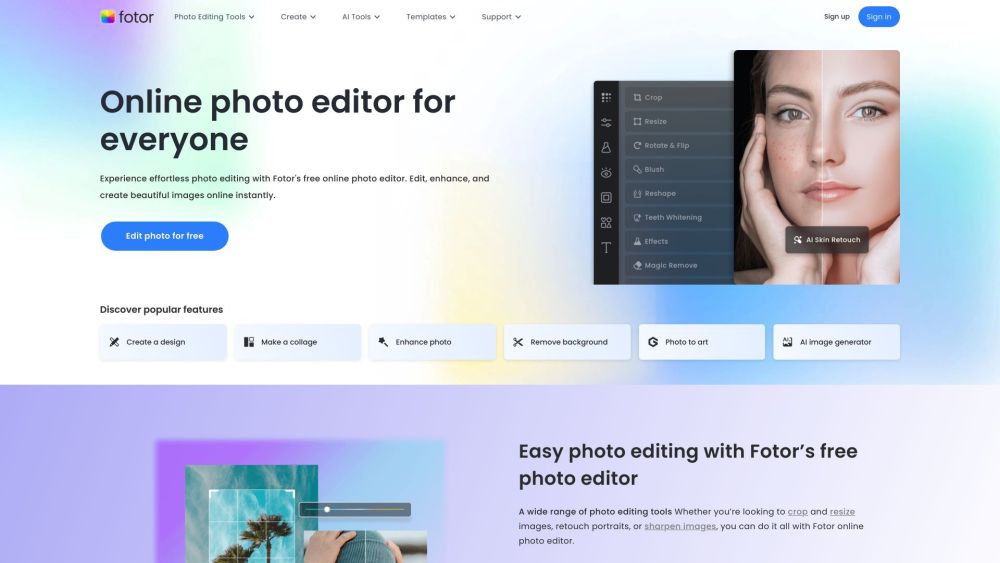

Un aspecto significativo de esta transformación es el creciente reconocimiento de cómo la IA generativa mejora tanto el volumen como la variedad de aplicaciones, ideas y contenido. La cantidad de contenido generado por IA es asombrosa; desde 2022, los usuarios de IA han creado más de 15 mil millones de imágenes, un logro que antes le habría tomado a los humanos 150 años. Esta monumental producción transformará la forma en que los historiadores analicen Internet después de 2023, similar al impacto de la bomba atómica en la datación por carbono radiactivo.

Para las empresas, esta expansión eleva los estándares en todos los campos, marcando un momento crítico donde no involucrarse con la tecnología puede significar no solo oportunidades perdidas, sino también desventajas competitivas.

La Frontera Irregular

En 2023, aprendimos que la IA generativa mejora tanto los estándares de la industria como las capacidades de los empleados. Una encuesta de YouGov reveló que el 90% de los trabajadores creen que la IA aumenta la productividad. Uno de cada cuatro encuestados utiliza IA a diario, mientras que el 73% lo hace al menos semanalmente.

Además, estudios indican que los empleados bien capacitados completan el 12% de las tareas un 25% más rápido con la ayuda de la IA generativa, mejorando la calidad del trabajo en un 40%, siendo las ganancias más significativas en trabajadores menos cualificados. Sin embargo, cuando las tareas están fuera del alcance de la IA, los empleados tienen un 19% menos de probabilidades de producir soluciones correctas.

Esta coexistencia de fortalezas y debilidades ha dado lugar a lo que los expertos llaman la "frontera irregular" de las capacidades de IA. Por un lado, vemos a la IA realizar tareas que antes se consideraban imposibles para las máquinas con una precisión notable. Por otro lado, la IA enfrenta dificultades donde la intuición y adaptabilidad humana son cruciales, en áreas marcadas por matices y decisiones complejas.

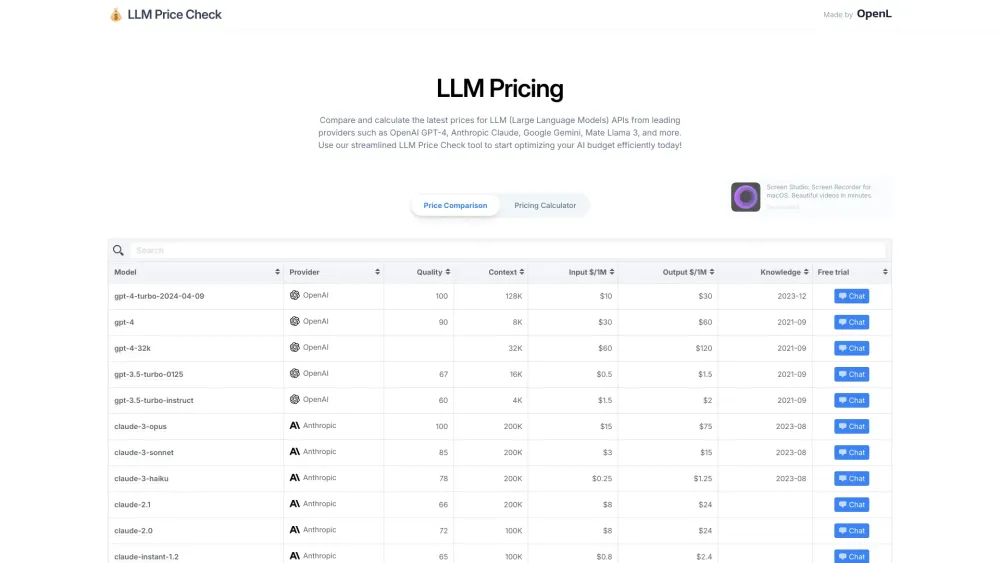

IA Más Barata

A medida que las empresas aprenden a navegar por esta frontera irregular, podemos esperar que los proyectos de IA generativa se conviertan en algo común. Contribuyendo a esta tendencia está la disminución del costo para entrenar modelos de lenguaje grandes (LLMs), gracias a los avances en la optimización del silicio que reducen los costos a la mitad cada dos años.

Con la demanda mundial en aumento en medio de escaseces globales, se prevé que el mercado de chips de IA se vuelva más asequible en 2024, a medida que surjan alternativas a líderes de la industria como Nvidia. Además, nuevos métodos de ajuste fino, como el Fine-tuning por Auto-juego (SPIN), pueden fortalecer LLMs débiles sin requerir datos adicionales etiquetados por humanos, aprovechando los datos sintéticos para maximizar la eficiencia.

Bienvenido al ‘Modelverse’

Esta reducción de costos está allanando el camino para que más empresas desarrollen e implementen sus propios LLMs, desencadenando una ola de aplicaciones innovadoras en los próximos años. Para 2024, también veremos una transición de modelos principalmente basados en la nube a IA ejecutada localmente, impulsada por avances en hardware como Apple Silicon y el potencial inexplorado de dispositivos móviles cotidianos.

Los pequeños modelos de lenguaje (SLMs) ganarán popularidad entre empresas medianas y grandes, atendiendo necesidades más específicas y de nicho. A diferencia de los LLMs, que manejan conjuntos de datos vastos, los SLMs se centran en datos específicos del dominio obtenidos internamente, asegurando relevancia y privacidad.

Un Cambio hacia Modelos de Visión Grandes (LVMs)

A medida que se desarrolla 2024, la atención se desplazará de los LLMs a los modelos de visión grandes (LVMs), especialmente aquellos adaptados a dominios específicos que mejoran el procesamiento de datos visuales. Mientras que los LLMs entrenados en texto de internet se adaptan bien a documentos propios, los LVMs entrenados principalmente con imágenes genéricas de internet tienen dificultades con contenido visual especializado utilizado en campos como la manufactura y las ciencias de la vida.

Las investigaciones muestran que adaptar un LVM a un dominio específico utilizando alrededor de 100,000 imágenes no etiquetadas puede reducir significativamente la necesidad de datos etiquetados, mejorando los niveles de rendimiento. Estos modelos enfocados sobresalen en tareas como la detección de defectos y la ubicación de objetos, superando a los LVMs genéricos en aplicaciones específicas del dominio.

Paralelamente, veremos a las empresas adoptar modelos gráficos grandes (LGMs), que son hábiles en procesar datos tabulares comúnmente encontrados en hojas de cálculo. Su capacidad para analizar datos de series temporales ofrece nuevos conocimientos sobre datos empresariales secuenciales, asegurando una mejor comprensión de las operaciones de la empresa.

Consideraciones Éticas

Estos avances conllevan la necesidad de una supervisión ética rigurosa. Las experiencias pasadas con tecnologías de propósito general como los teléfonos inteligentes y las redes sociales han resaltado la necesidad de marcos regulatorios para evitar impactos sociales negativos. Si bien la IA generativa ofrece beneficios inmensos, su evolución debe ser guiada para prevenir errores que podrían conducir a problemas generalizados.

Un dilema ético importante en torno a la IA generativa es el copyright. A medida que estas tecnologías evolucionan, plantean preguntas urgentes sobre los derechos de propiedad intelectual relacionados con el contenido generado por IA que se basa en obras creadas por humanos existentes para su entrenamiento. El desafío radica en si este contenido debería estar sujeto a las leyes de copyright y cómo.

La tensión entre la IA y el copyright es significativa porque las leyes de copyright tradicionales buscan prevenir el uso ilegal de la propiedad intelectual ajena. Si bien inspirarse es permisible, replicar no lo es. A diferencia de una persona limitada en el consumo de datos, la IA puede analizar volúmenes vastos de información, complicando la delgada línea entre inspiración y replicación.

Estamos a punto de ver casos históricos como NYT vs. OpenAI dar forma al debate sobre el copyright e influir en cómo los medios se adaptan a un nuevo paisaje impulsado por la IA en 2024.

Deepfakes e Implicaciones Políticas

En el frente geopolítico, 2024 estará dominado por la intersección de la IA con elecciones críticas en todo el mundo. Más de la mitad de la población global acudirá a las urnas, con elecciones programadas en naciones importantes como EE. UU., India y Sudáfrica.

Las campañas de desinformación ya han surgido, como se evidenció en Bangladés, donde influencers pro-gobierno utilizaron herramientas de IA de bajo costo para promover narrativas falsas. Un deepfake, que fue eliminado posteriormente, mostraba a una figura de la oposición retractándose de su apoyo a la solidaridad con Palestina—una narrativa impactante en una nación predominantemente musulmana.

La amenaza que representan las imágenes generadas por IA no es hipotética; estudios demuestran que las pequeñas alteraciones creadas para engañar a la IA pueden afectar igualmente la percepción humana. Este hallazgo resalta la necesidad de más investigaciones sobre el impacto de las imágenes adversariales tanto en humanos como en sistemas de IA.

A medida que crece el llamado a la inclusión de marcas de agua y credenciales de contenido para distinguir el contenido auténtico del sintético, persisten los desafíos. La efectividad de la detección, el posible mal uso y el mantenimiento de la distinción entre medios reales y manipulados se volverán primordiales.

Con la confianza pública en niveles históricos bajos, 2024 promete combinar eventos electorales significativos con tecnologías de IA transformadoras. Este año, sin duda, mostrará el profundo impacto y las aplicaciones de la IA en la política y más allá. Prepárate para lo que se avecina.