Microsoft se une a Coalition para erradicar la pornografía de venganza y los deepfakes de Bing.

Most people like

Revoluciona tu productividad con un asistente de IA multifuncional diseñado para mejorar la eficiencia en el trabajo y el estudio. Ya sea que estés enfrentando una fecha límite de proyecto o sumergiéndote en tus estudios, esta herramienta avanzada se adapta a tus necesidades, optimizando tareas y maximizando tu rendimiento. Abraza el futuro del trabajo y el aprendizaje con una tecnología que eleva tu eficacia y eficiencia.

Sumérgete en cautivadores diálogos centrados en personajes en Joyland, donde cada interacción invita a una exploración y participación más profundas.

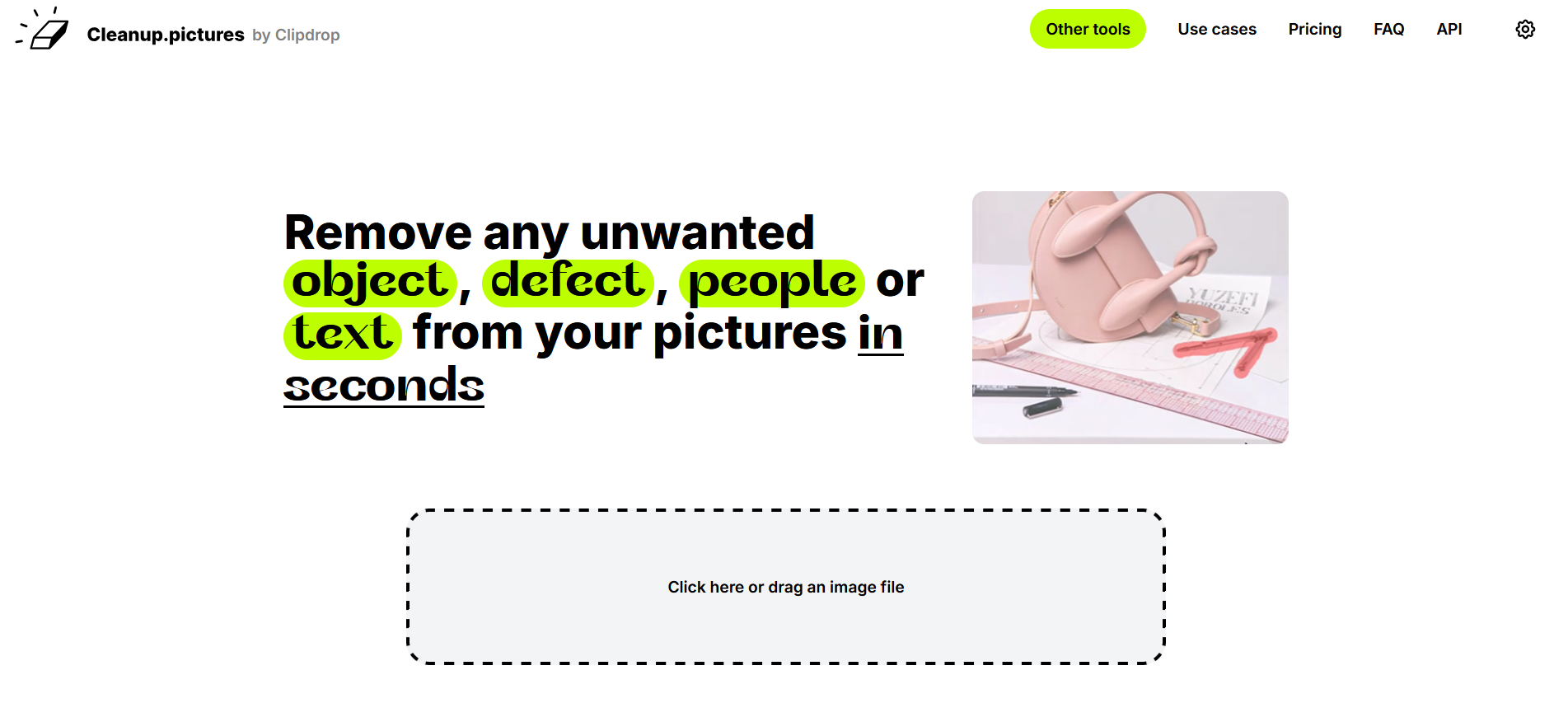

Cleanup.pictures es una aplicación web gratuita que permite a los usuarios eliminar objetos, personas, texto y defectos de cualquier imagen.

CheatGPT es una innovadora herramienta de estudio basada en IA, diseñada para ofrecer a los estudiantes respuestas instantáneas y valiosa asistencia en exámenes. Ya sea que estés enfrentando materias complejas o preparándote para pruebas, CheatGPT proporciona el apoyo necesario para mejorar tu experiencia de aprendizaje de manera efectiva.

Find AI tools in YBX

Related Articles

Refresh Articles