El equipo de investigación de Apple presenta un sistema de IA con la capacidad de 'visión' para comprender el contenido de la pantalla.

Most people like

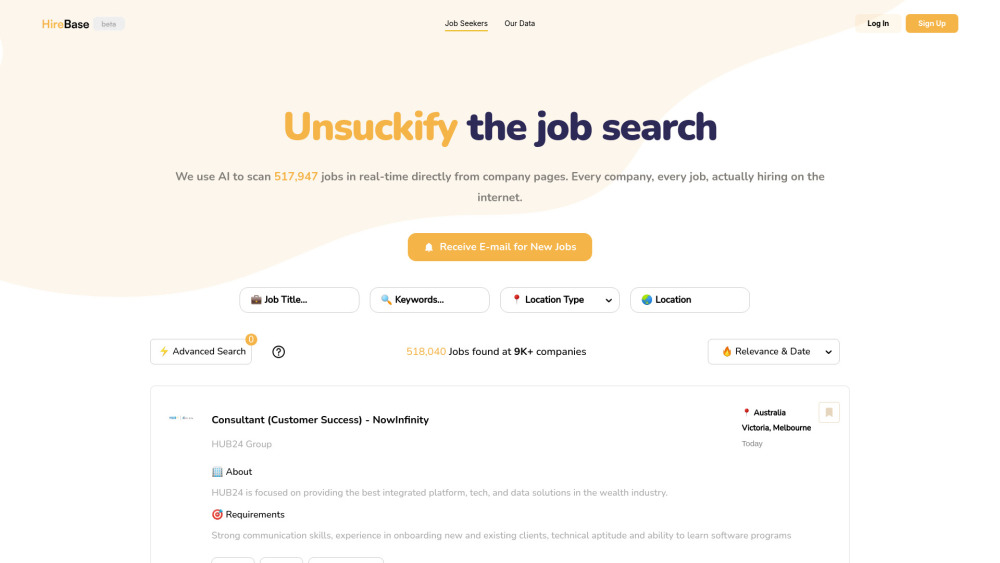

Presentamos el innovador motor de búsqueda de empleo con inteligencia artificial, diseñado para ofrecer indexación de trabajos en tiempo real para quienes buscan empleo. Nuestra plataforma simplifica tu búsqueda laboral al proporcionar acceso instantáneo a las últimas ofertas de trabajo, adaptadas a tus habilidades y preferencias específicas. ¡Encuentra el trabajo de tus sueños hoy mismo con nuestras capacidades impulsadas por IA!

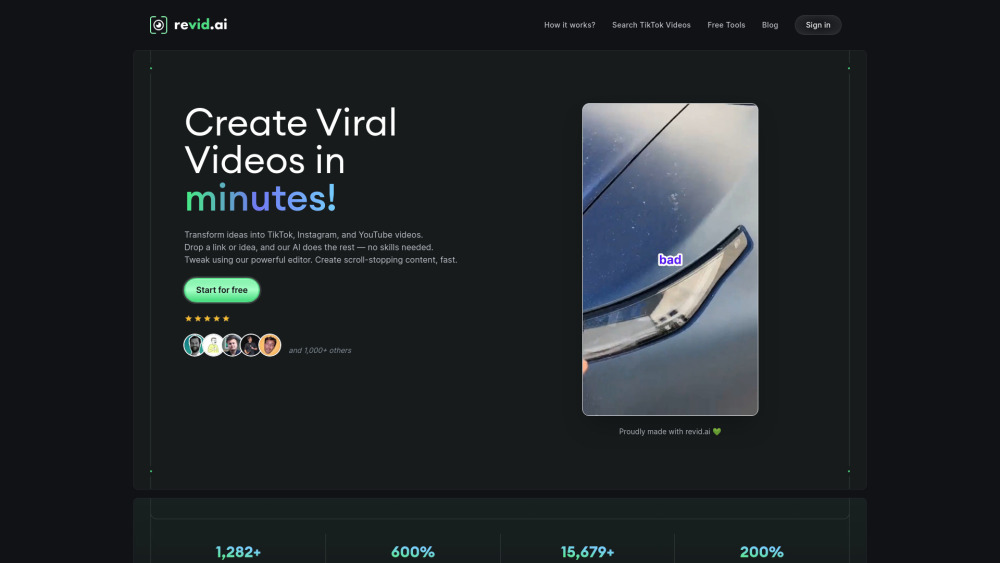

Descubre el poder de una herramienta impulsada por IA diseñada para crear videos cortos virales de forma sencilla. Esta solución innovadora aprovecha la inteligencia artificial avanzada para optimizar la producción de videos, asegurando que tu contenido no solo capte la atención, sino que también resuene con los espectadores. Ya seas creador de contenido, comercializador o propietario de un negocio, esta herramienta facilita la creación de videos atractivos y compartibles como nunca antes. ¡Adopta el futuro del marketing en video y observa cómo crece tu audiencia!

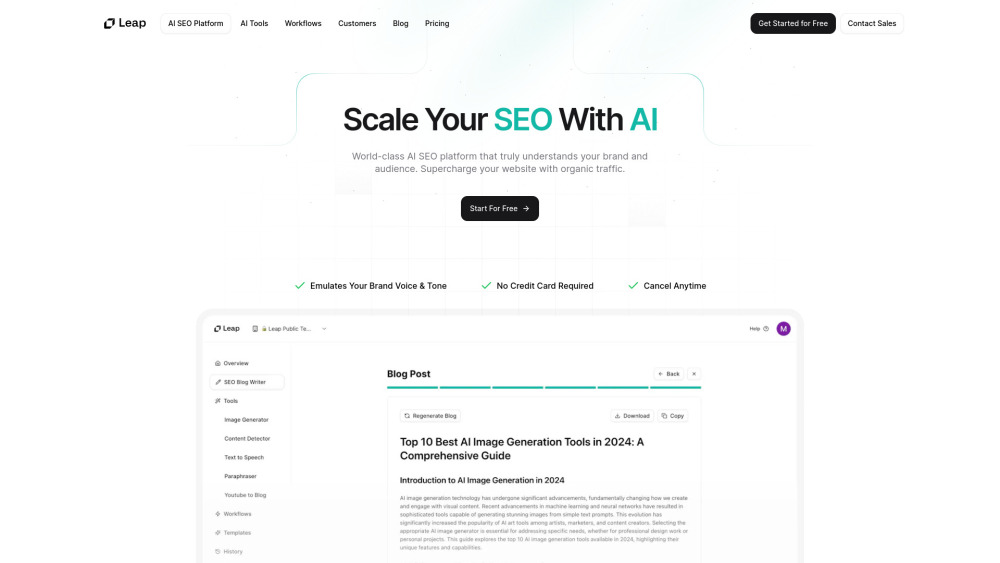

Desbloquea el potencial de tu presencia en línea con nuestra avanzada herramienta de SEO AI, diseñada específicamente para ayudarte a generar contenido SEO de alta calidad. Mejora la visibilidad y el compromiso de tu sitio web aprovechando algoritmos de vanguardia que analizan tendencias y optimizan tu redacción para motores de búsqueda. Crea contenido atractivo, relevante y rico en palabras clave que resuene con tu audiencia mientras mejoras tu clasificación en los resultados de búsqueda. ¡Abraza el futuro de la creación de contenido y observa cómo tu visibilidad se eleva!

Find AI tools in YBX

Related Articles

Refresh Articles