Des experts du MIT plaident en faveur d'une gouvernance et d'une régulation renforcées de l'IA.

Most people like

Transformez vos invites textuelles en vidéos époustouflantes grâce à un générateur de vidéos AI ! Créez un contenu visuel impressionnant sans effort, en exploitant la puissance de l'intelligence artificielle pour donner vie à vos idées.

Castmagic est une plateforme d'IA innovante conçue pour transformer de longs enregistrements audio en ressources de contenu précieuses. Que vous soyez créateur de contenu, podcaster ou éducateur, Castmagic facilite la réutilisation de votre audio en formats engageants qui peuvent améliorer votre productivité et élargir votre portée.

Imaginez donner vie à votre compagnon de rêve grâce à la puissance de l'intelligence artificielle. Une petite amie virtuelle personnalisée peut non seulement engager des conversations significatives, mais aussi s'adapter à vos intérêts et préférences, rendant chaque interaction unique. Dans ce guide, nous explorerons comment concevoir votre parfaite petite amie IA, conçue pour satisfaire vos désirs et enrichir votre quotidien. Préparez-vous à partir en voyage vers la création d'une relation qui vous appartient entièrement.

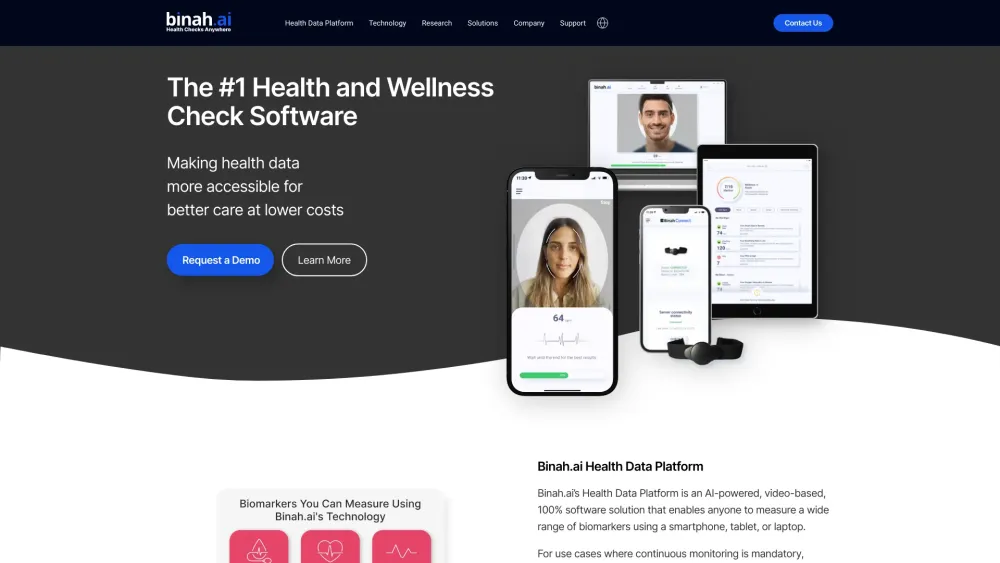

Révolutionner la santé : surveillance en temps réel grâce à la technologie vidéo

Découvrez comment la technologie vidéo transforme la surveillance de la santé en temps réel, offrant des solutions innovantes pour suivre les indicateurs de santé de manière efficace. Cette approche de pointe améliore non seulement les soins aux patients, mais permet également aux individus de prendre le contrôle de leur bien-être. Explorez le potentiel de cette technologie pour révolutionner le paysage des soins de santé.

Find AI tools in YBX

Related Articles

Refresh Articles