La désinformation alimentée par l'IA bouleverse les Big Four en conseil.

Most people like

Découvrez un éditeur de documents propulsé par l'IA, rapide comme l'éclair, qui simplifie votre processus d'écriture grâce à des fonctionnalités telles que la rédaction, la transformation de texte et l'assistance rédactionnelle experte.

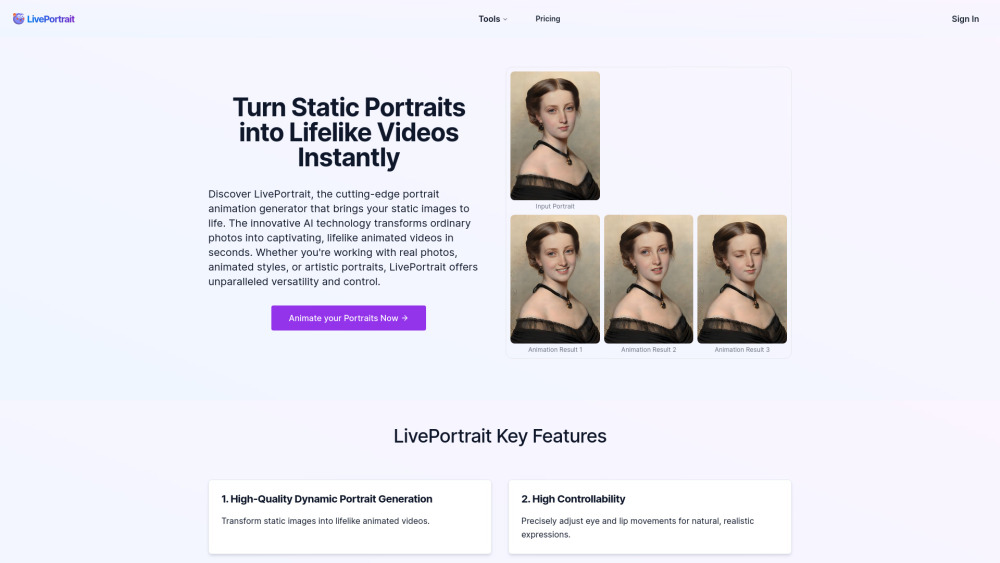

Dans le paysage numérique en évolution rapide d'aujourd'hui, le générateur d'animation de portraits par IA se distingue comme un outil révolutionnaire. Cette technologie innovante permet aux utilisateurs de donner vie à des images fixes, créant des animations dynamiques qui capturent l'essence des émotions et des expressions d'un sujet. Que ce soit pour des projets personnels, du contenu sur les réseaux sociaux ou des présentations professionnelles, exploiter la puissance de l'animation de portraits alimentée par l'IA peut élever votre narration visuelle et votre engagement. Découvrez comment cet outil de pointe peut révolutionner votre manière d'animer des portraits, les transformant en expériences animées captivantes qui résonnent avec le public.

Améliorez vos compétences linguistiques avec notre plateforme de pratique linguistique alimentée par l'IA. Cet outil innovant propose des expériences d'apprentissage personnalisées qui s'adaptent à vos besoins uniques, vous aidant à atteindre la fluidité et la confiance en un rien de temps.

Find AI tools in YBX

Related Articles

Refresh Articles