Microsoft Met à Jour Ses Conditions d'Utilisation : Nouvelles Directives pour Utiliser en Toute Sécurité les Outils d'IA

Most people like

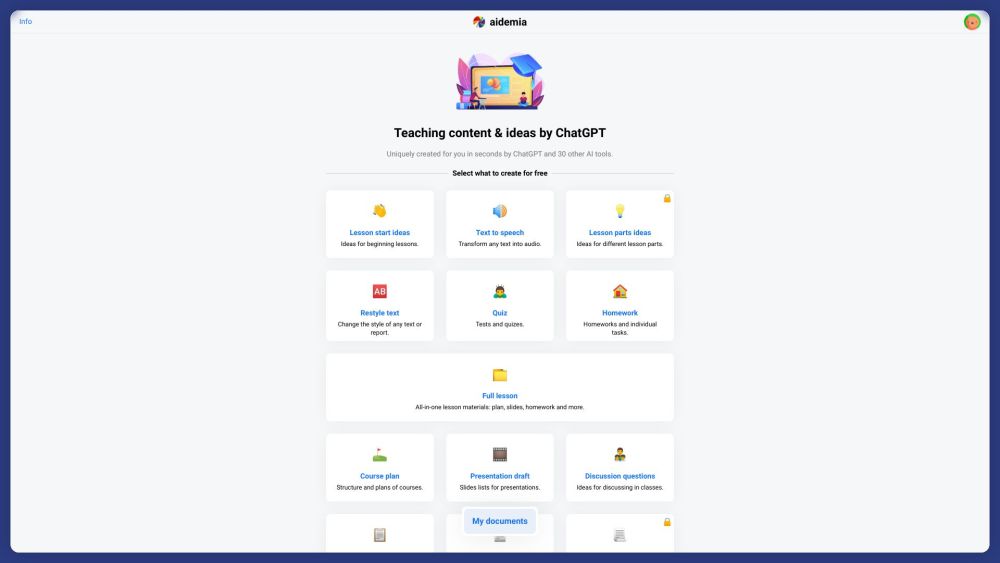

Aidemia est une plateforme innovante alimentée par l'IA, conçue pour créer du contenu éducatif personnalisé et inspirer des idées créatives.

Découvrez la puissance de notre outil d'IA conçu spécifiquement pour convertir les Twitter Spaces en texte. Transcrivez facilement conversations, conférences et discussions des Twitter Spaces, en capturant chaque moment clé sans effort. Grâce à notre technologie avancée, améliorez l'accessibilité, prenez des notes ou réutilisez du contenu pour des blogs et des articles. Rejoignez la communauté grandissante qui exploite l'IA pour optimiser son expérience des Twitter Spaces !

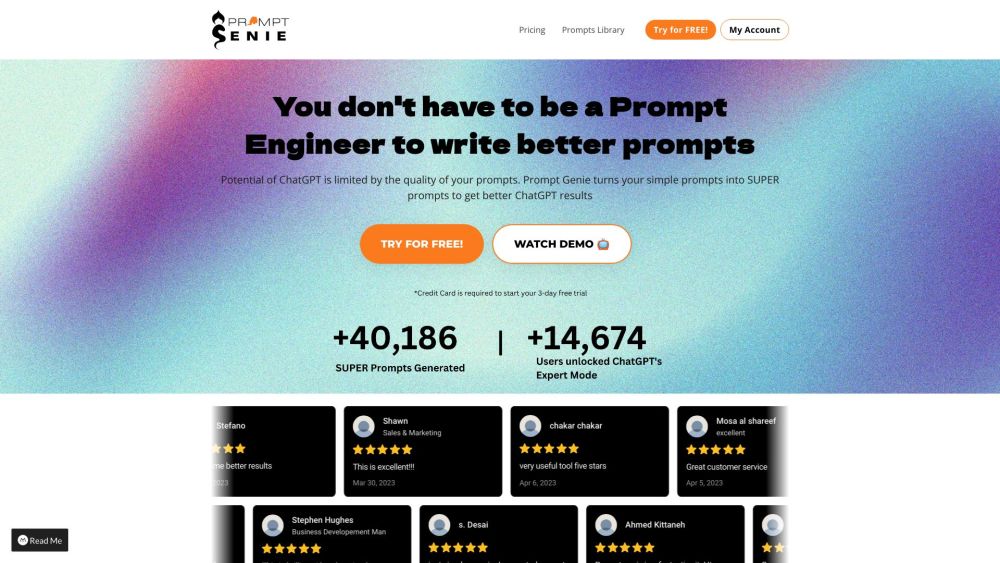

Élevez votre expérience ChatGPT avec Prompt Genie, un outil alimenté par l'IA conçu pour améliorer vos invites et offrir des résultats exceptionnels. Que vous cherchiez à affiner vos questions ou à générer des réponses plus créatives, Prompt Genie peut vous aider à libérer tout le potentiel de ChatGPT pour des performances optimales.

Découvrez notre outil gratuit de retouche photo en ligne, doté de fonctionnalités avancées en intelligence artificielle. Supprimez facilement les arrière-plans, améliorez vos images, agrandissez vos visuels, générez des images à partir de textes et utilisez notre gomme magique, le tout au même endroit. Améliorez votre expérience de retouche photo dès aujourd'hui !

Find AI tools in YBX