ホワイトハウス、AI企業からディープフェイクポルノ対策の自発的誓約を獲得

Most people like

マーケティングと営業のプロフェッショナルのために特別に設計された革新的なコンテンツコーパイロットで、AIの力を解き放ちましょう。高度なアルゴリズムとデータ主導の洞察を活用することで、このツールはコンテンツ制作プロセスを効率化し、オーディエンスのエンゲージメントを高め、コンバージョンを促進します。最先端のAIアシスタンスでマーケティング戦略と営業戦術を向上させ、魅力的なメッセージを作成し、ターゲットオーディエンスとこれまで以上に効果的に繋がることを可能にします。コンテンツ制作の未来を体験し、パフォーマンスが飛躍する様子を楽しんでください!

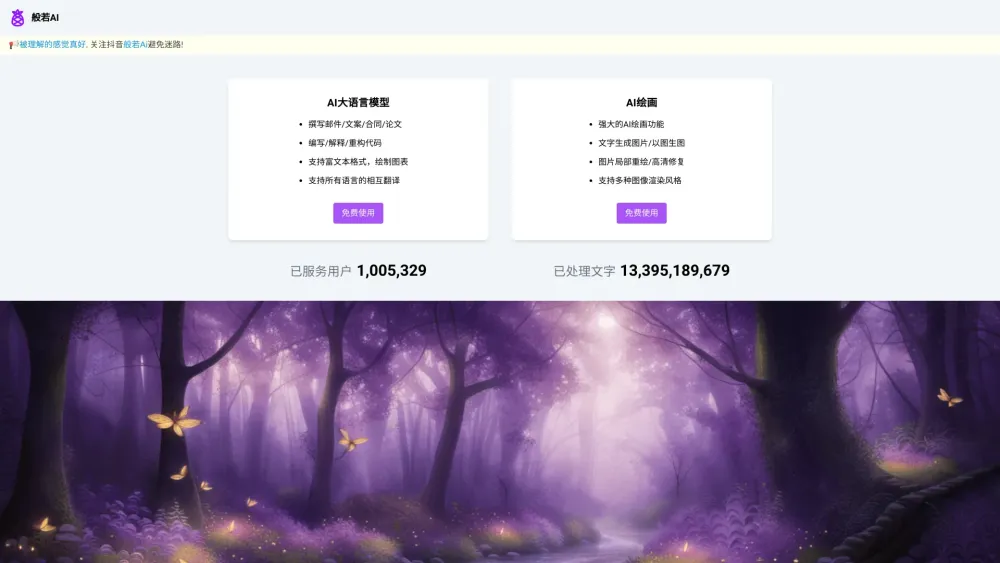

今日のデジタル時代において、AI生成型の大規模モデルは、特にアートの分野で私たちの創作方法を変えつつあります。AI絵画はこの技術の重要な応用であり、アート創作の革新を促進するだけでなく、アーティストの役割を再定義しています。本稿では、これらの先進モデルがどのようにアート創作をより多様化し、個性化させるのかを深く探り、同時にそれがもたらす倫理的及び社会的影響についても考察します。

Find AI tools in YBX

Related Articles

Refresh Articles