73%の組織が生成AIを導入しているが、リスク評価を行っているのはわずか—生成AI導入の現状と課題

Most people like

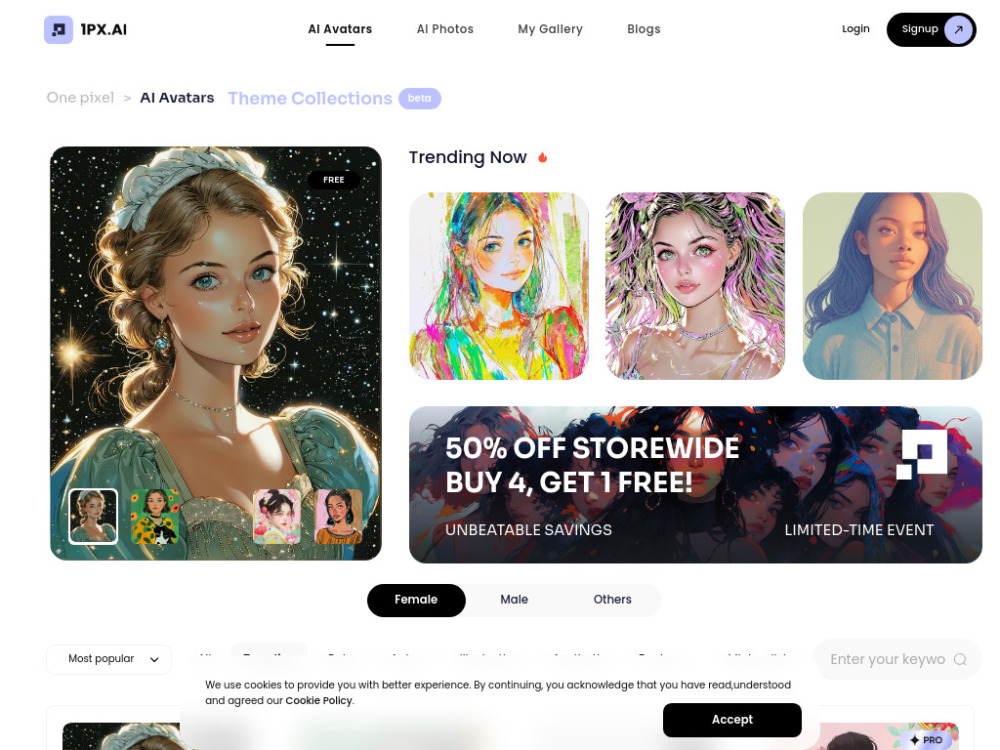

近年、AIポートレートジェネレーターは芸術的な画像の制作と体験の方法を革新しました。高度なアルゴリズムと機械学習技術を駆使することで、これらの革新的なツールは数秒で魅力的なデジタルポートレートを生成します。芸術家がインスピレーションを求める場合や、単にAIの能力に興味がある場合でも、これらのジェネレーターの仕組みを理解することで、創造性や表現の新しい道が開けます。本ガイドでは、AIポートレートジェネレーターの魅力的な世界に踏み込み、その技術、応用、およびデジタルアートの未来を探ります。

私たちのAI駆動のSEOコンテンツ最適化プラットフォームを使って、デジタルプレゼンスを強化しましょう。ウェブサイトの可視性とエンゲージメントを向上させるために設計されています。インテリジェントな洞察とカスタマイズされた推奨事項を活用して、コンテンツの可能性を最大限に引き出し、競争の激しいオンライン環境で先を行きましょう。最先端の技術を駆使した効果的なSEO戦略を利用して、トラフィックの急増を見届けてください!

Find AI tools in YBX

Related Articles

Refresh Articles