AIの「コードレッド」から1年、GoogleのGeminiに寄せられた反発:避けられなかったのか?

Most people like

今日の急速に進化するデジタル環境において、企業はますますAI顧客サービスソリューションに注力し、顧客サポートを強化しています。これらの革新的な技術は、業務の効率化を図るだけでなく、消費者の期待の変化に応えるパーソナライズされた体験を提供します。AI駆動のチャットボットやバーチャルアシスタントを統合することで、企業は問い合わせを迅速かつ効率的に解決し、最終的には顧客満足度とロイヤルティを向上させることができます。AIが顧客サービスにもたらす変革的な利点を探り、それがどのように企業を新たな高みに引き上げるかを一緒に考えてみましょう。

コンテンツ制作者のために特別に設計された、最先端のAI駆動オールインワンプラットフォームを体験してください。コンテンツの作成、編集、配信を簡素化する高度なツールで、あなたの創造力を解き放ちましょう。ワークフローを効率化し、これまでにない方法でオーディエンスとのエンゲージメントを高める、あなたのクリエイティブプロジェクトを向上させる強力な機能を備えています。今すぐ、コンテンツ制作の革命に参加しましょう!

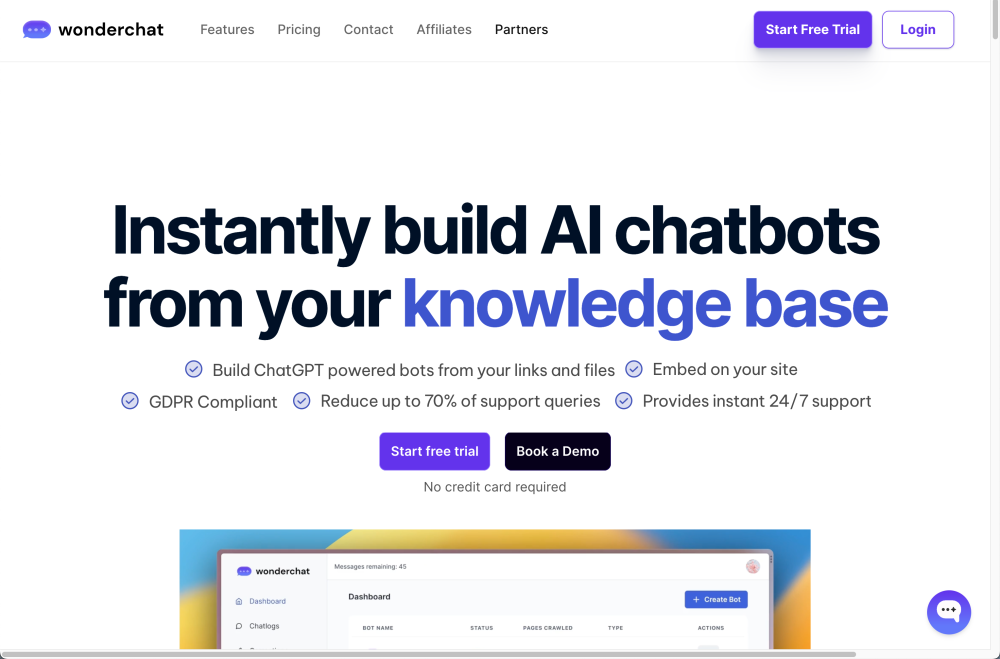

Wonderchatの力を解き放ち、カスタムチャットボットを作成して顧客応答のスピードを100%向上させましょう。あなたの負担を大幅に軽減し、顧客との対話を変革し、ビジネスの運営をスムーズに行いましょう!

Find AI tools in YBX

Related Articles

Refresh Articles