Googleが発表した110億パラメータのジーニーモデル:画像をプレイ可能なバーチャルワールドに変える革新

Most people like

今日の急速に進化するデジタル世界では、AIアシスタントが生産性を高め、日常生活を効率化する大きな力となります。スケジュール管理、情報検索、創造性向上の手助けが必要な場合でも、理想的なAIアシスタントはあなたの手のひらにあり、さまざまな方法でサポートしてくれます。この革新的な技術が、あなたの働き方、生き方、人とのつながりをどのように変えるかを探ってみましょう。究極のAIアシスタントのメリットと機能を見てみましょう!

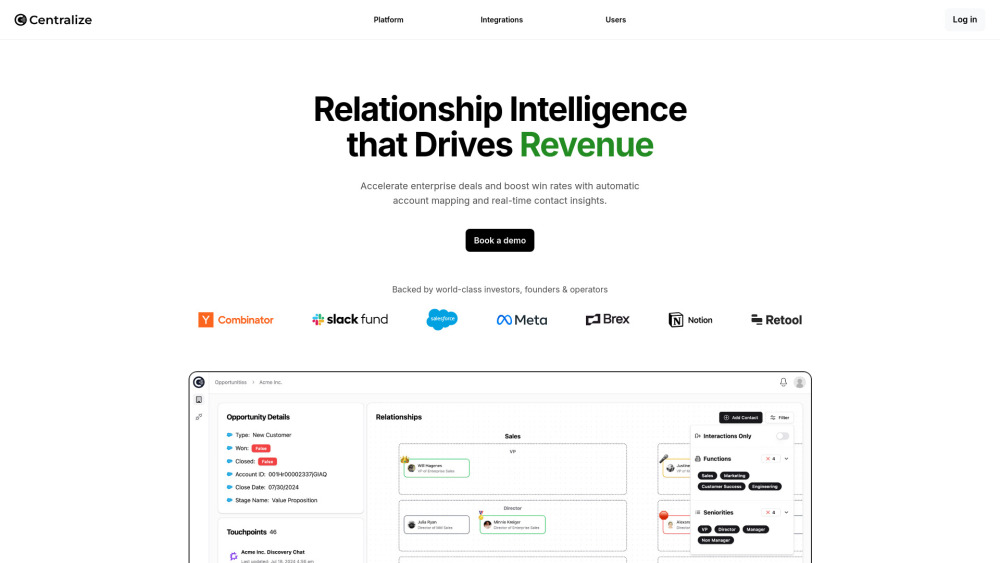

私たちのエンタープライズ営業AIプラットフォームの力を解放し、インサイトに富んだコンタクトデータを提供して、商談成立のプロセスを加速させましょう。先進的な分析と知的なインサイトを活用して、営業戦略を効率化し、より高いコンバージョン率を実現しましょう。今日、私たちのプラットフォームがあなたの営業活動をどのように変革できるかを発見してください!

Find AI tools in YBX

Related Articles

Refresh Articles