MetaのLLMコンパイラ:コーディングの常識を変える革新的AIテクノロジー

Most people like

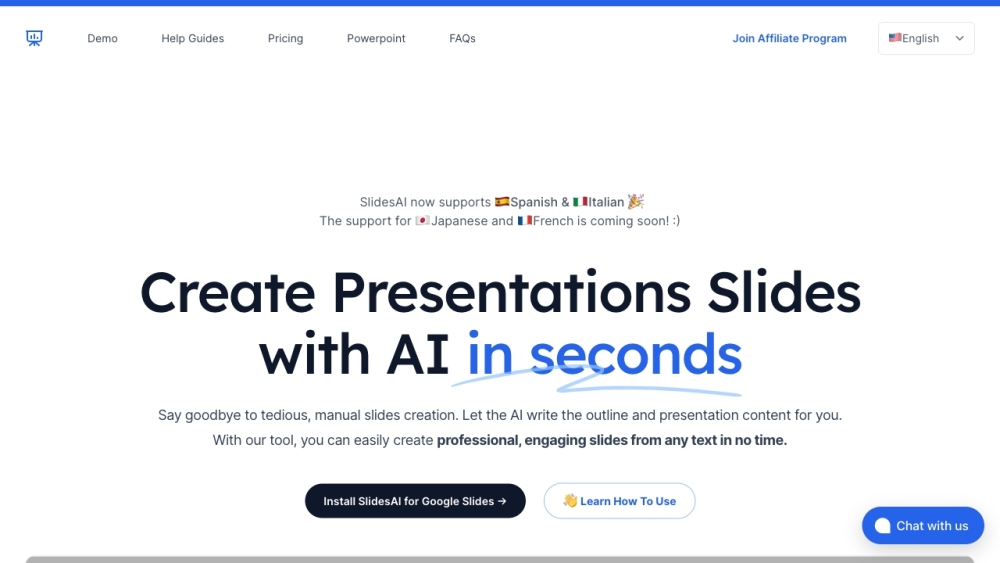

SlidesAIを紹介します:テキストを簡単に要約し、ダイナミックなプレゼンテーションスライドを生成する革新的なAI搭載ツールです。あらゆる文章を魅力的なビジュアルに変換し、プレゼンテーションをこれまで以上にインパクトのあるものにします。

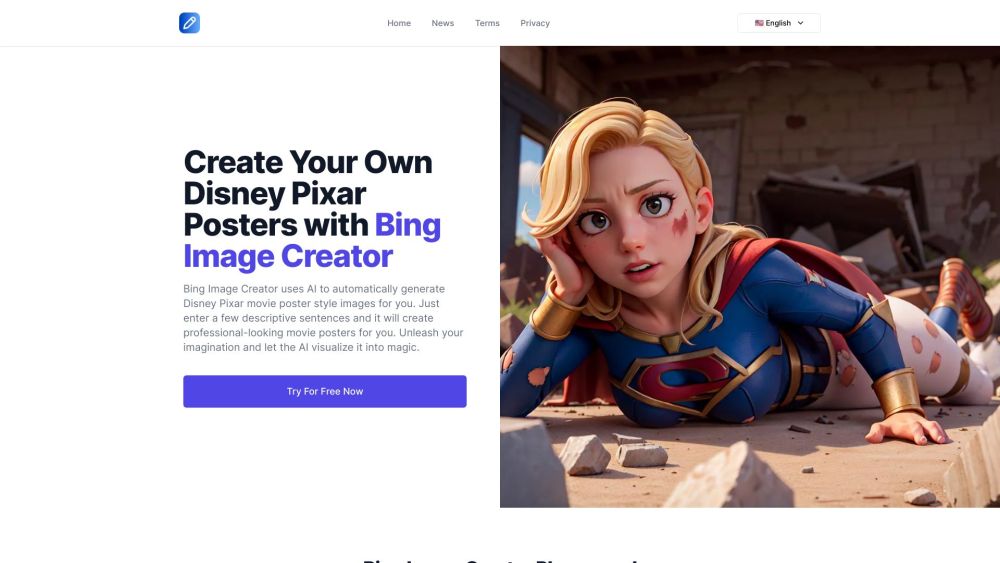

ディズニーとピクサーのためのAI駆動の映画ポスター生成を紹介:創造性と想像力を解き放つ!

AI主導のポスター作成の革新的な世界を発見し、ディズニーやピクサーの魅力的な世界が独特で視覚的に魅力的なデザインとして蘇ります。この画期的な技術は、人工知能を活用して、私たちが大切にしている愛すべきキャラクターや物語を称える素晴らしい映画ポスターを生成します。創造性の魔法に浸り、AIがどのようにクラシックや新しい映画の冒険を体験する方法を変えるのかを探ってみましょう!

Komo Search: あなたのプライベートで広告なしのAI搭載検索エンジン。プライバシーを強化した新しいウェブ探索の方法を発見し、途切れのないブラウジング体験をお楽しみください。あなた専用のAIによる結果をお届けします!

Find AI tools in YBX

Related Articles

Refresh Articles