구글, AI 역량 향상을 위한 첫 번째 오픈 멀티모달 비전-언어 모델 'PaliGemma' 출시

Most people like

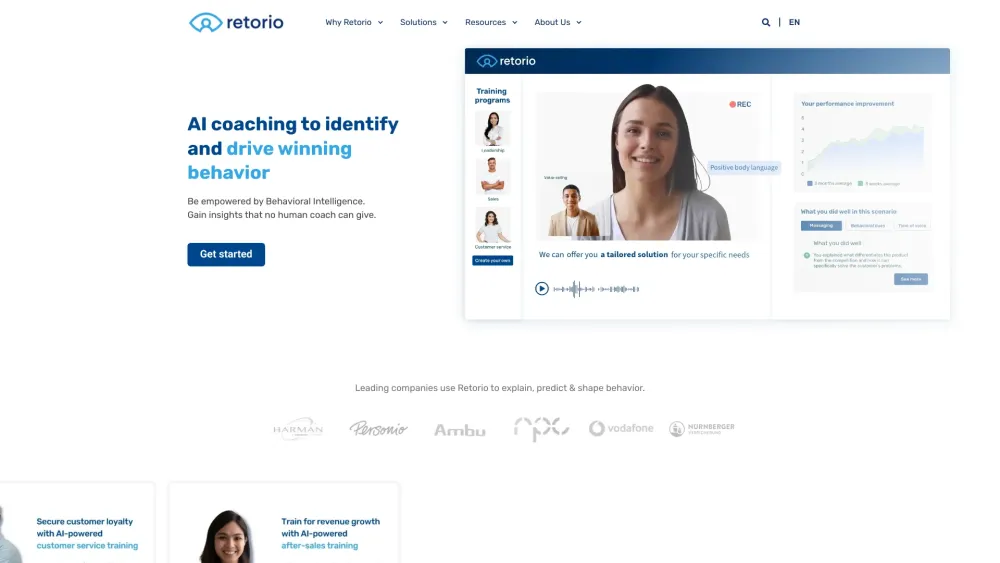

성과 중심 문화의 잠재력을 여는 것은 행동 지능에 기반한 효과적인 학습 및 개발(L&D) 전략에 달려 있습니다. 행동 과학의 통찰력을 통합함으로써 조직은 직원 참여를 강화하고, 훈련 프로그램을 효율화하며, 더 역동적인 작업 환경을 조성할 수 있습니다. 이러한 접근 방식은 지속적인 학습을 촉진할 뿐만 아니라 직원 성장과 비즈니스 목표를 일치시켜 조직의 성공을 이끕니다. 행동 지능에 뒷받침된 혁신적인 L&D 관행을 통해 thriving 성과 문화를 어떻게 배양할 수 있는지 알아보십시오.

Find AI tools in YBX

Related Articles

Refresh Articles