AI 전문가들, 감독 강화 없이는 '인류 멸종' 위험이 임박하다고 경고

Most people like

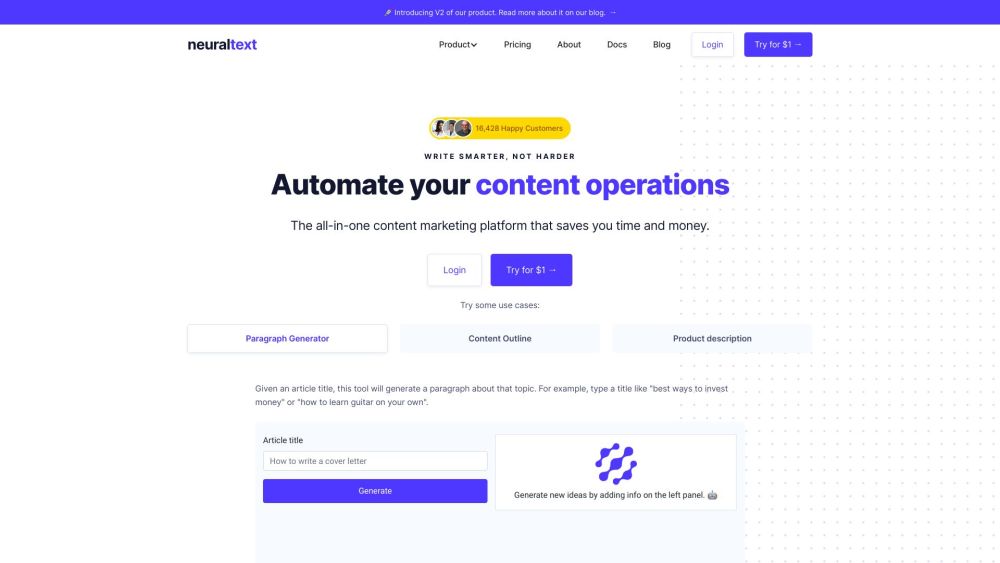

디지털 시대에 고품질 콘텐츠를 생성하는 것은 온라인 가시성과 참여에 필수적입니다. AI 글쓰기 도구와 SEO 도구는 우리가 텍스트를 생산하는 방식을 혁신하고 있으며, 청중과 공감할 수 있는 매력적인 서사를 쉽게 작성할 수 있도록 도와줍니다. 이러한 첨단 기술은 글쓰기 효율성을 높일 뿐만 아니라 검색 엔진에 최적화된 콘텐츠를 생성하여 당신의 작업이 목표 청중에게 도달하도록 보장합니다. AI와 SEO의 힘을 활용함으로써 작가들은 콘텐츠 전략을 향상시키고 검색 순위를 개선하며 궁극적으로 웹사이트로 더 많은 트래픽을 유도할 수 있습니다. 이러한 혁신적인 도구가 당신의 글쓰기 과정을 어떻게 변화시키고 온라인 존재감을 확대할 수 있는지 탐구해보세요.

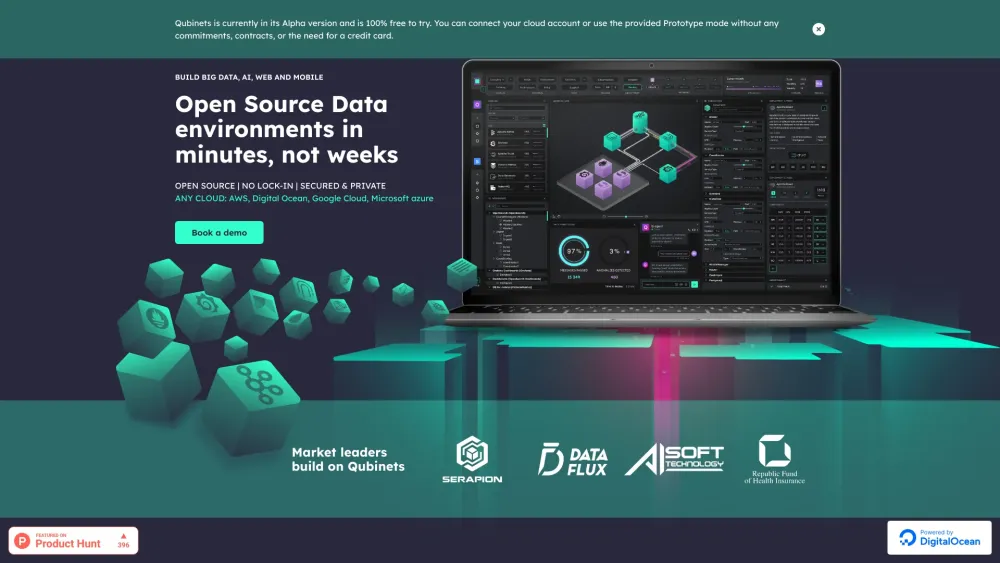

오늘날 빠르게 변화하는 디지털 환경에서 원활한 데이터 인프라 구축은 운영 최적화 및 성장 추진을 원하는 기업에 필수적입니다. 잘 설계된 데이터 시스템은 원활한 데이터 흐름을 가능하게 할 뿐만 아니라, 조직이 실시간 인사이트에 기반한 정보에 입각한 결정을 내릴 수 있게 합니다. 효율적인 데이터 인프라를 구현함으로써 기업은 협업을 강화하고 프로세스를 간소화하며 궁극적으로 전반적인 생산성을 향상시킬 수 있습니다. 비즈니스 목표를 지원하고 장기적인 성공을 보장하기 위해 데이터 인프라를 효과적으로 설정하는 방법을 알아보세요.

역할 놀이 애호가를 위해 특별히 설계된 혁신적인 온라인 AI 챗봇 플랫폼을 만나보세요. 이 도구는 매력적이고 몰입감 있는 경험을 제공하며, 사용자들이 스토리텔링과 창의성을 향상시키는 맞춤형 챗봇과 상호작용할 수 있게 합니다. 독특한 시나리오를 탐색하거나 캐릭터 대사를 개발하고 싶든, 우리 플랫폼은 무한한 역할 놀이 모험을 위한 완벽한 환경을 제공합니다. 지금 가입하여 상상력을 자극하는 아이디어를 매력적인 상호작용으로 변화시켜 보세요!

Find AI tools in YBX

Related Articles

Refresh Articles