Desbloqueie o Alto Desempenho em Aprendizado de Máquina: Alugue GPUs da AWS para suas Necessidades de Treinamento de Modelos

Most people like

Descubra uma plataforma gratuita para leituras de tarô e psíquicas, impulsionada por tecnologia de IA de ponta. Explore insights e orientações personalizadas, adaptadas à sua jornada única!

Apresentando uma Nova Página de Nova Aba com Tecnologia de IA para Preparação de Reuniões Eficiente

Aumente sua produtividade com nossa inovadora página de nova aba alimentada por IA, projetada especificamente para aprimorar sua experiência de preparação para reuniões. Com recursos inteligentes e uma interface amigável, essa ferramenta ajuda você a organizar informações, agendar discussões e acessar recursos essenciais sem esforço. Diga adeus a anotações desorganizadas e planejamento ineficaz—transforme seu fluxo de trabalho e faça cada reunião valer a pena!

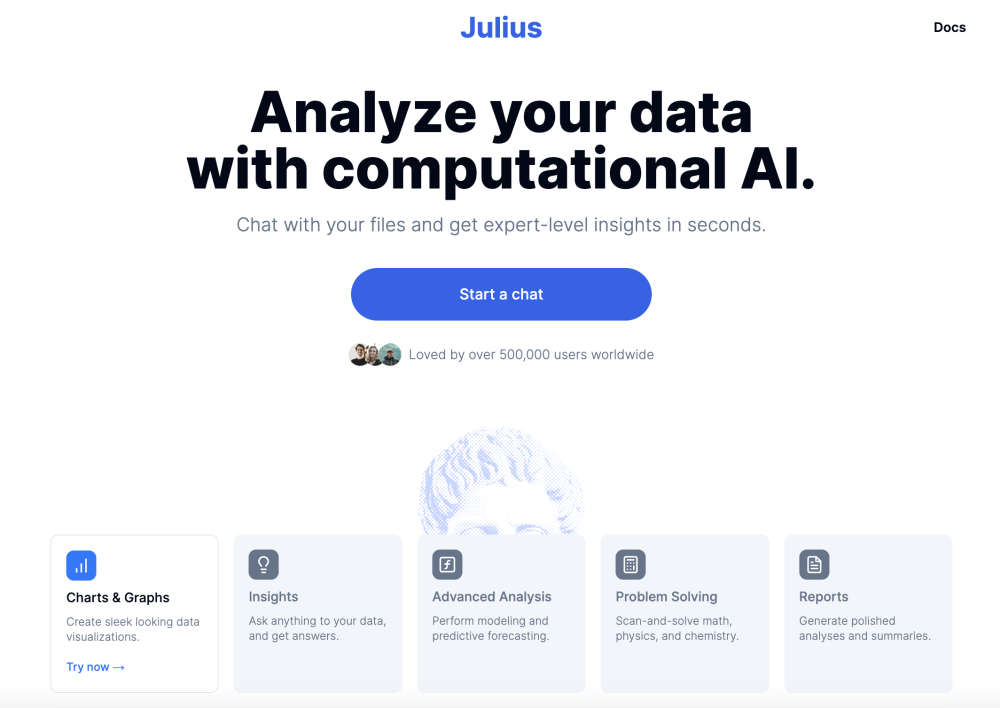

Desbloqueie o poder da análise de dados e visualização impulsionada por IA com nossa inovadora caixa de ferramentas para analistas de dados. Projetada para otimizar seu processo de exploração de dados, essa ferramenta transforma conjuntos de dados complexos em insights visuais envolventes, capacitando você a tomar decisões informadas. Descubra como nosso analista de dados com IA pode elevar suas análises, aprimorando sua capacidade de interpretar dados e impulsionar o sucesso dos negócios.

Find AI tools in YBX

Related Articles

Refresh Articles