Разблокируйте высокопроизводительное машинное обучение: арендуйте GPU AWS для обучения ваших моделей.

Most people like

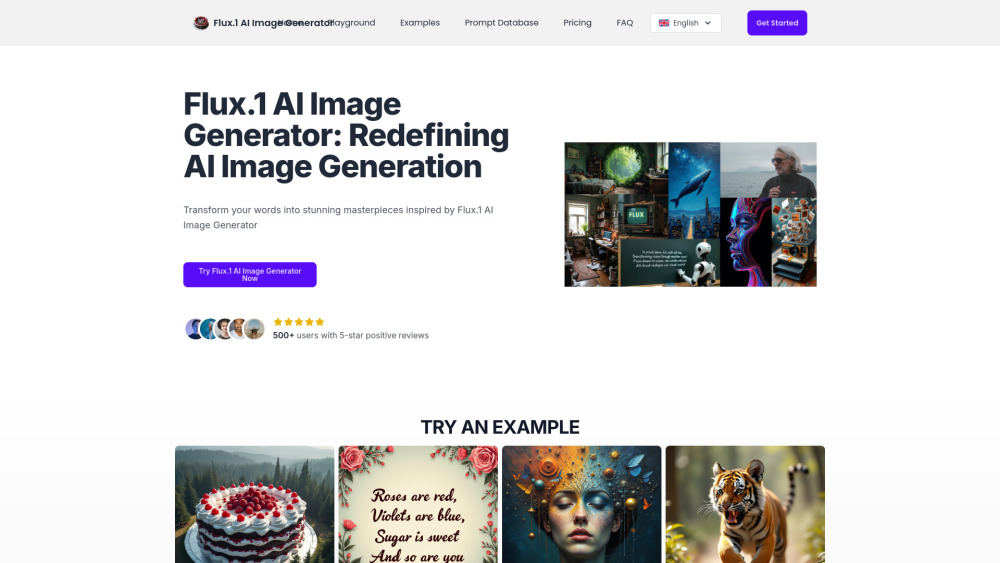

Откройте для себя мощь генераторов изображений на базе ИИ, которые превращают текстовые подсказки в потрясающие визуальные решения. С помощью передовых технологий эти инструменты позволяют пользователям превращать креативные описания в завораживающие изображения, легко объединяя творчество и инновации. Раскройте свой художественный потенциал и исследуйте безграничные возможности изображений, созданных ИИ!

Преобразуйте ваши URL с нашей ИИ видеоплатформой

В современном цифровом пространстве необходимость бесшовного создания контента и эффективного управления URL стала важнее, чем когда-либо. Наша инновационная ИИ видеоплатформа специализируется на преобразовании URL, упрощая пользователям обмен и доступ к любимым видео всего в один клик. Независимо от того, являетесь ли вы создателем контента, стремящимся улучшить свое онлайн-присутствие, или брендом, который хочет оптимизировать свою стратегию видеомаркетинга, наша платформа предоставляет передовые инструменты для упрощения этого процесса и повышения вовлеченности. Узнайте, как наши решения на основе ИИ могут поднять ваш видеоконтент на новый уровень и улучшить ваши усилия по преобразованию URL уже сегодня!

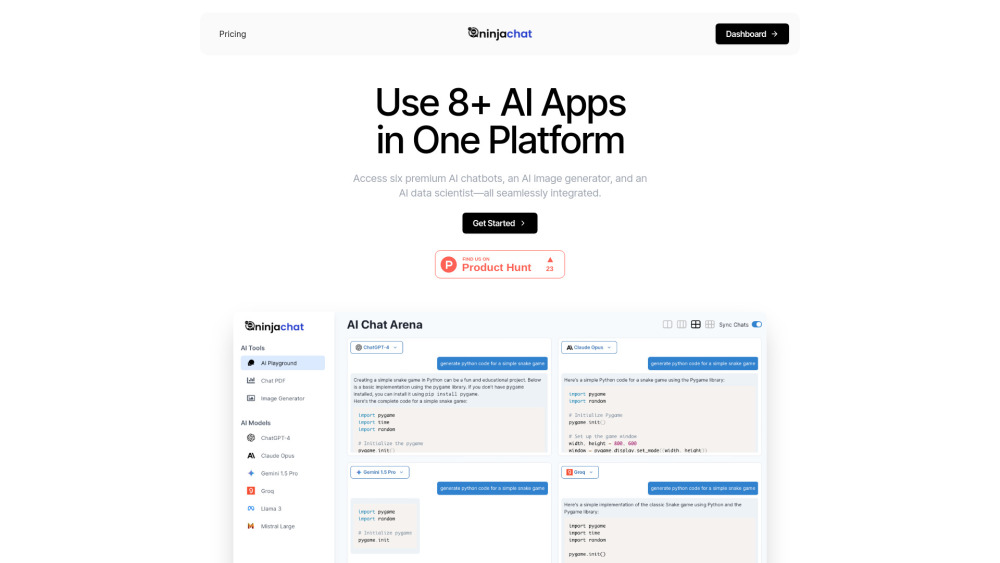

Представляем современную платформу ИИ-чата, оснащенную набором интегрированных инструментов для улучшения пользовательского опыта и вовлеченности. Преобразуйте взаимодействие с клиентами и упростите коммуникацию с нашими мощными ИИ-решениями.

Find AI tools in YBX

Related Articles

Refresh Articles