Google Раскрывает Тайны GPT-3.5 от OpenAI: Обвинения в Утечке Ключевой Информации!

Most people like

Представляем WhisperBot, вашего интеллектуального AI-ассистента для WhatsApp, который без труда преобразует голосовые сообщения в точные текстовые транскрипции. Оцените удобство чтения сообщений вместо их прослушивания, используя передовую AI-технологию.

Раскройте мощь ИИ: улучшите взаимодействие на LinkedIn и увеличьте видимость постов без усилий.

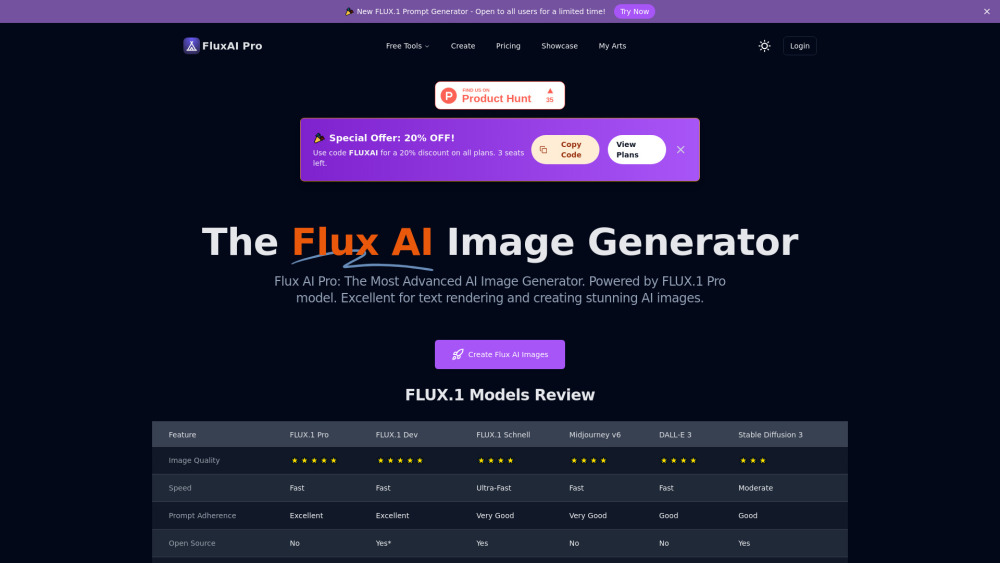

Генератор изображений ИИ: создавайте потрясающие изображения высокого качества из текстовых подсказок.

Исследуйте преобразующий эффект погружающих технологий XR (расширенная реальность) и VR (виртуальная реальность) в медицинском образовании. Эти инновационные инструменты меняют подход к обучению и практике медицинских работников, предлагая реалистичные симуляции, которые улучшают понимание и навыки. Узнайте, как XR и VR открывают путь к более увлекательному и эффективному образовательному опыту в медицине.

Find AI tools in YBX

Related Articles

Refresh Articles