Microsoft запускает серверную донастройку для своей малой языковой модели Phi-3: улучшение кастомизации и эффективности.

Most people like

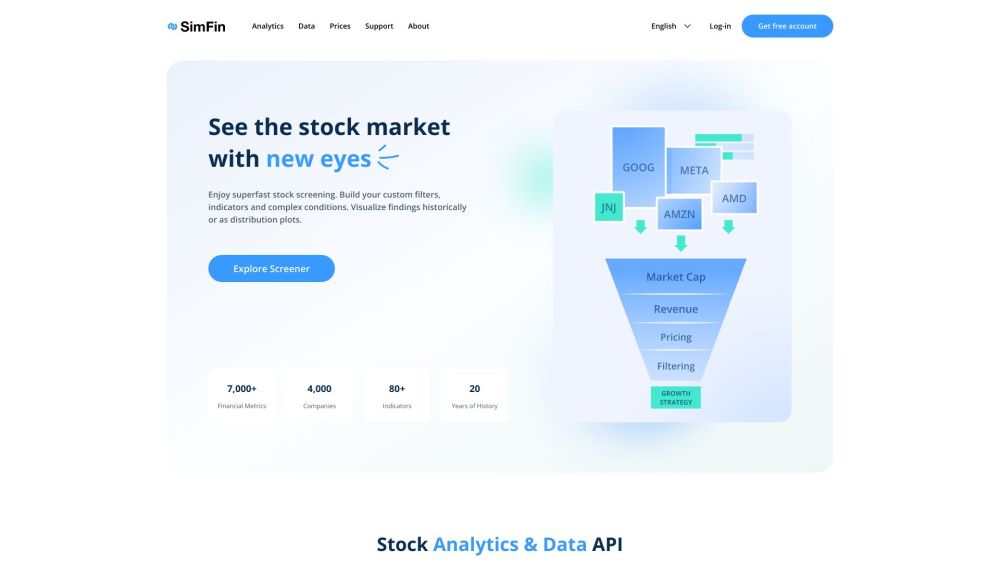

SimFin — это надежная платформа, предоставляющая глубокий анализ акций и ключевые финансовые данные, что делает ее незаменимым инструментом для инвесторов и аналитиков.

Откройте для себя возможности нашей платформы ИИ и XR, созданной для формирования погружающего образовательного опыта. Используйте передовые технологии для повышения качества образования, вовлечения учащихся и трансформации способов передачи знаний. Погрузитесь в новую эпоху интерактивного обучения, которая захватывает и вдохновляет.

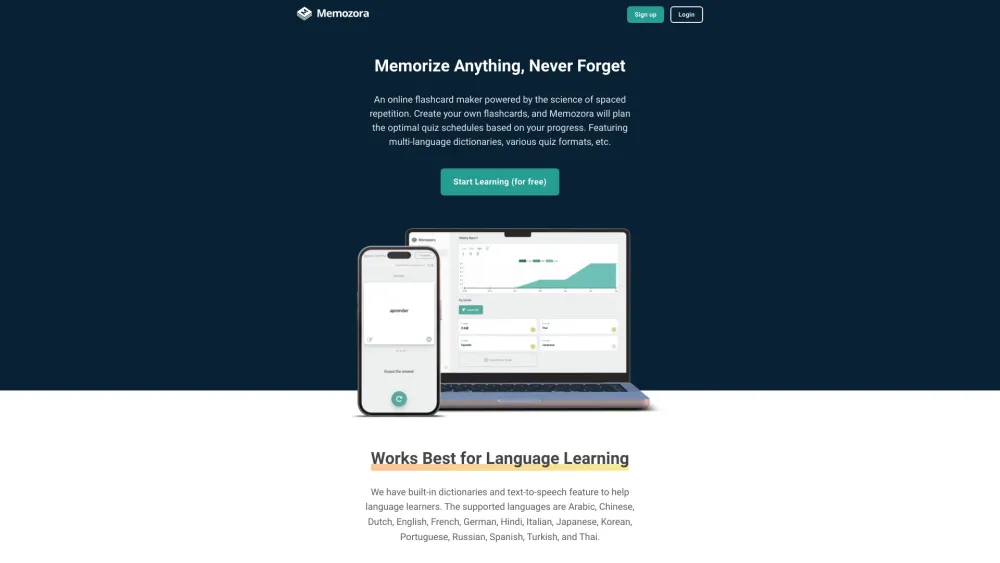

Разблокируйте свой языковой потенциал с нашим динамичным приложением для карточек, разработанным специально для изучающих языки. Оцените мощь эффективных учебных инструментов, предназначенных для улучшения запоминания словарного запаса и понимания.

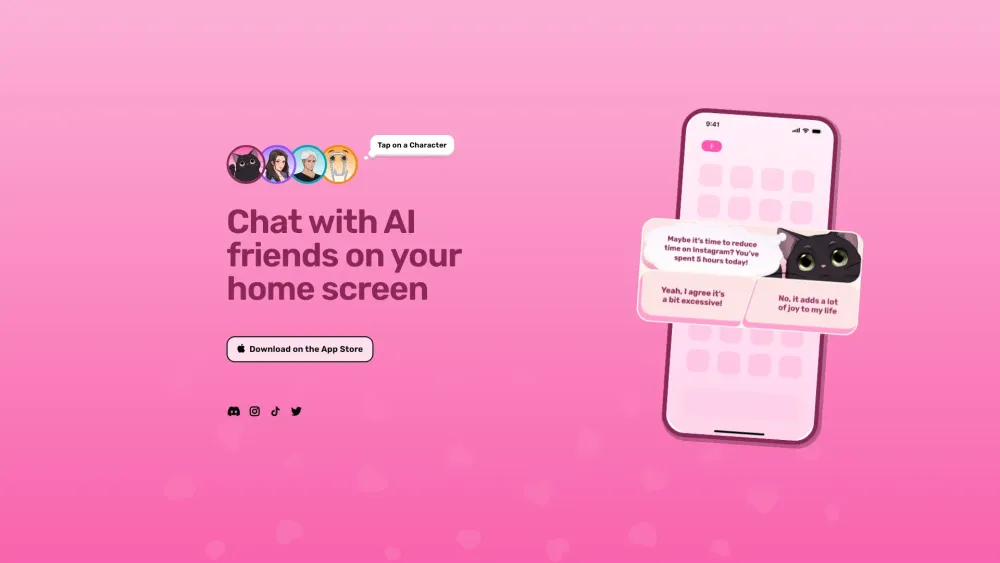

Преобразите главный экран вашего устройства с помощью увлекательных ИИ-друзей и персонажей, которые привносят индивидуальность и вовлеченность в ваши повседневные цифровые взаимодействия. Эти виртуальные компаньоны созданы для того, чтобы сделать ваше устройство более живым и интерактивным, предлагая развлечение и элемент креативности. Узнайте, как добавление этих уникальных элементов может повысить ваш главный экран, сделав его не только функциональным, но и отражением вашего личного стиля и интересов.

Find AI tools in YBX

Related Articles

Refresh Articles