Если вы ожидали, что увлечение ИИ утихнет в 2024 году, то приготовьтесь к неожиданностям. Достижения в области аппаратного и программного обеспечения открывают широкие возможности для применения генеративного ИИ (гени ИИ), что указывает на то, что 2023 год лишь коснулся поверхности возможного.

Этот год, известный в китайском зодиаке как Год Дракона, будет отмечен стратегической интеграцией генеративного ИИ во всех секторах. Оценив риски и разработав стратегии, компании готовы внедрять гени ИИ как ключевой элемент своей деятельности. Генеральные директора и бизнес-лидеры уже осознают как потенциал, так и необходимость генеративного ИИ, активно внедряя эти технологии в свои процессы.

Эволюция этого ландшафта делает гени ИИ не просто опцией, а основным двигателем инноваций, эффективности и конкурентоспособности. Этот фундаментальный сдвиг делает 2024 год годом, когда генеративный ИИ переходит от возникающей тенденции к неотъемлемой бизнес-практике.

Объем и разнообразие

Значительным аспектом этой трансформации является растущее признание того, как генеративный ИИ увеличивает и объем, и разнообразие приложений, идей и контента. Количество контента, созданного ИИ, потрясает: с 2022 года пользователи ИИ создали более 15 миллиардов изображений — достижение, которое раньше заняло бы у людей целых 150 лет. Это колоссальное производство изменит подход историков к анализу интернета после 2023 года, аналогично тому, как атомная бомба повлияла на радиоуглеродное датирование.

Для предприятий это расширение поднимает стандарты во всех областях, отмечая критический момент, когда игнорирование технологии может привести не только к упущенным возможностям, но и к конкурентным недостаткам.

Сложная граница

В 2023 году мы узнали, что генеративный ИИ улучшает как отраслевые стандарты, так и возможности сотрудников. Опрос YouGov показал, что 90% работников считают, что ИИ повышает продуктивность. Каждый четвертый опрошенный использует ИИ ежедневно, в то время как 73% взаимодействуют с ним хотя бы раз в неделю.

Более того, исследования показывают, что правильно обученные сотрудники выполняют 12% задач на 25% быстрее с помощью генеративного ИИ, улучшая общее качество работы на 40%, причем наибольшие достижения отмечаются среди работников с меньшей квалификацией. Тем не менее, когда задачи выходят за рамки возможностей ИИ, вероятность успешного решения для сотрудников снижается на 19%.

Сосуществование этих сильных и слабых сторон привело к появлению так называемой «сложной границы» возможностей ИИ. С одной стороны, ИИ выполняет задачи, которые раньше считались невозможными для машин, с удивительной точностью. С другой стороны, ИИ сталкивается с трудностями в областях, где необходима человеческая интуиция и адаптивность — в сферах, характеризующихся нюансами и сложными решениями.

Доступный ИИ

По мере того как предприятия учатся управлять этой сложной границей, можно ожидать, что проекты генеративного ИИ станут мейнстримом. К этому тренду способствует снижение стоимости обучения крупных языковых моделей (LLM), благодаря достижениям в области оптимизации кремния, которые уменьшают затраты вдвое каждые два года.

С учетом растущего мирового спроса на фоне глобального дефицита, рынок ИИ-чипов, вероятно, станет более доступным в 2024 году с появлением альтернатив лидерам отрасли, таким как Nvidia. Помимо этого, новые методы тонкой настройки, такие как Self-Play Fine-tuning (SPIN), могут укрепить слабые LLM, не требуя дополнительных аннотированных данных, используя синтетические данные для максимизации эффективности.

Вход в «Модельный Вселенную»

Снижение цен открывает путь для большего числа компаний, разрабатывающих и внедряющих собственные LLM, что возбудит волну инновационных приложений в ближайшие годы. К 2024 году мы также увидим переход от преимущественно облачных моделей к локально выполняемым ИИ, движимым такими аппаратными достижениями, как Apple Silicon, и неиспользованным потенциалом повседневных мобильных устройств.

Малые языковые модели (SLM) станут более популярными среди средних и крупных предприятий, удовлетворяя более специфические, нишевые потребности. В отличие от LLM, которые обрабатывают обширные наборы данных, SLM сосредотачиваются на специализированных данных, полученных изнутри, что обеспечивает актуальность и конфиденциальность.

Сдвиг к большим визуальным моделям (LVM)

По мере того как 2024 год unfolds, внимание переместится от LLM к большим визуальным моделям (LVM), особенно тем, которые адаптированы к конкретным областям и улучшают обработку визуальных данных. В то время как LLM, обученные на текстах из интернета, хорошо адаптируются к внутренним документам, LVM, обученные в основном на общих интернет-изображениях, испытывают трудности с специализированным визуальным контентом, используемым в таких областях, как производство и бионаука.

Исследования показывают, что адаптация LVM к конкретной области с использованием около 100,000 немаркированных изображений может значительно сократить потребность в маркированных данных, улучшая уровень производительности. Эти целевые модели превосходно справляются с задачами, такими как обнаружение дефектов и локализация объектов, превосходя общие LVM в специфичных для области приложениях.

Параллельно мы увидим, как компании начинают использовать большие графические модели (LGM), которые отлично подходят для обработки табличных данных, часто встречающихся в электронных таблицах. Их способность анализировать временные ряды предоставит свежие идеи о последовательных данных бизнеса, что обеспечит лучшее понимание операций предприятия.

Этические соображения

Эти достижения требуют строгого этического контроля. Прошлый опыт с универсальными технологиями, такими как смартфоны и социальные медиа, подчеркнул необходимость разработки нормативных рамок для предотвращения негативных социальных последствий. Хотя генеративный ИИ предлагает огромные преимущества, его развитие должно быть направляемо, чтобы избежать ошибок, способных привести к широким проблемам.

Одной из основных этических дилемм, связанных с генеративным ИИ, является авторское право. По мере развития этих технологий возникают актуальные вопросы о правах интеллектуальной собственности на контент, созданный ИИ, который опирается на существующие человеческие работы для своего обучения. Проблема заключается в том, должно ли этот контент подлежать законам об авторском праве.

Конфликт между ИИ и авторским правом является значительным, поскольку традиционные законы направлены на предотвращение незаконного использования чужой интеллектуальной собственности. Хотя заимствование вдохновения разрешено, воспроизведение — нет. В отличие от человека, ограниченного объемом данных, ИИ может анализировать огромные объемы информации, что усложняет разграничение между вдохновением и воспроизведением.

Мы можем стать свидетелями знаковых дел, таких как NYT против OpenAI, которые создадут прецеденты в дебатах об авторском праве и повлияют на то, как СМИ адаптируются к новой реальности, управляемой ИИ, в 2024 году.

Глубокие фейки и политические последствия

На геополитической арене 2024 год будет определен тем, как ИИ пересекается с ключевыми выборами по всему миру. Более половины мирового населения отправится на выборы, запланированные в крупных странах, таких как США, Индия и Южноафриканская Республика.

Дезинформационные кампании уже начали появляться, как это было продемонстрировано в Бангладеш, где проправительственные инфлюенсеры использовали недорогие ИИ-инструменты для распространения ложных нарративов. Один из глубоких фейков, который позже был удален, изображал оппозиционного политика, отказывающегося от поддержки палестинской солидарности — значимой темы в преимущественно мусульманской стране.

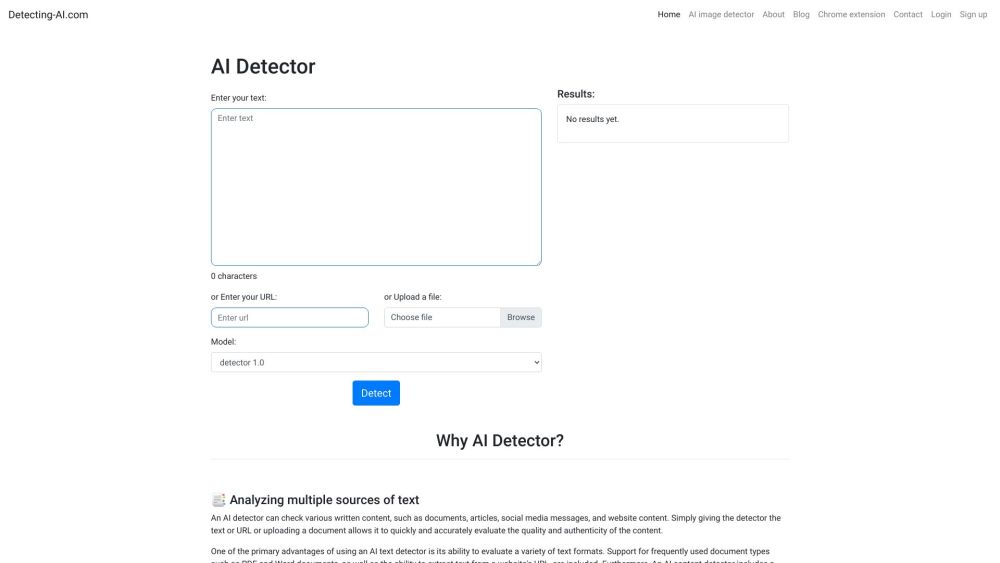

Угроза, которую представляют изображения, сгенерированные ИИ, не является гипотетической; исследования показывают, что небольшие изменения, созданные для введения в заблуждение ИИ, могут подобным образом повлиять на человеческое восприятие. Этот факт подчеркивает необходимость дальнейших исследований о влиянии противодействующих изображений как на людей, так и на системы ИИ.

С ростом требований к водяным знакам и учетным данным контента для различения аутентичного контента от синтетического, остаются вызовы. Эффективность детекции, потенциальное злоупотребление и поддержание различия между реальными и манипулированными медиа станут первостепенными задачами.

С учетом того, что общественное доверие находится на рекордно низком уровне, 2024 год, безусловно, станет временем смешения значительных электоральных событий и преобразующих технологий ИИ. Этот год, безусловно, продемонстрирует глубокое влияние и применение ИИ в политике и за ее пределами. Приготовьтесь к тому, что вас ожидает впереди.