Запущена модель генерации видео Sora: Обещающая технология с серьезными вызовами впереди

Most people like

Свяжитесь и взаимодействуйте с вашими идеальными персонажами, как никогда прежде, погружаясь в высокореалистичную и захватывающую атмосферу.

В современном быстро меняющемся цифровом мире использование ИИ-помощников в бизнесе становится важным для повышения продуктивности и эффективности. Автоматизация рутинных задач и улучшение коммуникации с помощью решений на основе ИИ могут значительно преобразить работу организаций. Внедрение технологий ИИ не только экономит время и ресурсы, но и предоставляет ценную информацию о бизнес-процессах, что способствует принятию обоснованных решений. Узнайте, как интеграция ИИ-помощников может повысить ваши бизнес-возможности и стимулировать устойчивый рост.

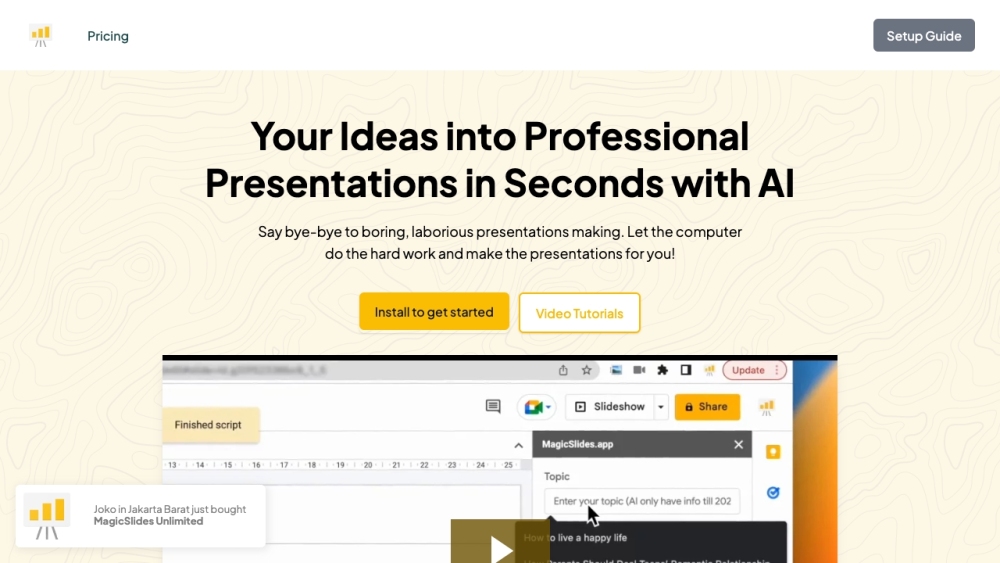

MagicSlides использует возможности искусственного интеллекта для создания потрясающих слайдов презентаций из любого текстового ввода. Превратите свои идеи в захватывающие визуальные презентации без усилий!

Find AI tools in YBX

Related Articles

Refresh Articles