غوغل يقدم اعتذاراً عن الصور غير الدقيقة والم misleading التي أنتجها نظام Gemini AI: لقد أخطأنا الهدف

Most people like

Pollinations.AI هي منصة إلكترونية مبتكرة تستغل خوارزميات الذكاء الاصطناعي المتقدمة لإنشاء أعمال فنية مذهلة وفريدة من نوعها. من خلال واجهتها السهلة الاستخدام، تتيح لأي شخص استكشاف عالم الفن المولد بواسطة الذكاء الاصطناعي الساحر.

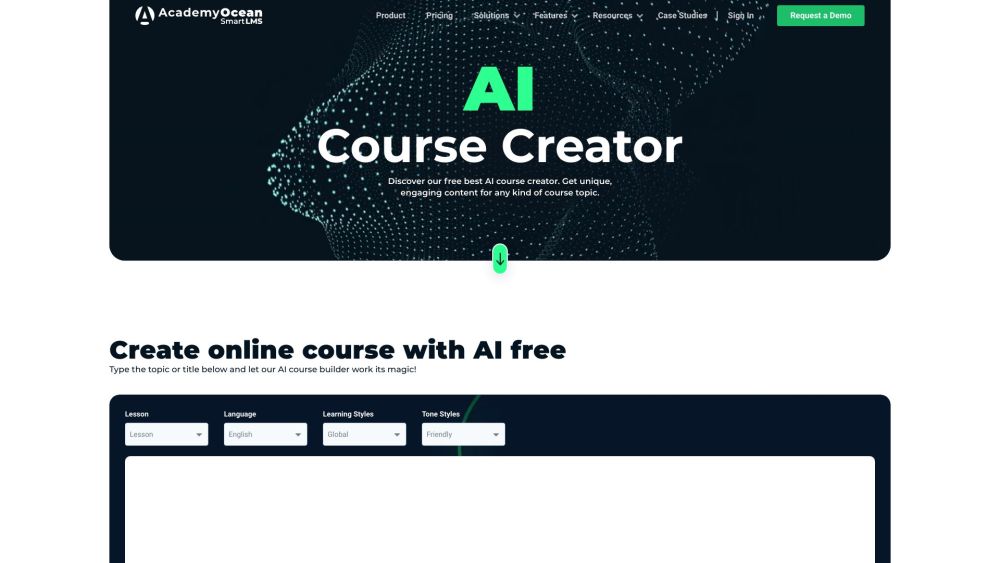

استكشف إمكانيات تقنية الذكاء الاصطناعي لإنشاء دورات جذابة

في عصرنا الرقمي اليوم، يؤدي دمج تقنية الذكاء الاصطناعي في تصميم الدورات إلى ثورة في طريقة التعليم. من خلال الاستفادة من قوة الذكاء الاصطناعي، يمكن للمعلمين إنشاء تجارب تعلم مخصصة وتفاعلية وفعّالة تلبي الاحتياجات الفريدة لكل طالب. لا يعزز هذا النهج المبتكر التفاعل فحسب، بل يسهل أيضًا تطوير الدورات. تعرف على كيفية استغلال أدوات الذكاء الاصطناعي لإنشاء دورات ديناميكية تأسر المتعلمين وتعزز استراتيجيتك التعليمية.

تقدم شركة رنواي أنظمة ذكاء اصطناعي مبتكرة مصممة خصيصًا للأدوات الإبداعية في مجالات الفن والترفيه. من خلال استغلال التكنولوجيا المتقدمة، تمكّن رنواي الفنانين والمبدعين من تحسين أعمالهم وفتح آفاق جديدة في سعيهم الإبداعي.

زيادة إنتاجيتك مع الذكاء الاصطناعي المساعد

اكتشف كيف يمكن للذكاء الاصطناعي المساعد تحسين سير عملك وزيادة الكفاءة. هذه الأداة القوية تسهل المهام، مما يساعدك على إنجاز المزيد في وقت أقل، كما تعزز التعاون والإبداع. احتضن مستقبل الإنتاجية واكتشف إمكانياتك الكاملة مع الذكاء الاصطناعي المساعد اليوم!

Find AI tools in YBX

Related Articles

Refresh Articles