Hinter Apples Einsatz von Google-Hardware zur Schulung des Apple Intelligence Modells

Most people like

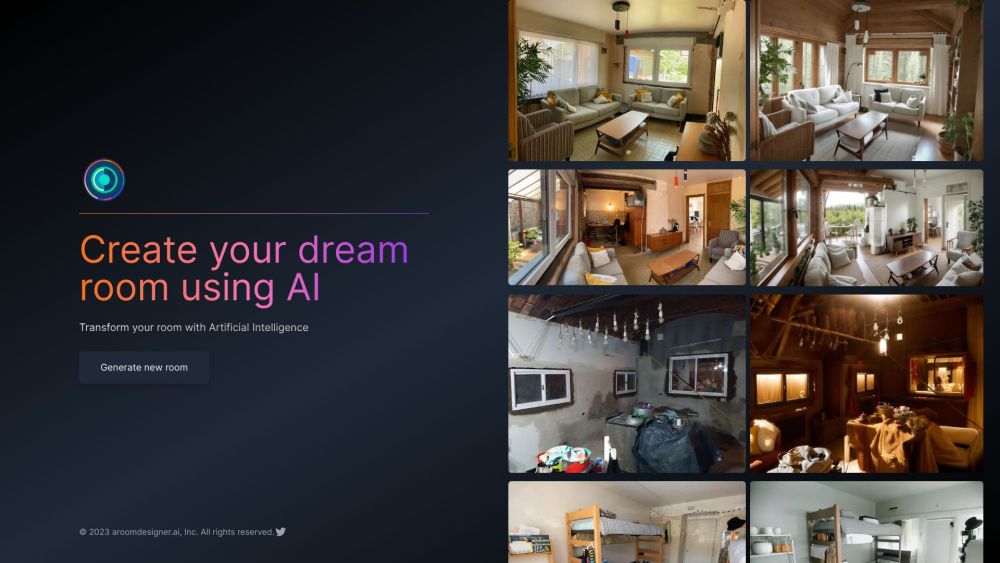

Präsentation von roomdesigner.ai, einer intuitiven, KI-gesteuerten Plattform, die den Raumgestaltungsprozess vereinfacht. Verwandeln Sie Ihren Raum mühelos mit modernster Technologie, die Ihnen ermöglicht, beeindruckende Innenräume ganz einfach zu kreieren.

Jobed ist eine innovative, KI-gesteuerte Plattform, die entwickelt wurde, um überzeugende und präzise Stellenbeschreibungen für Unternehmen zu erstellen. Mit intelligenten Algorithmen unterstützt Jobed Firmen dabei, effizient die richtigen Talente anzuziehen.

Entdecken Sie unseren KI-Rezeptgenerator, der einzigartige Gerichte basierend auf den Zutaten erstellt, die Sie zur Verfügung haben. Entfalten Sie kulinarische Kreativität und verwandeln Sie Ihre Vorratskammer in eine Gourmetküche mit personalisierten Rezepten, die Ihnen jederzeit zur Verfügung stehen!

Find AI tools in YBX

Related Articles

Refresh Articles