OpenAI präsentiert KI-Zitations- und Bildsicherheitsmaßnahmen vor den globalen Wahlen 2024.

Most people like

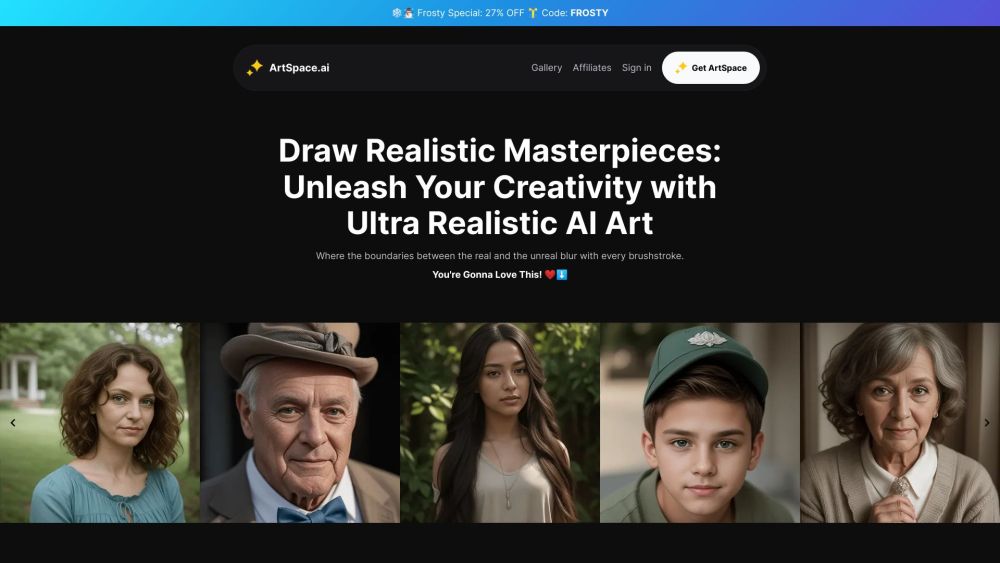

Auf dieser Seite können Sie mithilfe von KI ansprechende Bilder posten und generieren. Benutzer haben die Möglichkeit, ganz einfach originelle Werke zu erstellen und zu teilen.

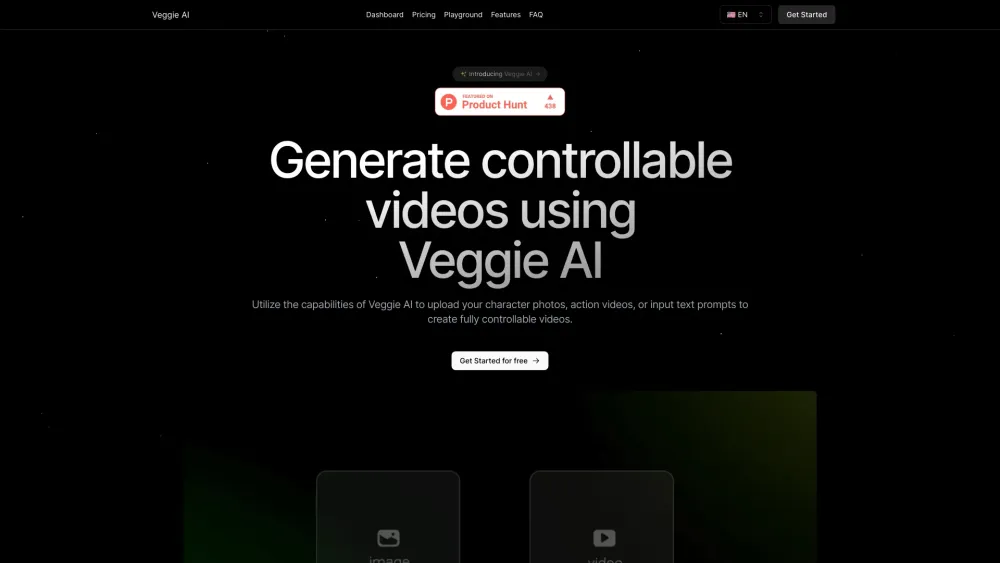

In einer Ära, in der visuelle Inhalte dominieren, kann die Nutzung eines KI-Videogenerators Ihren kreativen Prozess revolutionieren. Mit fortschrittlichen Algorithmen ermöglichen diese Tools den Nutzern, anpassbare Videos zu erstellen, die das Publikum fesseln und Botschaften effektiv vermitteln. Egal, ob Sie Marketingspezialist, Educator oder Content Creator sind, das Entdecken, wie Sie KI-Technologie für die Videoproduktion nutzen können, kann Ihren Ansatz revolutionieren und Ihnen mehr Kontrolle über jeden Aspekt Ihrer Projekte geben. Tauchen Sie in die Welt der KI-gesteuerten Videoproduktion ein und eröffnen Sie sich heute unendliche Möglichkeiten für Ihr Storytelling.

StyleAI ist eine innovative Plattform, die Benutzer dabei unterstützt, Websites zu erstellen und zu optimieren. Durch den Einsatz von KI-Assistenten verbessert StyleAI die Online-Sichtbarkeit und fördert das Unternehmenswachstum, wodurch es einfacher denn je wird, eine starke digitale Präsenz aufzubauen.

Find AI tools in YBX

Related Articles

Refresh Articles