Poe, der von Quora Ende 2022 eingeführte Multi-AI-Chatbot-Aggregator, hat sich durch eine einheitliche Benutzeroberfläche zur Nutzung verschiedener konkurrierender großer Sprachmodelle (LLMs) wie OpenAIs GPT-3.5/4, Anthropics Claude, Googles PaLM 2 und Metas Llama 2 einen Namen gemacht. Im April erweiterte Poe seine Plattform, sodass Dritte, einschließlich Einzelpersonen und Organisationen, eigene Chatbots mit den unterstützten LLMs entwickeln können.

Kürzlich führte Poe ein Monetarisierungsmodell ein, das diesen Entwicklern ermöglicht, innerhalb der Poe-App Einnahmen aus ihren Chatbots zu generieren. In einem Interview teilte Quora-CEO Adam D'Angelo Einblicke in diese Initiative sowie seine Vision für die Zukunft von Poe: „Wir senken die Eintrittsbarrieren, um ein umfangreiches Ökosystem von KI-Produkten zu fördern“, erläuterte D'Angelo. „Poe wird sowohl die Vielfalt als auch die Anwendungsbereiche für die Benutzer erweitern.“

D'Angelo hob zwei wesentliche Veränderungen hervor: Zum einen können Bot-Entwickler mit ihren Kreationen Geld verdienen, zum anderen erhalten Nutzer API-Zugang, um neue Sprachmodelle in die Plattform zu integrieren. Beide Änderungen sind bereits in Kraft, und Entwickler generieren heute Einnahmen, während neue Modelle integriert werden.

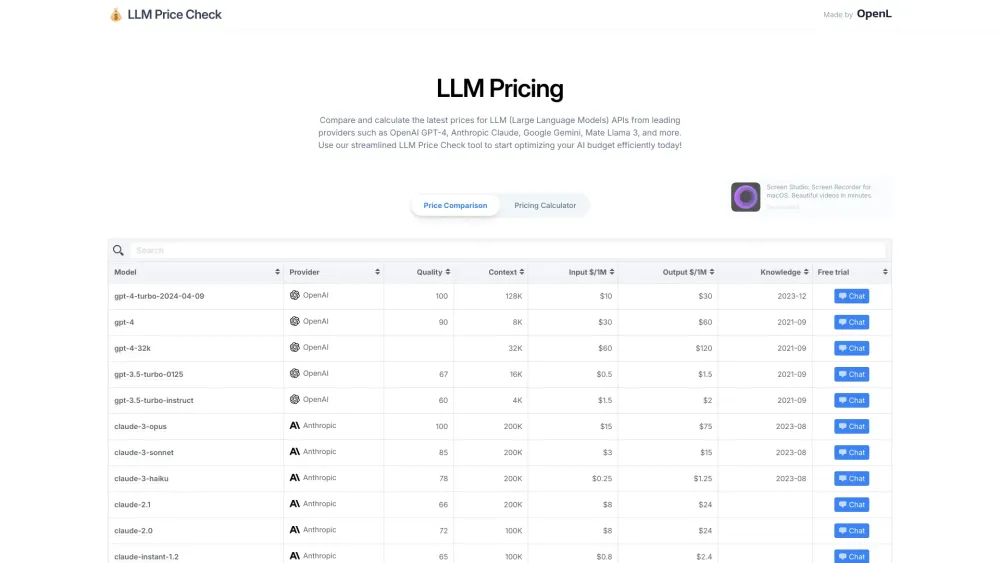

Die Unterstützung von Kosten für Entwickler ist entscheidend, da der Betrieb großer Sprachmodelle erhebliche Rechenressourcen erfordert. D'Angelo erläuterte, dass Poe Partnerschaften mit führenden API-Anbietern wie OpenAI, Anthropic und Google hat, die eine Finanzierung für die Nutzung von LLM-Technologie benötigen. Angesichts des Ziels, Tausende oder sogar Millionen von Konversations-KI-Optionen anzubieten, wäre die Aushandlung individueller Verträge unpraktisch. Daher implementierte Poe ein Umsatzbeteiligungsmodell, bei dem ein Teil der Zahlungen der Nutzer an Poe an die Entwickler verteilt wird, um die Kosten für die Entwicklung spezialisierter Bots zu decken.

Die Monetarisierungsstrategie von Poe besteht aus zwei Hauptkomponenten: Erstens erhalten Entwickler einen Anteil an den Einnahmen aus dem 20-Dollar-Monatsabonnement, wenn ihr Bot einen Nutzer zur Anmeldung in der App führt. Zweitens haben Entwickler bald die Möglichkeit, Gebühren pro Nachricht festzulegen, um für jede Benutzerinteraktion entschädigt zu werden. Dieses flexible Modell ermöglicht es Bot-Entwicklern, sofortige Einnahmen zu generieren und gleichzeitig einen wiederkehrenden Einkommensstrom basierend auf der Nutzung aufzubauen.

D'Angelo betonte, dass über den API-Zugang hinaus die Schaffung qualitativ hochwertiger Erlebnisse erhebliche Arbeit erfordert, wodurch Umsatzbeteiligungen entscheidend für den Aufbau nachhaltiger Geschäfte rund um diese Bots sind.

Poe will Innovationen ankurbeln, indem die nahtlose Integration verschiedener Sprachmodelle ermöglicht wird. „Unsere API ist völlig offen“, sagte D'Angelo und hob die Vorteile hervor, die eine Verbindung individueller Modelle durch Dritte anstelle der ausschließlichen Nutzung von Poe-modellen mit sich bringt.

D'Angelo möchte, dass Poe Vielfalt fördert, anstatt sie einzuschränken. Die Unterstützung externer Entwickler zur Verbindung maßgeschneiderter Modelle erhöht das gesamte Ökosystem, was durch Beispiele wie das Mistral-Modell illustriert wird, das von Fireworks.ai optimiert wurde.

Er verglich Poes Ansatz mit Webbrowsern wie Chrome und Safari, die die Hürden für die Website-Entwicklung drastisch gesenkt haben. Dieser Wandel ermöglichte es mehr Menschen, Websites zu erstellen und führte zu einem intensiven Wettbewerb basierend auf Inhalten und Dienstleistungen, nicht nur auf technischer Expertise. „Wenn man die Barrieren senkt, gedeiht der Wettbewerb, und Unternehmen entstehen basierend auf dem gebotenen Erlebnis“, erklärte er.

Diese Philosophie erstreckt sich auf die Konversations-KI, bei der einzigartige Erlebnisse erfolgreiche Bots auszeichnen werden, nicht nur die Modellfähigkeiten. „Wir ermöglichen ein florierendes Ökosystem von KI-Produkten, das die Vielfalt erhöht, anstatt nur den Wettbewerb zu fördern“, sagte er.

Während große Akteure weiterhin die Forschung an Sprachmodellen vorantreiben, setzt sich Poe dafür ein, kleinere, spezialisierte Entwickler zu stärken. „Wir möchten ihnen helfen, ihre Innovationen einem globalen Publikum zugänglich zu machen, insbesondere wenn sie mit den Kosten für die Bereitstellung von Modellen konfrontiert sind“, sagte D'Angelo.

Er äußerte Begeisterung über Fortschritte in der Text-, Bild-, Audio- und Videogenerierung und stellte fest, dass Techniken wie das Fine-Tuning von Modellen zusätzliche Möglichkeiten bieten. Indem Poe spezialisierte Entwickler unterstützt, wird die Vielfalt und die Auswahl für die Nutzer erhöht.

Poe zielt darauf ab, die rasche Innovation in der Landschaft der Konversations-KI voranzutreiben und Engpässe in der eigenen Infrastruktur zu vermeiden. Durch die Stärkung externer Entwickler und Anwendungen glaubt Poe, Fortschritte in spezialisierten Modellen und vertikalen Anwendungen beschleunigen zu können, was letztendlich die Zugänglichkeit und Nützlichkeit für Nutzer weltweit verbessert.

D'Angelo erkannte die dynamische Natur der Branche an: „Unsere Hoffnung mit der API und diesen Monetarisierungswerkzeugen ist, sicherzustellen, dass wir nicht zum Hindernis für den Fortschritt werden.“