Investigadores de Apple Presentan un Sistema de IA Revolucionario: Innovaciones que Superan el Rendimiento de GPT-4

Most people like

Descubre cómo la IA puede transformar tu flujo de trabajo automatizando tareas y mejorando la productividad. Libera el potencial de la inteligencia artificial para simplificar tus procesos laborales y aumentar la eficiencia.

Vidyo.ai transforma podcasts y videos en clips atractivos y compartibles, diseñados para plataformas de redes sociales. Maximiza el alcance e impacto de tu contenido creando fácilmente resúmenes cautivadores que atraigan a tu audiencia.

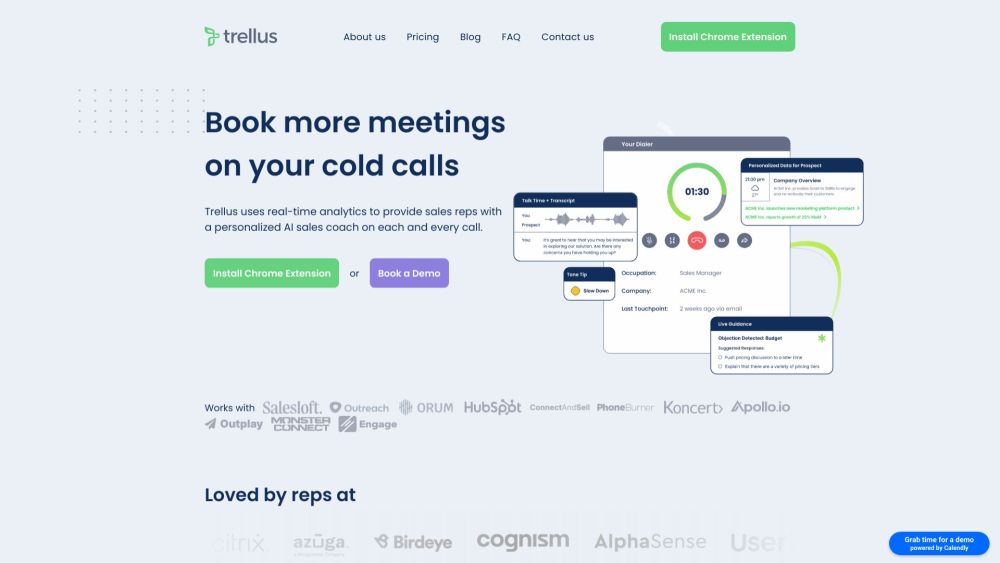

Presentamos Trellus, una herramienta innovadora impulsada por inteligencia artificial, diseñada para ofrecer coaching personalizado y análisis en tiempo real específicamente para representantes de ventas durante sus llamadas en frío. Con Trellus, mejora tu estrategia de llamadas en frío y potencia tu éxito en ventas a través de insights y orientación personalizados.

Find AI tools in YBX

Related Articles

Refresh Articles