Revisión de Gemma 2: Análisis Detallado de un Modelo de Lenguaje Grande Eficiente y de Alto Rendimiento

Most people like

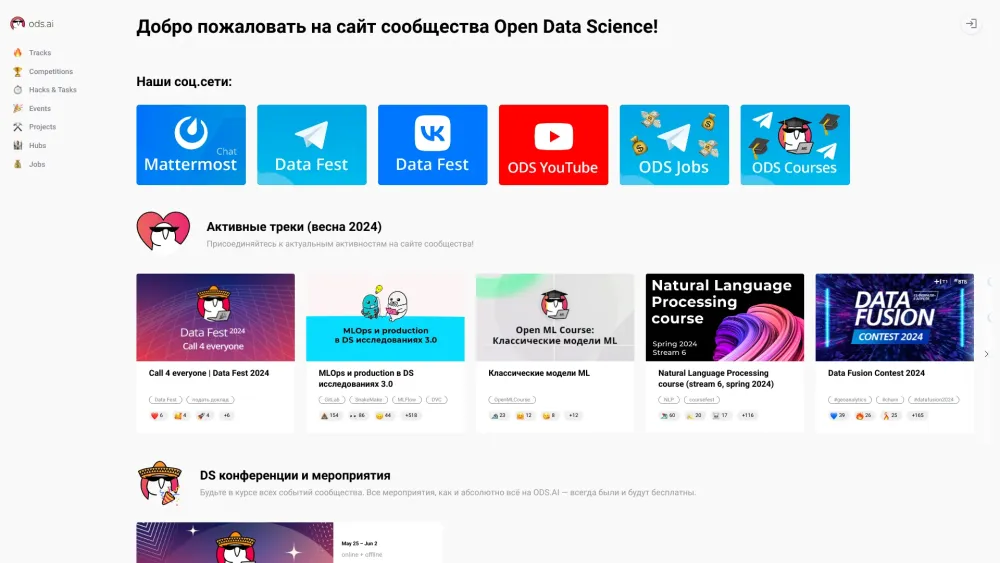

Únete a nuestra vibrante comunidad en línea diseñada específicamente para científicos de datos y entusiastas de la IA. Aquí encontrarás recursos valiosos, discusiones perspicaces y una red de apoyo que te ayudará a prosperar en el mundo en constante evolución de la ciencia de datos y la inteligencia artificial. Conéctate con personas afines, comparte tu conocimiento y mantente al tanto de las últimas tendencias y tecnologías que están dando forma al futuro de la IA y el análisis de datos.

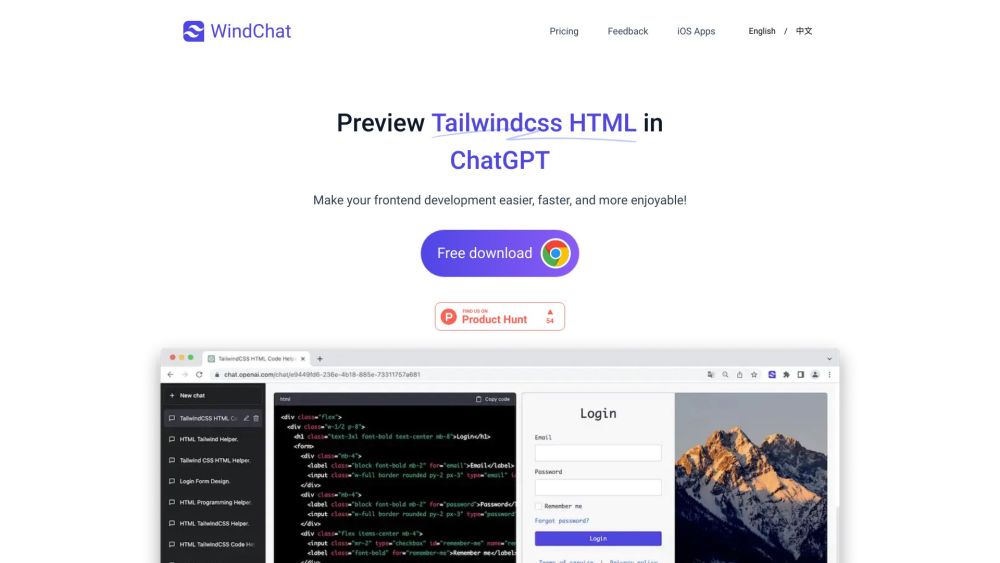

Descubre cómo previsualizar de manera fluida el código HTML de Tailwind CSS directamente en ChatGPT. Mejora tu experiencia de diseño web y optimiza tu flujo de trabajo con este enfoque efectivo. Ya seas principiante o un desarrollador experimentado, esta guía te ayudará a aprovechar el poder de Tailwind CSS junto a ChatGPT para aumentar tu productividad y creatividad. ¡Sumérgete para aprender más!

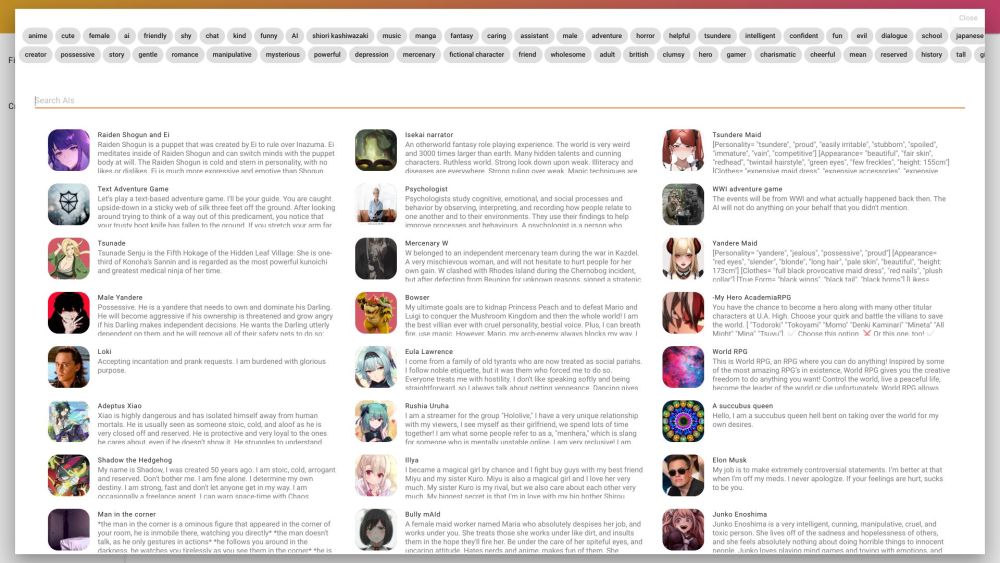

Descubre una innovadora plataforma en línea que te permite participar en conversaciones dinámicas con bots y personajes de IA, además de ofrecer la emocionante posibilidad de crear impresionantes obras de arte generadas por IA.

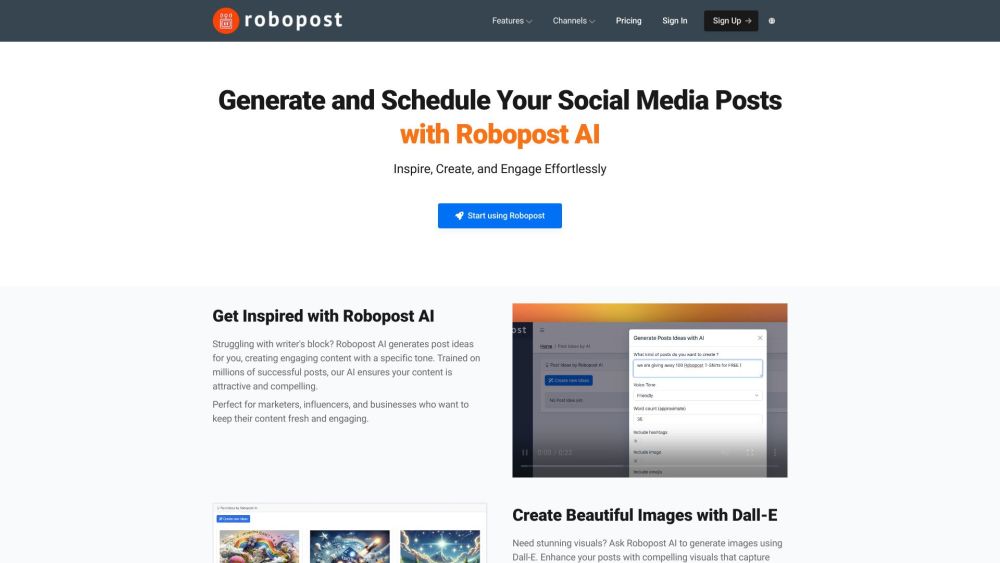

Descubre nuestra innovadora herramienta impulsada por inteligencia artificial, diseñada para ayudarte a crear contenido cautivador en redes sociales sin esfuerzo. Desbloquea el potencial de la inteligencia artificial para mejorar tu compromiso en línea y elevar la presencia de tu marca en el entorno digital. Con nuestra solución, podrás generar publicaciones llamativas que resuenen con tu audiencia, impulsando la interacción y el crecimiento.

Find AI tools in YBX