Bumble incite ses utilisateurs à signaler les images générées par IA pour garantir la sécurité et l'authenticité.

Most people like

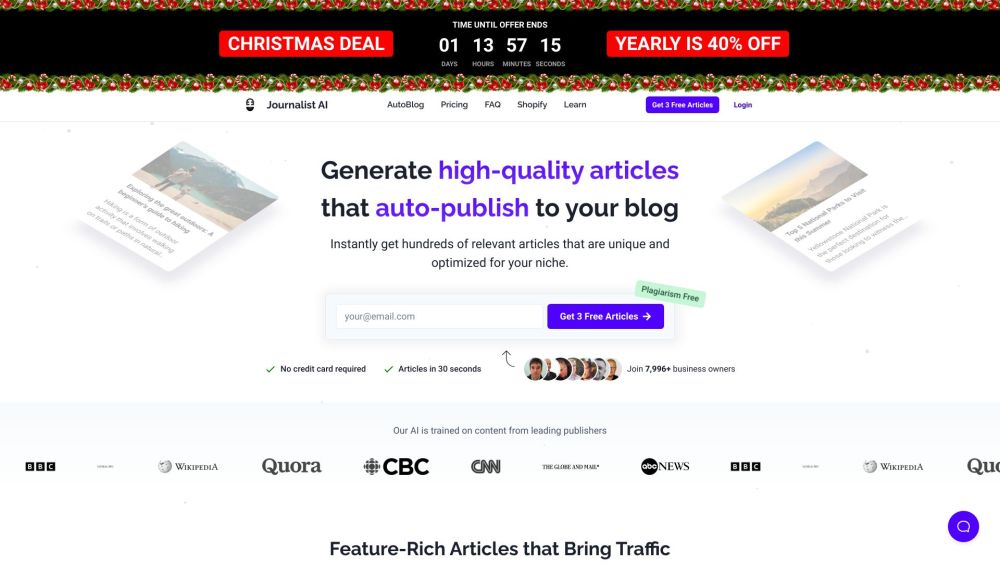

Découvrez la puissance d'un partenaire IA pour enrichir votre rédaction et vos conversations captivantes. Que vous créiez un texte marketing percutant ou que vous soyez à la recherche d'un assistant de chat intelligent, nos solutions IA sont conçues pour améliorer votre communication et simplifier votre processus créatif. Libérez de nouvelles possibilités grâce à une technologie avancée à portée de main !

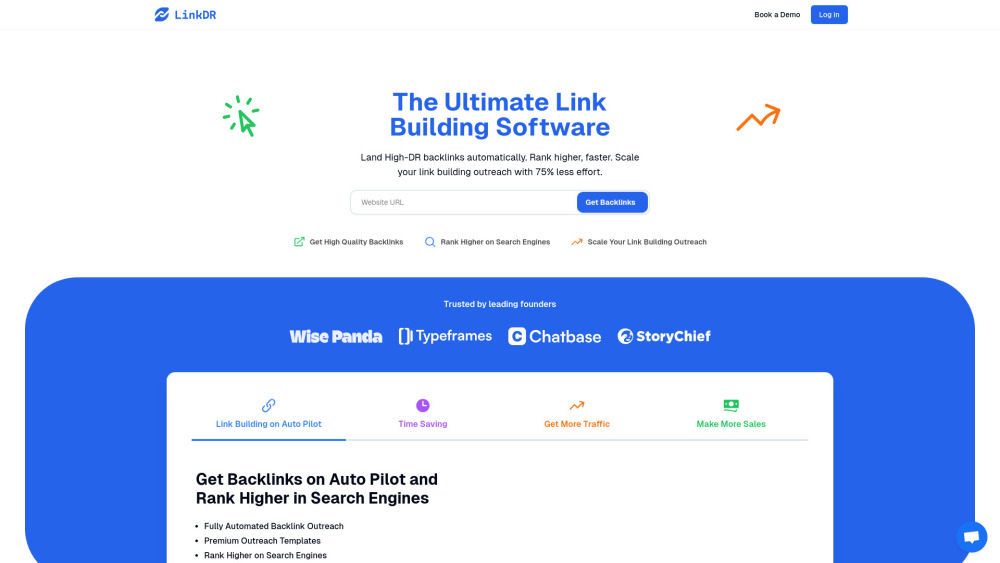

Améliorez la visibilité de votre site web grâce à un logiciel automatisé conçu spécifiquement pour optimiser le SEO par des stratégies de création de liens efficaces.

Find AI tools in YBX

Related Articles

Refresh Articles