Stability AI lance le modèle 'Smol' : présentation de StableLM Zephyr 3B.

Most people like

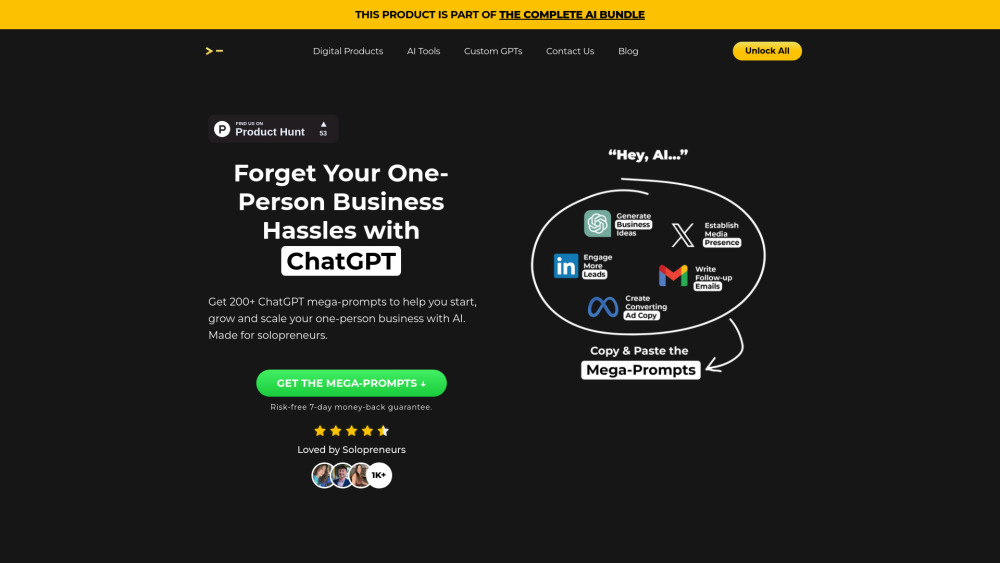

Découvrez notre collection soigneusement sélectionnée de méga-invites élaborées pour optimiser chaque tâche de votre entreprise individuelle. Automatisez votre flux de travail et améliorez votre productivité grâce à ces outils essentiels.

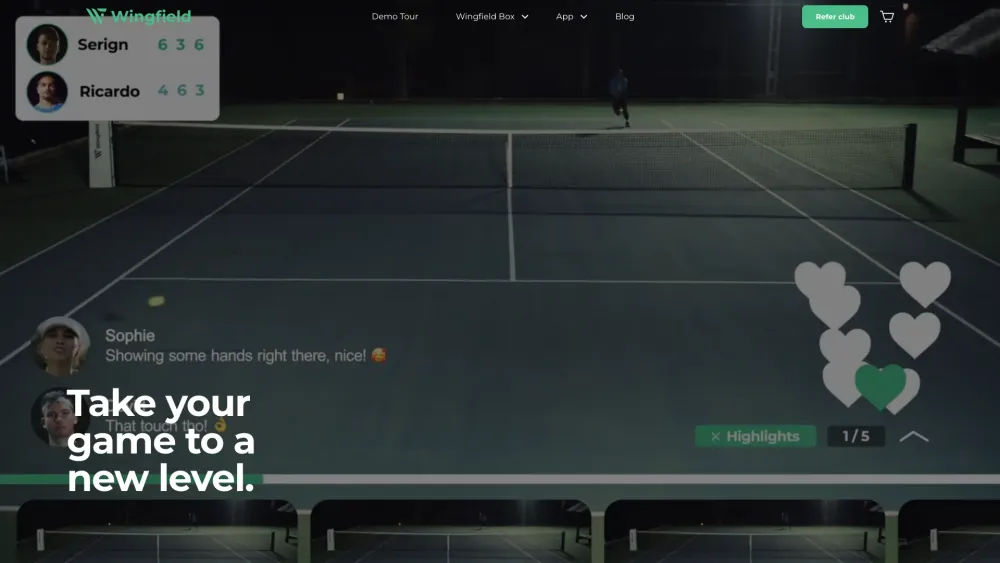

Êtes-vous prêt à faire passer votre jeu de tennis au niveau supérieur depuis le confort de votre maison ? Notre expérience virtuelle de tennis innovante allie technologie de pointe et gameplay réaliste, vous permettant de vous plonger dans le sport que vous aimez. Que vous soyez un débutant souhaitant apprendre les bases ou un joueur avancé perfectionnant ses compétences, cette plateforme interactive propose des séances d'entraînement personnalisées, des matchs compétitifs et des défis captivants conçus pour tous les niveaux. Rejoignez une communauté dynamique de passionnés de tennis et transformez votre jeu dès aujourd'hui !

Hypotenuse AI est un assistant d'écriture avancé qui crée sans effort des contenus de haute qualité adaptés à vos mots-clés spécifiques. Que vous souhaitiez améliorer votre blog, votre site web ou vos supports marketing, Hypotenuse AI simplifie le processus d'écriture tout en garantissant que votre contenu soit captivant et pertinent.

Découvrez une plateforme de productivité alimentée par l'IA, spécialement conçue pour les équipes, révolutionnant la manière dont vous collaborez et gérez vos projets. Cette solution innovante améliore l'efficacité, optimise les processus et favorise une communication fluide, permettant à votre équipe d'accomplir davantage ensemble. Découvrez comment notre plateforme transforme la productivité grâce à l'automatisation intelligente et à des analyses approfondies.

Find AI tools in YBX

Related Articles

Refresh Articles