Apple、デバイス上での実行に向けたオープンソースAIモデルを発表

Most people like

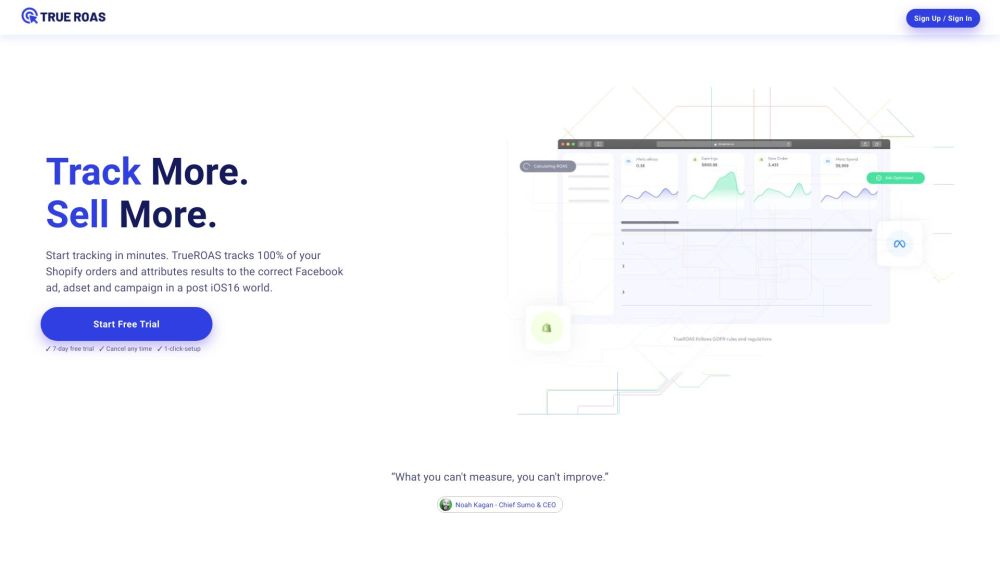

Shopifyの注文に対する効果的な広告追跡と成果測定は、マーケティングのROIを最大化するために不可欠です。正確な追跡方法を用いることで、顧客の行動について貴重な洞察を得られ、広告戦略を適切に最適化できます。このガイドでは、Shopifyプラットフォームにおける広告パフォーマンスを正確に追跡するためのベストプラクティスを探り、販売を促進し、全体的なビジネス成長を向上させるための情報に基づいた意思決定をサポートします。

今日の急速に変化する世界では、AIアシスタントが日常のタスクへのアプローチを革新できます。スケジュール管理からパーソナライズされた提案の提供まで、これらの知的なツールは生産性を向上させ、ワークフローを効率化するために設計されています。AIの力を活用し、さまざまな責任をこなす中で、どのように生活を簡素化できるかを発見してください。あなたのニーズに合わせたAIアシスタントがもたらす無限の可能性を探求しましょう。

Find AI tools in YBX

Related Articles

Refresh Articles