コヒア、Aya 23を発表:20以上の言語に対応したオープンウェイトAIモデル

Most people like

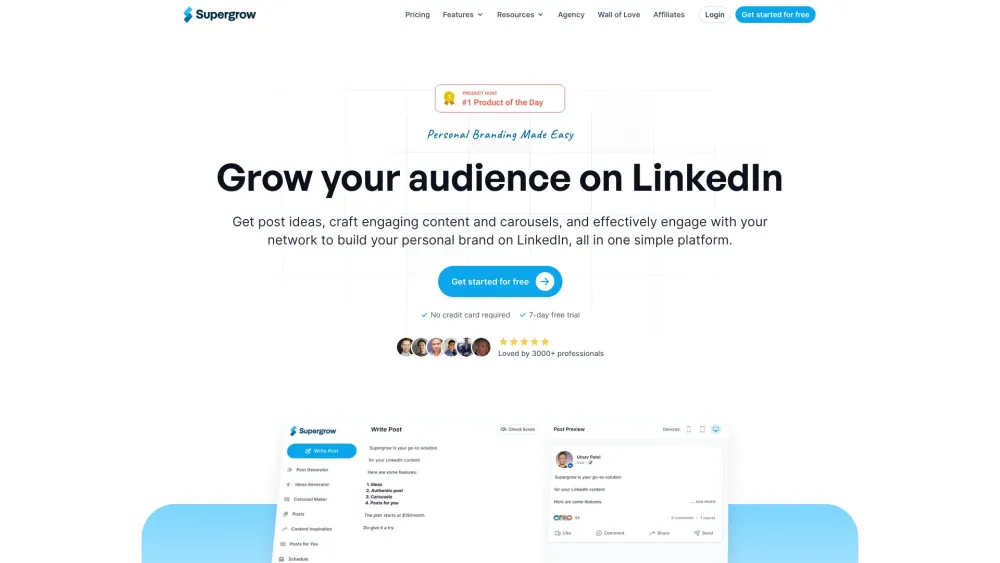

LinkedInでのパーソナルブランドを高める:成長と成功のための戦略

LinkedInの力を利用して、効果的にパーソナルブランドを構築・拡大しましょう。今日の競争が激しいプロフェッショナル環境では、強力なオンラインプレゼンスを確立することが、機会をつかみ、業界のリーダーとつながるために不可欠です。新たなキャリアの可能性を探している方や、信頼性を高めたい方に向けて、このガイドでは、LinkedIn上で際立ち、成功するための実践的な戦略を提供します。

現代の急速に進化する世界では、新しい情報を習得するために効果的な学習法が不可欠です。人気を集めている革新的なツールの一つが、AIを活用してパーソナライズされたフラッシュカードを作成することです。この技術は、学習体験を個々のニーズに合わせて調整し、記憶力と理解力を向上させます。試験の準備、新しい言語の習得、重要な事実の暗記など、AI生成のフラッシュカードは学習プロセスを効率化し、学びをより魅力的にします。AIを活用することで、学習習慣を一新し、教育成果を向上させる方法を発見してください。

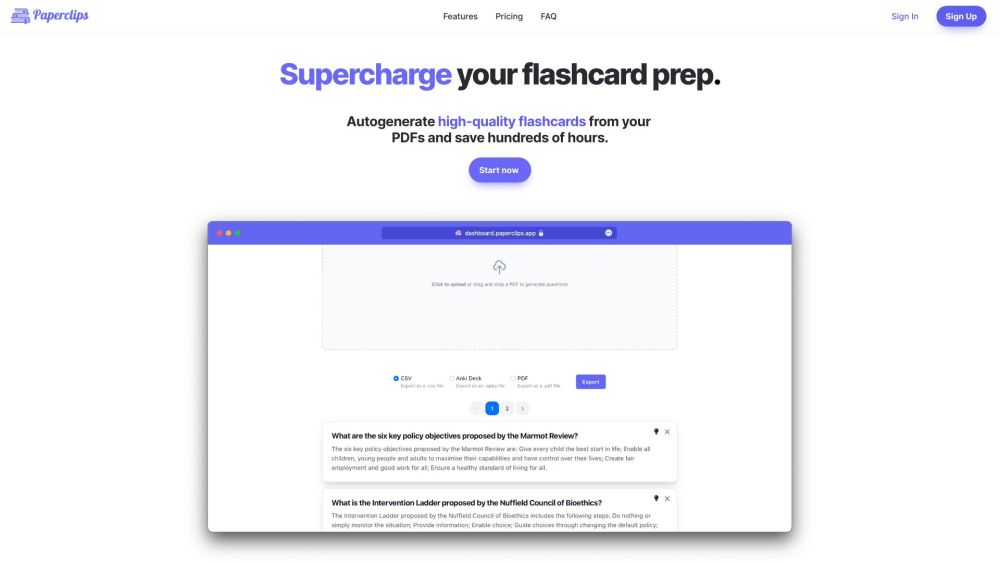

Paperclipsを紹介します。AIの力を活用して、コースノートやオンラインコンテンツを簡単に魅力的なフラッシュカードに変換する革新的なウェブアプリです。学習者のために設計されたこの最先端ツールで、学習プロセスを簡素化し、記憶の定着を高めましょう。

Find AI tools in YBX

Related Articles

Refresh Articles