Как обучить вашу команду мыслить как профессионалы в области ИИ

Most people like

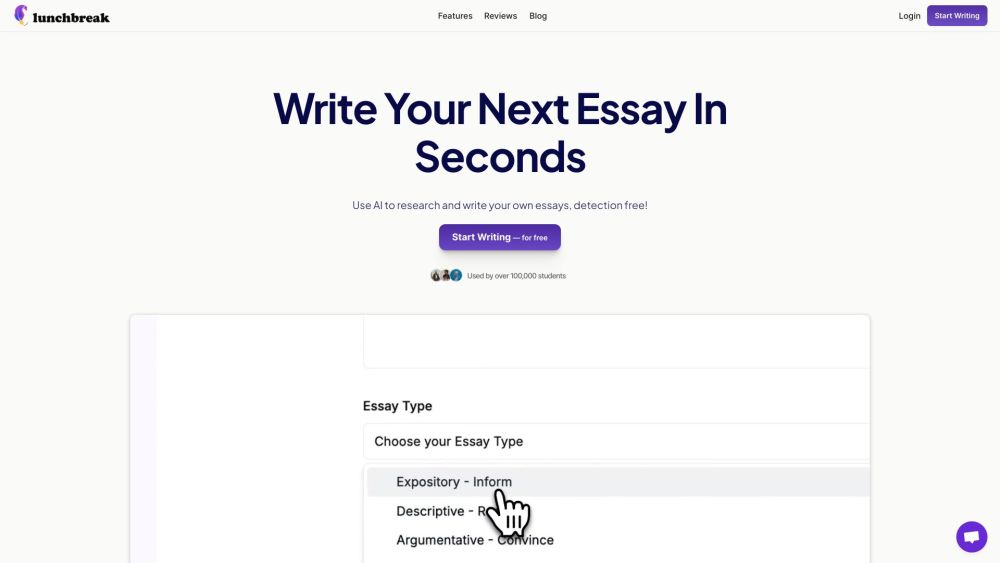

Представляем инструмент для написания эссе на основе ИИ, разработанный специально для студентов

В современных стремительных условиях учебного процесса студенты часто сталкиваются с трудной задачей написания структурированных эссе, совмещая множество обязанностей. Наш инновационный инструмент для написания эссе на базе ИИ упрощает этот процесс, предлагая персонализированную помощь, которая улучшает качество письма и увеличивает продуктивность. Независимо от того, нужно ли вам помочь в разработке идей, структурировании содержания или доработке финальной версии, этот инструмент станет вашим надежным спутником в написании, помогая вам добиться успеха в учебе. Раскройте свой полный потенциал с поддержкой на основе ИИ, адаптированной для студентов!

Откройте для себя передовой инструмент ИИ, созданный для преобразования вашего опыта на LinkedIn, предлагая глубокий анализ профилей и персон. Улучшите свои стратегии сетевого взаимодействия и рекрутинга с помощью инсайтов, которые способствуют значимым связям и содействуют профессиональному росту.

Откройте для себя удобные взаимодействия с клиентами с помощью нашего инновационного виджета чат-бота, разработанного специально для поддержки агентами ИИ. Этот мощный инструмент улучшает пользовательский опыт, предоставляя мгновенную помощь, разрешая запросы и повышая вовлеченность. Преобразите свой сервис поддержки с эффективной поддержкой на базе ИИ, которая увеличивает удовлетворенность клиентов и оптимизирует операции. Примите будущее коммуникации с клиентами и узнайте, как наш виджет чат-бота может революционизировать вашу стратегию поддержки уже сегодня!

Представляем AI-спутника для обучения, созданного для улучшения персонализированных образовательных взаимодействий. Эта инновационная технология адаптирует процесс обучения к индивидуальным потребностям, способствуя вовлеченности и улучшая результаты обучения. Будь вы студент, ищущий поддержку, или педагог, стремящийся предложить индивидуализированное обучение, наш AI-спутник для обучения готов преобразовать ваш учебный процесс.

Find AI tools in YBX

Related Articles

Refresh Articles