Отчет о прогрессе в области ИИ 2024: Основные выводы и тенденции

Искусственный интеллект (ИИ) продемонстрировал значительные достижения в 2023 году, особенно в технических показателях, объемах исследований и коммерческих инвестициях, согласно отчету AI Index 2024 Института ориентированного на человека ИИ Стэнфордского университета. Тем не менее, существуют заметные ограничения и растущие опасения по поводу рисков и социальных последствий.

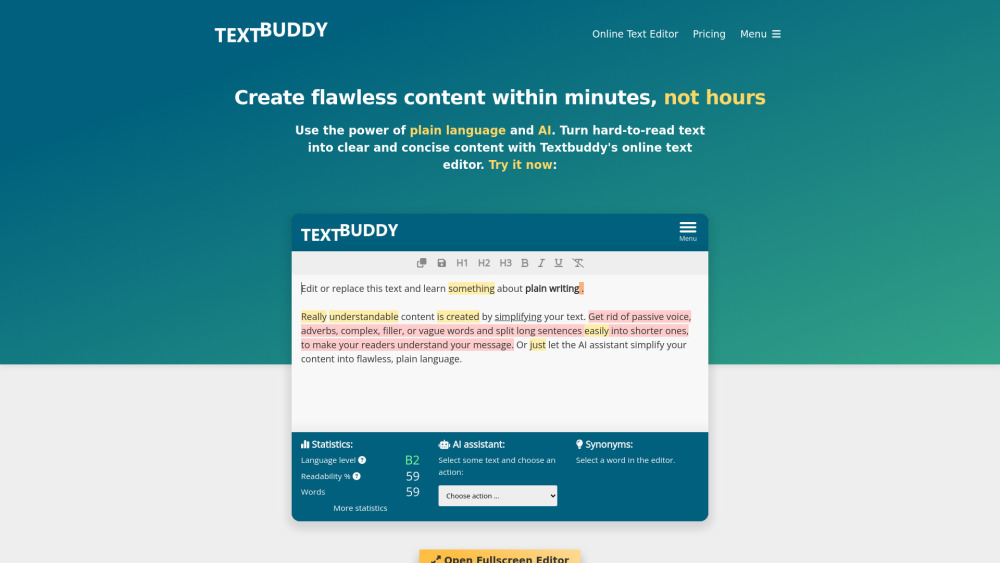

Отчет AI Index 2024 предлагает глубокий анализ мирового прогресса в области ИИ, показывая, что системы ИИ превзошли человеческие способности в таких задачах, как классификация изображений, визуальное мышление и понимание английского языка. Однако они все еще отстают в сложных областях, таких как высшая математика, здравый смысл и стратегическое планирование.

Рост исследований в области ИИ и растущие затраты

В отчете отмечается значительный рост активности в области исследований и разработок ИИ в 2023 году, главным образом за счет частного сектора. Компании выпустили 51 значимую модель машинного обучения (ML), по сравнению с 15 от академических учреждений. Партнерства между промышленностью и академией добавили еще 21 высокопрофильную модель.

Затраты на обучение сложных систем ИИ возросли. Например, языковая модель GPT-4 от OpenAI потребовала около 78 миллионов долларов США на вычислительные ресурсы, в то время как модель Gemini Ultra от Google обошлась в потрясающие 191 миллион долларов.

Авторы отмечают: "Затраты на обучение опытных моделей ИИ достигли беспрецедентных уровней."

Географическое превосходство в производстве ИИ

Соединенные Штаты остаются лидерами в разработке моделей ИИ, выпустив 61 значимую систему в 2023 году. Китай и Европейский Союз следуют с 15 и 21 моделями соответственно.

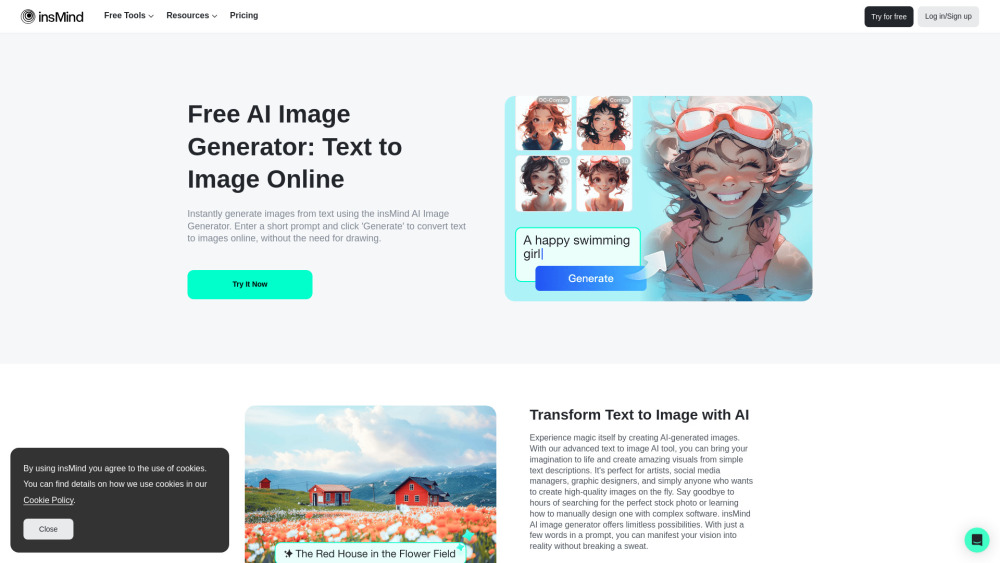

Тенденции инвестиций демонстрируют смешанную картину. Несмотря на снижение общего объема частных инвестиций в ИИ во второй год подряд, финансирование генеративного ИИ — способного создавать текст, изображения и другие медиа — возросло почти в восемь раз, достигнув 25,2 миллиарда долларов. Такие компании, как OpenAI, Anthropic и Stability AI, привлекли значительное финансирование.

В отчете говорится: "Несмотря на снижение общего объема инвестиций в ИИ, сектор генеративного ИИ продемонстрировал замечательный рост."

Необходимость стандартизированного тестирования ИИ

Быстрый прогресс в области ИИ вызывает опасения относительно отсутствия стандартизированного тестирования системы на ответственность, безопасность и защищенность. Крупные разработчики, такие как OpenAI и Google, регулярно оценивают свои модели по различным критериям, что усложняет кросс-сравнения.

Анализ AI Index предупреждает: "Надежные и стандартизированные оценки ответственности больших языковых моделей (LLM) крайне необходимы, усложняя попытки систематически оценивать риски и ограничения ведущих моделей ИИ."

Возникающие риски и общественная обеспокоенность

Отчет акцентирует внимание на возникающих рисках, таких как распространение политических дипфейков, которые "легко создавать и трудно обнаруживать". Кроме того, в отчете выявлены уязвимости в языковых моделях, которые могут привести к вредным последствиям.

Общественное мнение отражает растущую тревогу по поводу ИИ. Доля людей, ожидающих "драматическое" влияние ИИ в ближайшие 3-5 лет, возросла с 60% до 66% по всему миру. Более половины опрошенных теперь выражают дискомфорт относительно продуктов и услуг ИИ.

В США обеспокоенность по поводу роста роли ИИ значительно увеличилась; доля американцев, которые чувствуют больше опасений, чем восторга, возросла с 37% в 2021 году до 52% в 2023 году, в то время как тех, кто испытывает больший восторг, стало 36%.

В отчете делается вывод: "Общественное сознание о потенциальном влиянии ИИ растет, сопровождаясь повышенной тревогой." По мере развития технологий ИИ AI Index стремится предоставить объективные данные, которые помогут политикам, бизнесменам и общественности справляться с сложностями и возможностями, которые нас ждут.