مجمع نماذج اللغة الكبير من ميتا: حل ذكاء اصطناعي لتحسين كفاءة توليد الأكواد والتجميع

Most people like

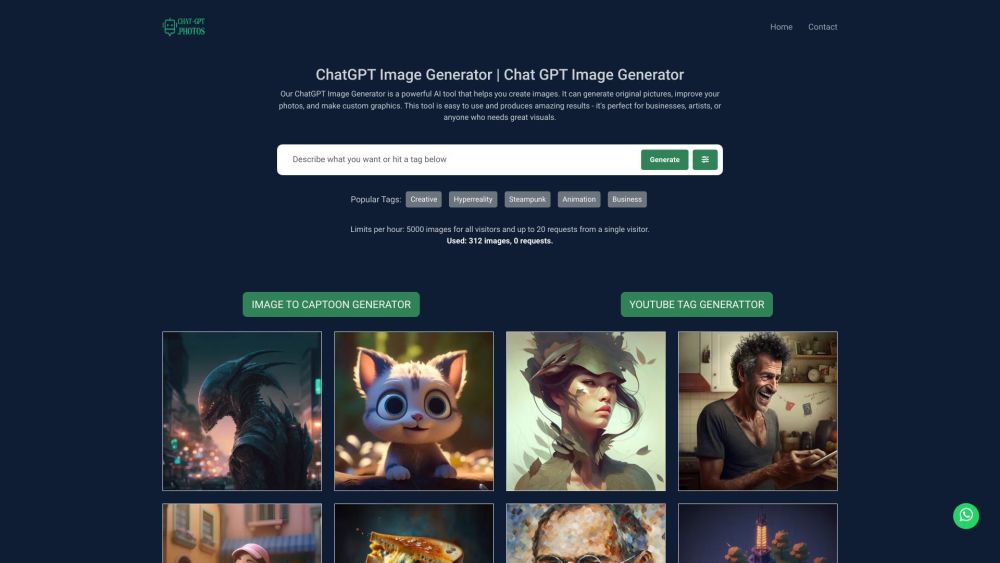

أطلق إبداعك مع مولد الصور ChatGPT! استكشف إمكانيات لا حصر لها وحوّل أفكارك إلى صور مذهلة باستخدام أداتنا القوية. سواء كنت فنانًا، مصممًا، أو مجرد شخص يتطلع للإبداع، يمكن لمولد الصور ChatGPT أن يحقق رؤاك كما لم يحدث من قبل!

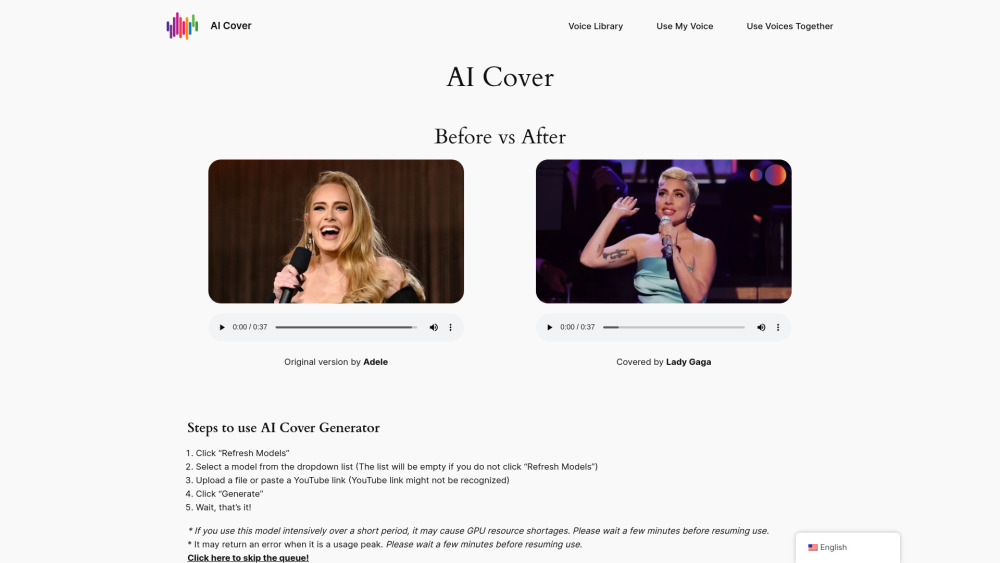

نقدم أداة مبتكرة بالذكاء الاصطناعي تبسط عملية إنشاء أغلفة أغاني عالية الجودة بكل سهولة. سواء كنت موسيقيًا محترفًا أو مبتدئًا شغوفًا، تتيح لك منصتنا إنتاج أغلفة مذهلة بسهولة.

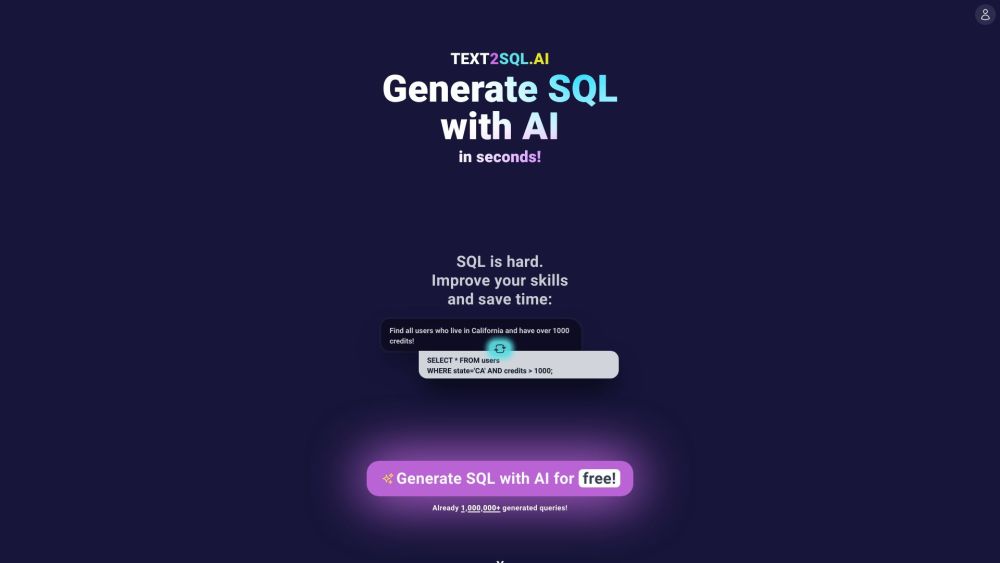

تقديم منصة ذكاء اصطناعي سهلة الاستخدام مصممة لتحويل التعليمات باللغة الإنجليزية إلى استعلامات SQL بكل سهولة. قم بتبسيط إدارة بياناتك من خلال هذه الأداة البديهية التي تسد الفجوة بين اللغة الطبيعية وتفاعل قواعد البيانات.

منصة معالجة الصوت والفيديو المدفوعة بالذكاء الاصطناعي: تعزيز كفاءة ودقة إنشاء وتحرير المحتوى

مع التطور السريع لتكنولوجيا الذكاء الاصطناعي، تغير منصات معالجة الصوت والفيديو مجال إنشاء المحتوى بطرق غير مسبوقة. تستطيع الأدوات المدفوعة بالذكاء الاصطناعي automate التحرير، وتعزز جودة الصورة، وتحسن جودة الصوت، مما يعزز بشكل كبير كفاءة عمل المنشئين. سواء كانت في وسائل التواصل الاجتماعي، أو إنتاج الفيديو، أو البث المباشر، تقدم هذه المنصات حلولًا ذكية للمستخدمين تجعل من إنشاء المحتوى أمرًا أبسط وأكثر كفاءة. استكشف منصات معالجة الصوت والفيديو المدفوعة بالذكاء الاصطناعي، واستمتع بتجربة إنشائية متكاملة.

Find AI tools in YBX

Related Articles

Refresh Articles