تأمين تدفقات عمل الذكاء الاصطناعي وتعلم الآلة: حماية النهج الابتكاري للذكاء الاصطناعي

يُعَدُّ تأمين تدفقات عمل الذكاء الاصطناعي (AI) وتعلم الآلة (ML) تحديًا متعدد الأبعاد يتضمن العديد من العناصر. تَعكُف شركة Protect AI، الناشئة في سياتل، على معالجة هذا التحدي من خلال الاستحواذ الأخير على شركة Laiyer AI، الرائدة في مشروع LLM Guard مفتوح المصدر. لم تُكشف تفاصيل الصفقة المالية بعد. سيعزز هذا الاستحواذ منصة Protect AI لحماية المنظمات بشكل أفضل من المخاطر المحتملة المرتبطة بالنماذج اللغوية الكبيرة (LLMs).

رادار: حل شامل لأمان الذكاء الاصطناعي

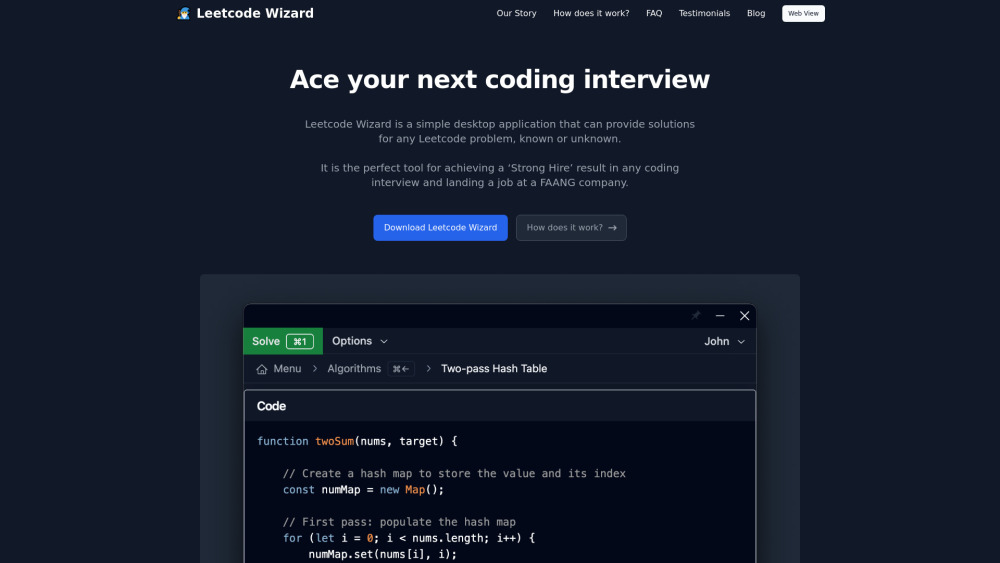

تقدم منصة Radar التجارية الأساسية لشركة Protect AI رؤية ورصد وإدارة لقدرات نماذج AI/ML. عقب جولة تمويل ناجحة بقيمة 35 مليون دولار في يوليو 2023، تهدف الشركة إلى توسيع مبادرات أمان الذكاء الاصطناعي. أكد داريان دهغانبيشه، رئيس ومؤسس Protect AI، قائلاً: “نريد دفع الصناعة لتبني مفهوم MLSecOps، الذي يساعد المنظمات على رؤية وفهم وإدارة المخاطر والثغرات الأمنية المتعلقة بالذكاء الاصطناعي.”

تحسينات من LLM Guard وLaiyer AI

يوفر مشروع LLM Guard، الذي تديره Laiyer AI، الحوكمة لعمليات LLM. ويتميز بوجود ضوابط إدخال تحمي من هجمات حقن الطلبات، وهي مصدر قلق متزايد في استخدام الذكاء الاصطناعي. بالإضافة إلى ذلك، يقلل LLM Guard من مخاطر تسرب المعلومات الشخصية (PII) واللغة السامة. ومن ناحية النتائج، يحمي المستخدمين من تهديدات متنوعة، بما في ذلك روابط الإنترنت الضارة.

أعاد دهغانبيشه التأكيد على التزام Protect AI بالحفاظ على LLM Guard مفتوح المصدر مع التخطيط لتقديم عرض تجاري تحت اسم Laiyer AI، والذي سيوفر أداءً محسّنًا ووظائف مؤسسية متقدمة. علاوة على ذلك، ستدمج Protect AI تقنية LLM Guard في منصتها الأوسع، مما يضمن الحماية عبر جميع مراحل تطوير ونشر نماذج الذكاء الاصطناعي.

الاستفادة من الخبرات مفتوحة المصدر

يمثل تطور Protect AI من المبادرات مفتوحة المصدر إلى المنتجات التجارية دليلاً على قيادتها لمشروع ModelScan مفتوح المصدر، الذي يحدد المخاطر الأمنية في نماذج ML. تستند هذه التقنية إلى تكنولوجيا Guardian التي أعلنت عنها Protect AI مؤخرًا، والتي تهدف إلى فحص الثغرات في نماذج ML. إن فحص النماذج للثغرات أكثر تعقيدًا من الفحص التقليدي للفيروسات؛ إذ تفتقر نماذج ML إلى الثغرات المعروفة القابلة للتحديد. أوضح دهغانبيشه: “النموذج هو قطعة من التعليمات البرمجية تعمل ذاتيًا.” “يمكن تضمين استدعاءات تنفيذية خبيثة بسهولة، مما يؤدي إلى مخاطر كبيرة.” تم تصميم تكنولوجيا Guardian من Protect AI للكشف عن هذه التهديدات.

نحو منصة شاملة لأمان الذكاء الاصطناعي

يتصور دهغانبيشه أن Protect AI ستتطور لتتجاوز المنتجات الأمنية الفردية. في المشهد الحالي، تستخدم المنظمات غالبًا تقنيات متنوعة من بائعين متعددين. تهدف Protect AI إلى توحيد أدواتها ضمن منصة Radar، مع التكامل بسلاسة مع أدوات الأمان الحالية مثل أنظمة SIEM (إدارة معلومات وأحداث الأمان). يوفر Radar نظرة شاملة على المكونات داخل نموذج الذكاء الاصطناعي، وهو أمر ضروري للحوكمة والأمان. بفضل تكنولوجيا Guardian، يمكن لـ Protect AI تحديد المخاطر المحتملة قبل النشر، بينما يعمل LLM Guard على تقليل مخاطر الاستخدام. في نهاية المطاف، تسعى Protect AI لتقديم حل شامل لأمان الذكاء الاصطناعي المؤسسي، مما يمكّن المنظمات من إدارة جميع سياسات أمان الذكاء الاصطناعي من منصة موحدة.

“ستتمكن من إدارة سياسة واحدة لأمان الذكاء الاصطناعي على مستوى المؤسسة” ، اختتم دهغانبيشه.