5 KI-Innovationen, auf die ich mich 2024 freue

Most people like

Notion ist ein leistungsstarker All-in-One-Arbeitsraum, der Wiki-Funktionalität, Dokumentenerstellung und Projektmanagement-Tools nahtlos miteinander verbindet.

Die Verbesserung sicherer globaler Handelszahlungen ist in der heutigen vernetzten Wirtschaft von wesentlicher Bedeutung. Angesichts der zunehmenden Abhängigkeit von internationalen Transaktionen ist die Gewährleistung von Sicherheit und Verlässlichkeit in den Zahlungsprozessen wichtiger denn je. Mit den richtigen Maßnahmen können Unternehmen Risiken minimieren, Abläufe optimieren und Vertrauen im grenzüberschreitenden Handel fördern. Sichere Zahlungslösungen zu priorisieren schützt nicht nur Ihre finanziellen Interessen, sondern ebnet auch den Weg für nachhaltiges Wachstum im globalen Markt.

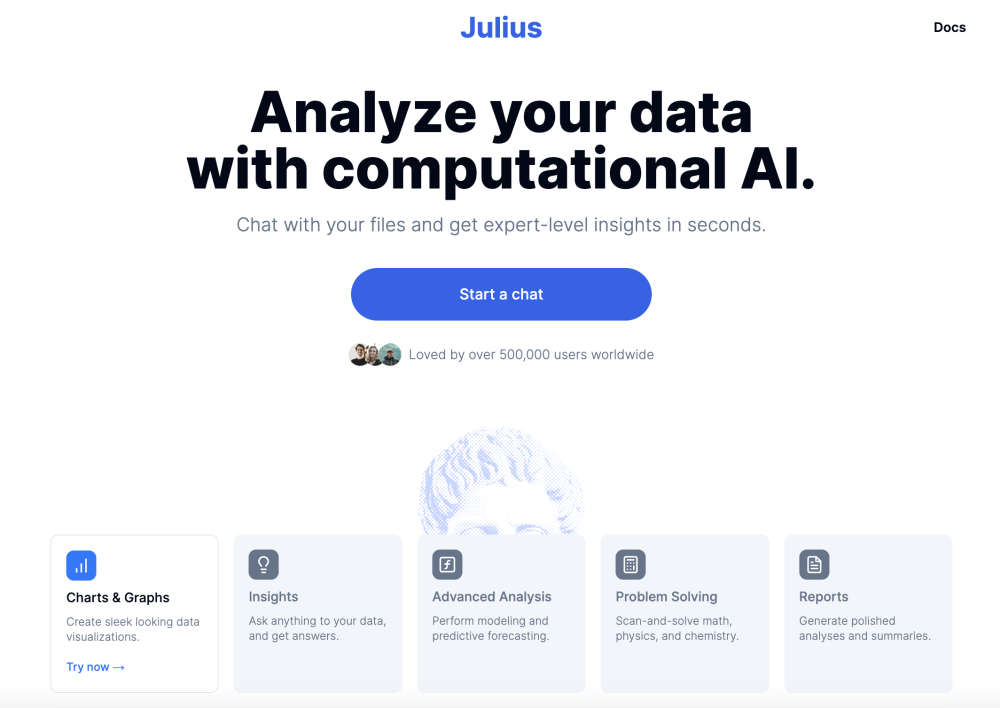

Entfesseln Sie die Kraft der KI-gesteuerten Datenanalyse und -visualisierung mit unserem innovativen KI-Datenanalysetool. Entwickelt, um Ihren Datenexplorationsprozess zu optimieren, verwandelt dieses Tool komplexe Datensätze in ansprechende visuelle Einblicke, die es Ihnen ermöglichen, fundierte Entscheidungen zu treffen. Erfahren Sie, wie unser KI-Datenanalyst Ihre Analytik auf das nächste Level heben kann, indem er Ihre Fähigkeit verbessert, Daten zu interpretieren und geschäftlichen Erfolg voranzutreiben.

Entdecken Sie das ultimative KI-Tool, das Ihre Twitter-Planung optimiert und das Engagement steigert. Ideal für Einzelpersonen und Unternehmen, organisiert diese innovative Lösung nicht nur Ihre Beiträge, sondern optimiert sie auch für maximale Interaktion. Erleben Sie eine intelligentere Art, auf Twitter zu kommunizieren, und heben Sie Ihre Online-Präsenz auf ein neues Level.

Find AI tools in YBX

Related Articles

Refresh Articles