Bericht enthüllt häufige Mängel in der KI-Governance: Viele beinhalten ineffektive KI-Lösungen.

Most people like

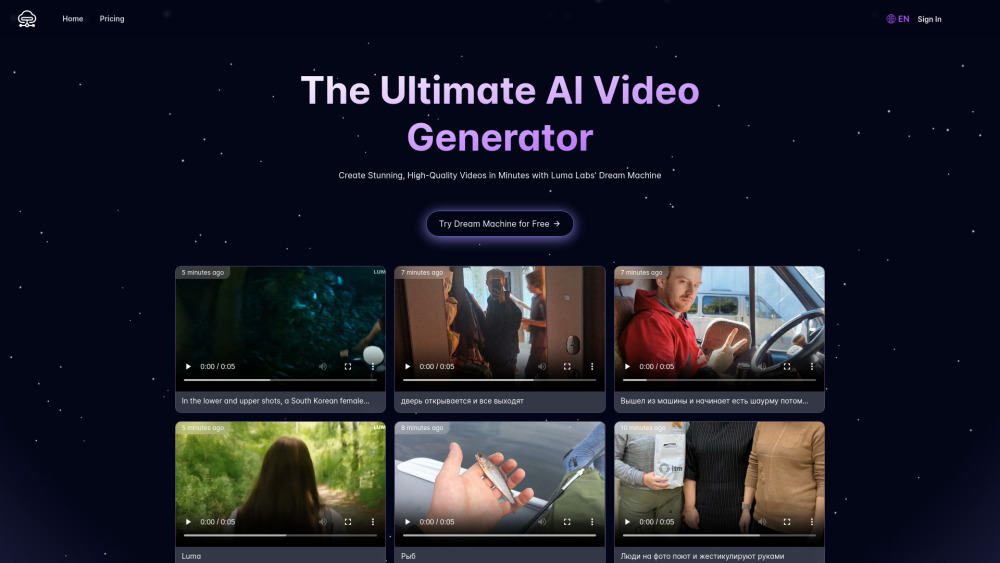

In der heutigen digitalen Landschaft sind fesselnde Videos entscheidend, um Zielgruppen zu erreichen und die Sichtbarkeit von Marken zu erhöhen. Ein KI-Video-Generator vereinfacht den Videoproduktionsprozess und ermöglicht es Nutzern, beeindruckende, professionelle Videos in nur wenigen Minuten zu erstellen. Egal, ob Sie Vermarkter, Content Creator oder Unternehmer sind, dieses innovative Tool verwandelt Ihre Ideen in ansprechende visuelle Inhalte, ohne dass umfangreiche technische Fähigkeiten erforderlich sind. Entdecken Sie, wie ein KI-Video-Generator Ihr Storytelling verbessern und Ihre Online-Präsenz steigern kann!

Nutze die Kraft der KI, um komplexe Themen zu vereinfachen und sie für alle verständlich und zugänglich zu machen.

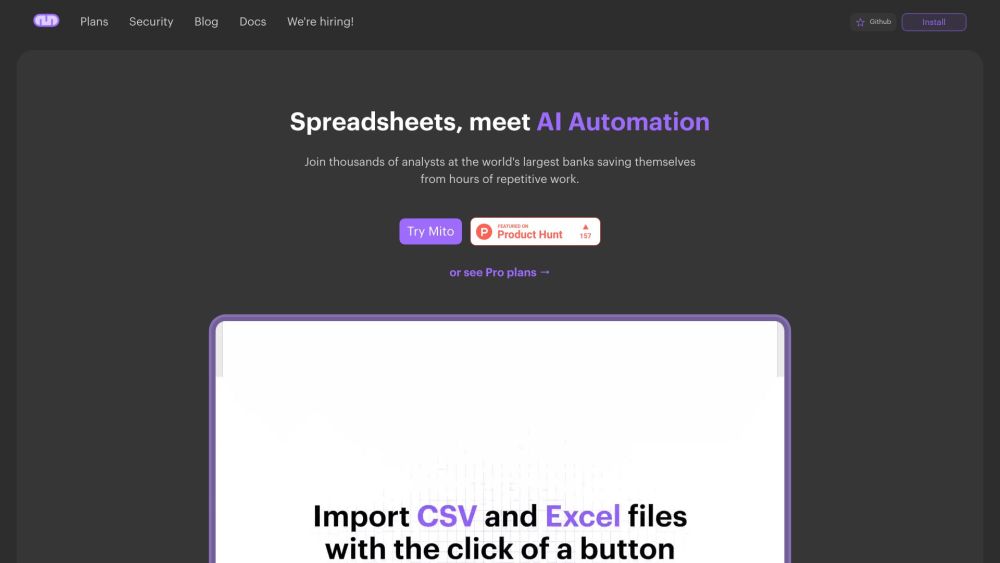

Mito ist ein leistungsstarkes Werkzeug, das entwickelt wurde, um die Bearbeitung Ihrer Tabellenkalkulationsdaten zu optimieren und gleichzeitig mühelos Python-Code zu generieren. Egal, ob Sie die Produktivität steigern oder die Datenmanipulation vereinfachen möchten, Mito bietet eine intuitive Benutzeroberfläche, die das Programmieren für jedermann zugänglich macht. Verbessern Sie Ihre Tabellenkalkulationsfähigkeiten und verwandeln Sie Ihren Datenworkflow noch heute mit Mito!

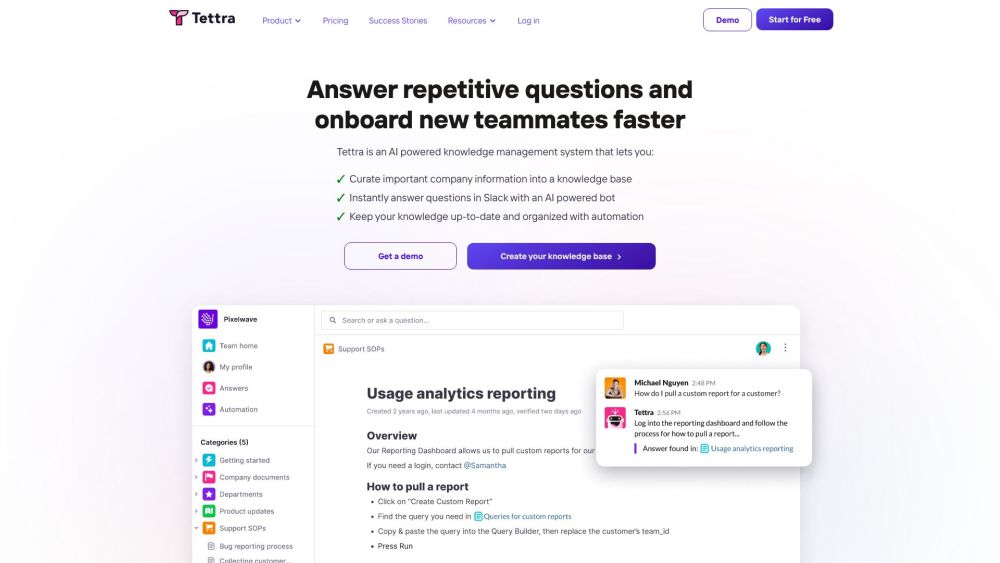

Präsentation unseres KI-gestützten Wissensmanagement-Systems: Revolutionieren Sie, wie Ihre Organisation Informationen erfasst, organisiert und abruft. Durch den Einsatz modernster künstlicher Intelligenz optimiert unser System den Wissensaustausch, fördert die Zusammenarbeit und steigert die Produktivität. Entdecken Sie, wie unsere innovative Lösung Ihre Wissensmanagement-Praktiken transformieren und Ihr Team befähigen kann, schneller und effizienter informierte Entscheidungen zu treffen. Optimieren Sie Ihre Arbeitsabläufe und maximieren Sie das Potenzial Ihrer Organisation mit unserer fortschrittlichen KI-Technologie.

Find AI tools in YBX

Related Articles

Refresh Articles