Die Erkundung des ChatGPT Dan-Modus: Nutzer genießen das 'spielerische' KI-Erlebnis

Most people like

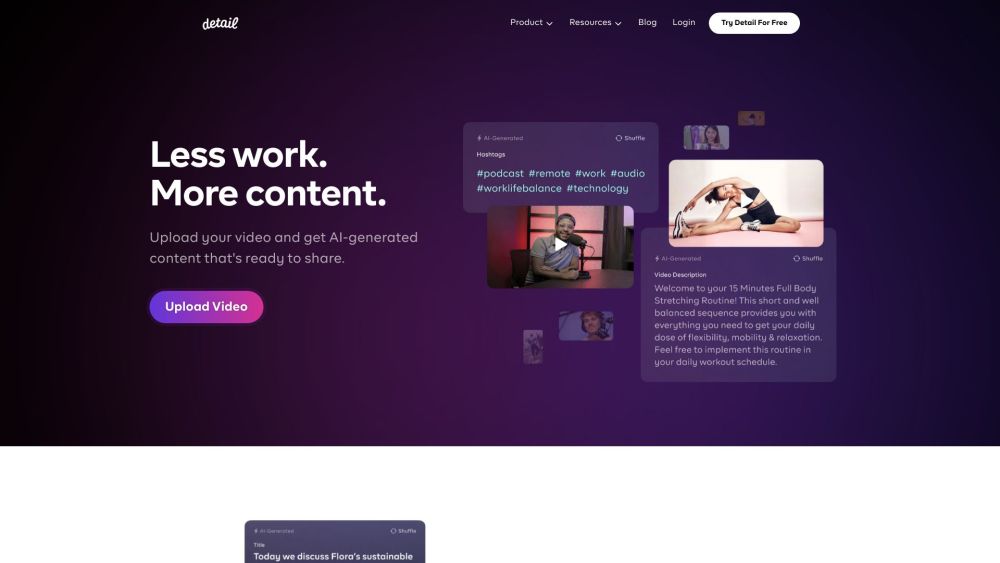

Detail ist eine innovative Kamera-App, die das Videoaufnehmen und -bearbeiten für angehende Geschichtenerzähler vereinfacht. Mit ihrer benutzerfreundlichen Oberfläche und leistungsstarken Funktionen ermöglicht Detail den Nutzern, mühelos fesselnde visuelle Erzählungen zu erstellen.

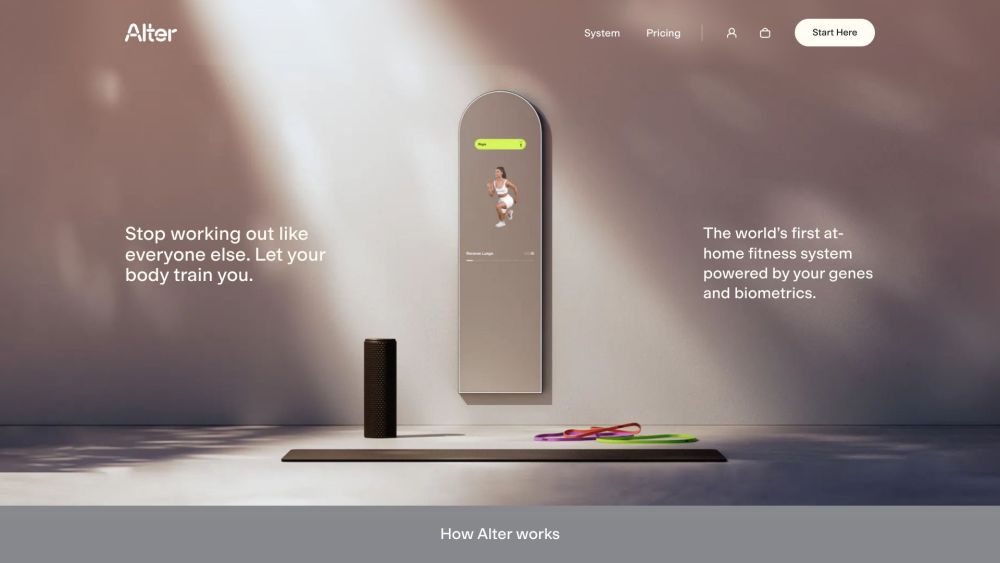

Entdecken Sie personalisiertes Fitness zu Hause, das auf Ihre einzigartigen Gene und biometrischen Daten abgestimmt ist. Entfalten Sie Ihr Potenzial mit einem speziell für Sie entwickelten Trainingsprogramm, das Ihre Ergebnisse optimiert und Ihre Wellness-Reise bereichert.

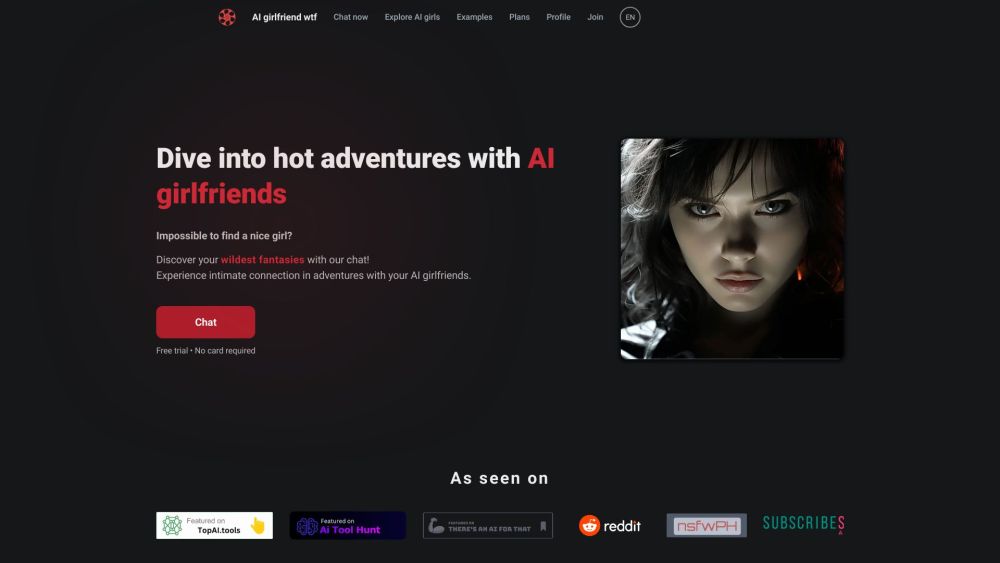

Erlebe interaktives Geschichtenerzählen mit KI-Freundinnen, bei dem du in fesselnde Erzählungen eintauchen und bedeutungsvolle Gespräche führen kannst. Entdecke die grenzenlosen Möglichkeiten von Verbindung und Kreativität durch diese virtuellen Begleiter, die darauf ausgelegt sind, deine Fantasie zum Leben zu erwecken.

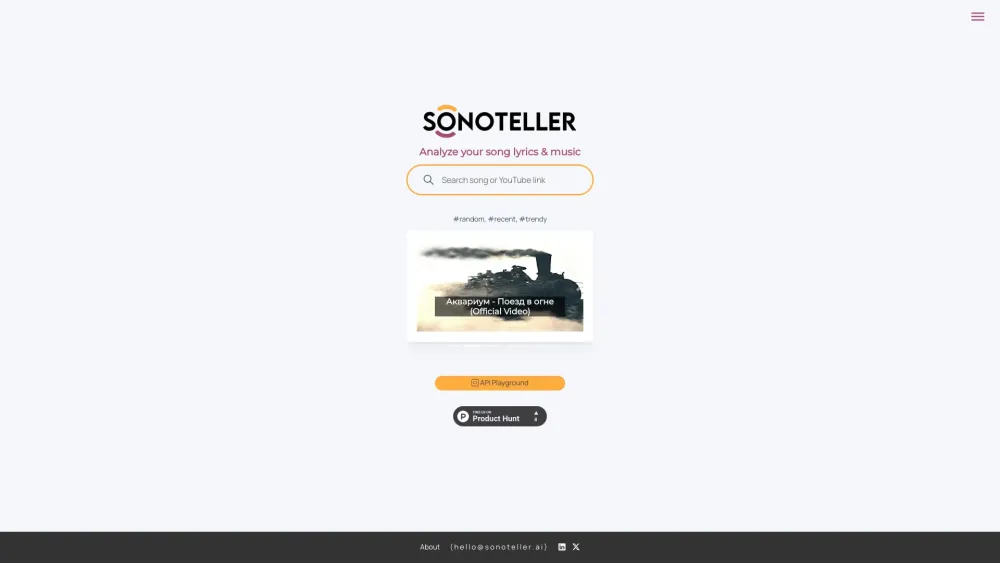

Verbessern Sie Ihr Musikverständnis und optimieren Sie Ihre Organisation mit unserem umfassenden Leitfaden. Entdecken Sie effektive Techniken, die nicht nur Ihre musikalische Erfahrung klären, sondern auch helfen, Ihre Musiksammlung effizient zu verwalten. Ob Sie ein aufstrebender Musiker oder ein leidenschaftlicher Zuhörer sind, das Beherrschen dieser Strategien wird Ihre Herangehensweise an Musik und Ihr Genusserlebnis verändern.

Find AI tools in YBX

Related Articles

Refresh Articles